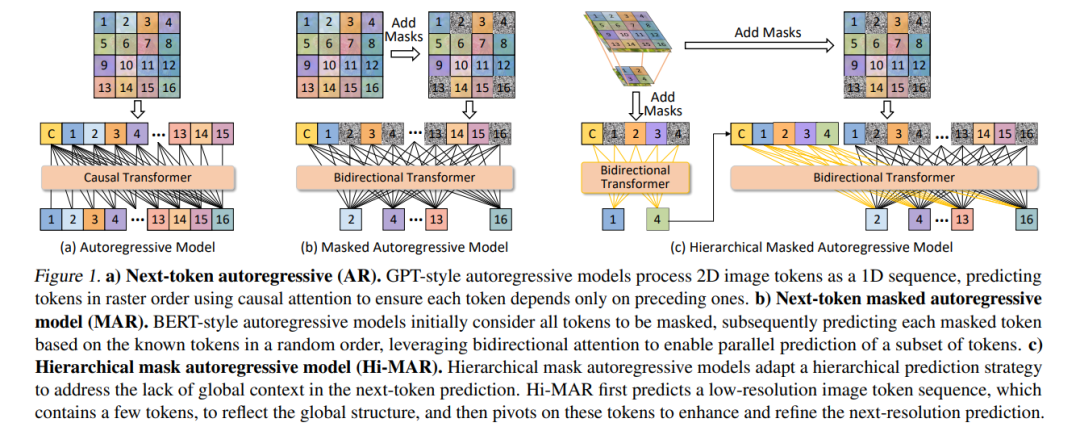

自回归模型已成为视觉生成领域一种强大的生成范式。当前事实上的标准方法——下一词元预测——通常基于单尺度的密集图像词元序列进行操作,尤其在早期词元预测阶段难以有效利用全局上下文。本文提出一种新颖的自回归架构,通过从少量低分辨率图像词元到典型密集图像词元构建层级关系,深入探索多尺度图像词元间的层次化依赖关系。 技术上,我们提出基于低分辨率词元枢轴的层级掩码自回归模型(HiMAR),该模型以多阶段方式触发层次化自回归建模: 1. 第一阶段:HiMAR学习预测少量低分辨率图像词元,这些作为中间枢轴(pivots)反映全局结构; 1. 第二阶段:此类枢轴通过塑造对典型密集图像词元的全局结构认知,增强下一阶段自回归建模; 1. 创新模块:设计新型扩散Transformer头(Diffusion Transformer head),强化所有词元间的全局上下文关联以优化掩码词元预测。

在类别条件生成和文本到图像生成任务上的大量实验表明,HiMAR在减少计算成本的同时,性能超越典型自回归基线模型。代码已开源:https://github.com/HiDream-ai/himar

成为VIP会员查看完整内容

相关内容

Arxiv

40+阅读 · 2023年4月19日

Arxiv

79+阅读 · 2023年4月4日

Arxiv

142+阅读 · 2023年3月29日