可信联邦学习线上分享:杨强教授带领四篇论文解读最前沿研究

-

论文标题:No Free Lunch Theorem for Security and Utility in Federated Learning -

论文链接:https://arxiv.org/pdf/2203.05816.pdf

-

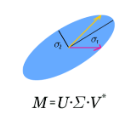

论文标题:Practical Lossless Federated Singular Vector Decomposition over Billion-Scale Data -

论文链接:https://dl.acm.org/doi/abs/10.1145/3534678.3539402

-

论文标题:FedCG: Leverage Conditional GAN for Protecting Privacy and Maintaining Competitive Performance in Federated Learning -

论文链接:https://www.ijcai.org/proceedings/2022/324

-

论文标题:FedIPR: Ownership Verification for Federated Deep Neural Network Model -

论文链接:https://ieeexplore.ieee.org/abstract/document/9847383/

-

点击「阅读原文」,访问机动组官网,观看往期回顾; -

关注机动组服务号,获取每周直播预告。

登录查看更多

相关内容

Arxiv

10+阅读 · 2020年12月8日

Arxiv

13+阅读 · 2018年9月7日