![]()

来源:Open AI

编辑:梦佳、雅新

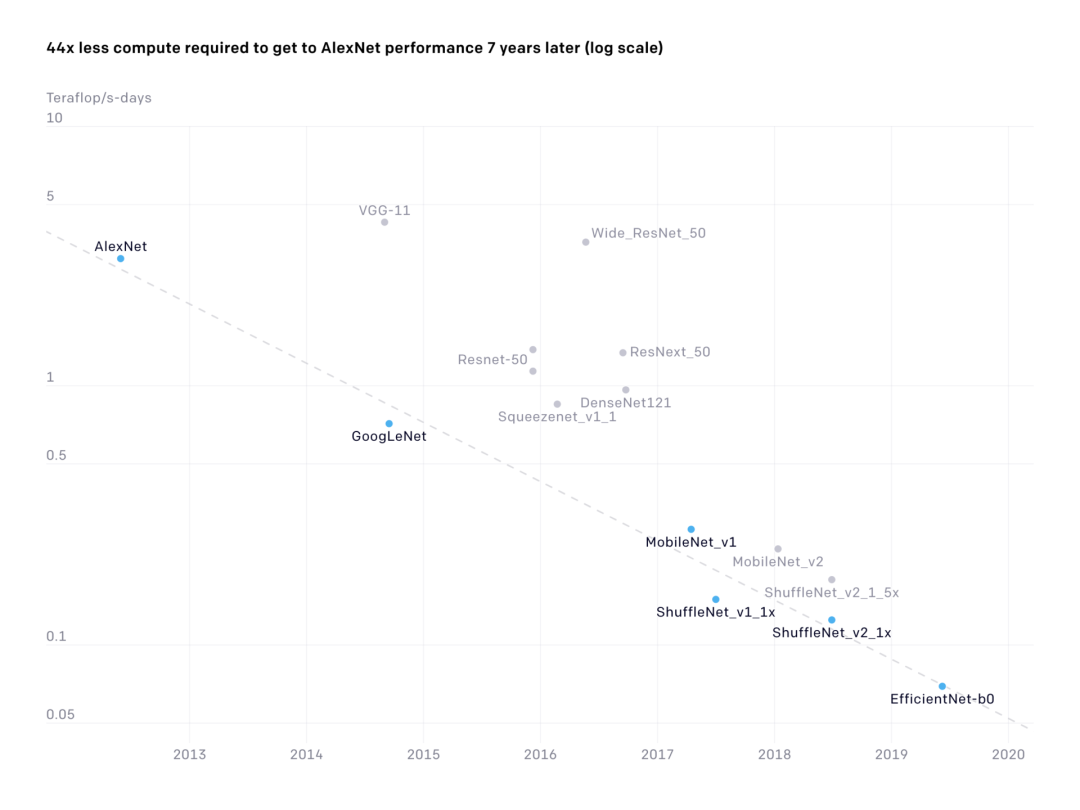

【新智元导读】Open AI近日宣布公开追踪AI模型效率,其中算法改进是关键。报告中显示,AI算法效率每16个月翻一番,与2012年相比,训练神经网络达到AlexNet的水平所需的算力会减少到1/44。研究表明,算法改进效率吊打摩尔定律,投入大量人力物力的AI研究貌似比硬件研发收益更高。「新智元急聘主笔、高级主任编辑,添加HR微信(Dr-wly)或扫描文末二维码了解详情。」

OpenAI今天宣布将开始追踪机器学习模型的效率,并对AI算法演进的情况进行定量追踪,结果显示算法改进效率吊打摩尔定律。

为了启动这一进程,Open AI发表了一份分析报告,开篇即用数据展示了算法演进的速度。

报告分析显示,自2012年以来,要训练一个人工智能模型在基准测试ImageNet图像分类任务中达到同等的分类效果,所需的算力每16个月就会减少1/2。

![]() ImageNet图像分类任务

与2012年相比,现在训练一个神经网络达到 AlexNet的水平所需的算力会减少到1/44

(相比之下,摩尔定律在相同时间之内,效率只有12倍左右的增长

)。

结果表明,对于投入了大量资金的AI研发,算法演进显然比传统的硬件进步带来了更多的收益。

「算法进步是推动AI发展的关键因素。重要的是要找到方法,阐明整个算法演进的过程,尽管这比衡量计算趋势更难,」OpenAI 在官网文章中写道。

提升算法效率,可以定义为减少训练算法完成某项任务所需的算力

。

在很多其他领域都可以对效率进行比较,比如 DNA 测序(每10个月翻一番)、能源再生(每6年翻一番)和晶体管密度(每2年翻一番)。

研究人员经常使用效率,来衡量算法在完成经典计算任务时的能力,其中就包括分类任务。分类等传统问题上的效率提升,比机器学习中的效率更容易衡量,因为它们对任务难度的衡量更加清晰。

在机器学习中,我们想要测量算法的效率,就要保持达到性能水平的恒定。

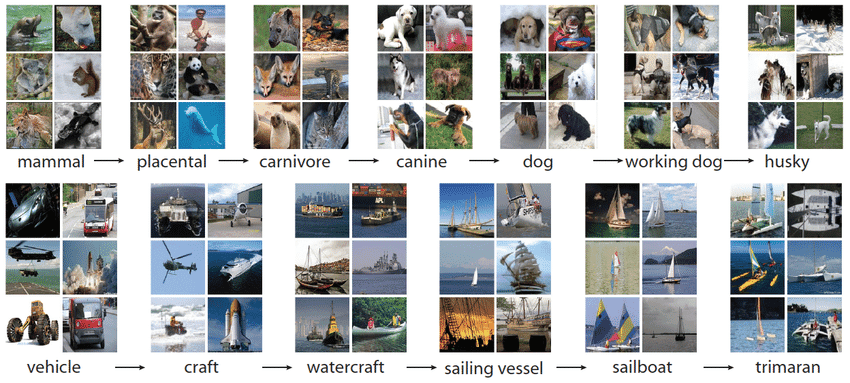

在分析中,Open AI利用开源的方法测量了各种模型达到AlexNet 水平的效率。

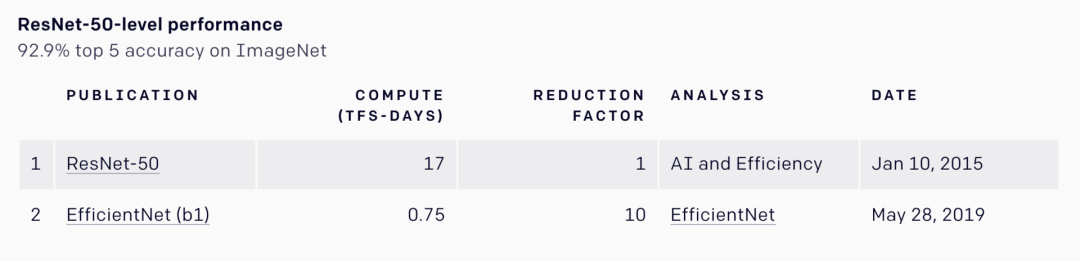

ImageNet图像分类任务

与2012年相比,现在训练一个神经网络达到 AlexNet的水平所需的算力会减少到1/44

(相比之下,摩尔定律在相同时间之内,效率只有12倍左右的增长

)。

结果表明,对于投入了大量资金的AI研发,算法演进显然比传统的硬件进步带来了更多的收益。

「算法进步是推动AI发展的关键因素。重要的是要找到方法,阐明整个算法演进的过程,尽管这比衡量计算趋势更难,」OpenAI 在官网文章中写道。

提升算法效率,可以定义为减少训练算法完成某项任务所需的算力

。

在很多其他领域都可以对效率进行比较,比如 DNA 测序(每10个月翻一番)、能源再生(每6年翻一番)和晶体管密度(每2年翻一番)。

研究人员经常使用效率,来衡量算法在完成经典计算任务时的能力,其中就包括分类任务。分类等传统问题上的效率提升,比机器学习中的效率更容易衡量,因为它们对任务难度的衡量更加清晰。

在机器学习中,我们想要测量算法的效率,就要保持达到性能水平的恒定。

在分析中,Open AI利用开源的方法测量了各种模型达到AlexNet 水平的效率。

![]() 上图为 ImageNet比赛中各种模型达到AlexNet水平的效率提升情况,图中reduction factor指的就是提升的倍数。

2019年推出的EfficientNet-b1模型达到ResNet-50相同的性能,4年的时间里所需算力减少到1/10。

研究发现在机器翻译、 Go 和 Dota 2比赛中,在较短的时间内效率提升速度更快:

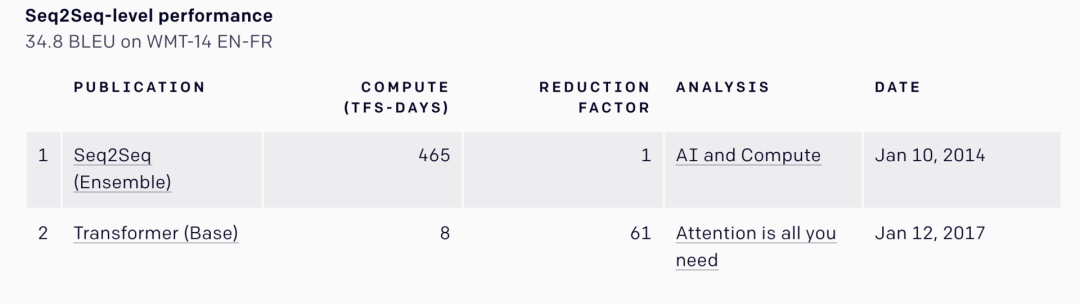

1 在WMT’14英语到法语的翻译基准测试中,seq2seq三年后推出的Transformer,完成相同的训练任务所需的算力减少了1/61。seqseq也是谷歌2014年推出的架构,是当时最先进的模型。

2 我们都知道,Deepmind 的AlphaZero是一个从零开始自学下棋的系统,他的进步速度也很快,和在他一年前推出的版本 AlphaGoZero相比,达到相同的性能,只需要

8分之一的算力

。

3 Open AI自己的Dota2游戏系统Open AI Five Rerun和在3个月之前推出的Open AI Five相比,达到相同的性能只需要

1/5的算力

。前者曾经击败过世界冠军,种子选手OG。

当然也要考虑到2012年的计算和2019年的计算不可同日而语,就像美元需要随着时间的推移发生通货膨胀一样。相同的算力在2019年可以完成比2012年更多的任务。从这个意义上讲,可以将某些AI研究进程分为两个阶段,类似于半导体中的「tick tock」发展模型。

以英特尔为例,

Tick年(工艺年)更新制作工艺,Tock年(架构年)更新微架构

。Tick-Tock就是时钟的“嘀嗒”的意思,而在Intel的处理器发展战略上,每一个嘀嗒代表着2年一次的工艺制程进步。每个Tick-Tock中的“Tick”,代表着工艺的提升、晶体管变小,并在此基础上增强原有的微架构,而Tick-Tock中的“Tock”,则在维持相同工艺的前提下,进行微架构的革新,这样在制程工艺和核心架构的两条提升道路上,总是交替进行。

根据摩尔定律,一个集成电路中可容纳的晶体管数量每两年就会翻一番,OpenAI 推测演算法效率可能会超过摩尔定律。

摩尔定律是在1965年提出来的,当时集成电路只有64个晶体管。

Open AI的研究结果表明,AI研发,研究人员时间和计算能力的投入更高,算法演进效率可能会超过硬件效率。

算法效率的提升使得研究人员可以在同等的时间和经济条件下做更多想做的实验。除了作为衡量整体AI进步的指标,算法效率提升还加快了未来AI研究的速度,也意味着整体算力的提升。

除了效率之外,还有许多其他的衡量标准也可以揭示AI的算法演进过程。

1 训练成本(以美元为单位)也是相关的衡量标准,但不再取决于算法的进步,因为它还受到底层硬件、硬件利用率和云基础设施的改进的影响。

2 采样效率也很关键,尤其是当样本数据不足时。训练模型的能力也加快了研究的速度,可以被认为是对感兴趣的学习能力的并行性的一种度量。

3 在 GPU 时间、参数和浮点运算方面,训练模型推理效率也有所提高,但这主要是由于它们的经济影响而不是对未来研究进展的影响。推理效率在5年内(每15个月翻一番)提高了18倍,这表明训练效率和推理效率可能在相同的速率下得到提高。

上图为 ImageNet比赛中各种模型达到AlexNet水平的效率提升情况,图中reduction factor指的就是提升的倍数。

2019年推出的EfficientNet-b1模型达到ResNet-50相同的性能,4年的时间里所需算力减少到1/10。

研究发现在机器翻译、 Go 和 Dota 2比赛中,在较短的时间内效率提升速度更快:

1 在WMT’14英语到法语的翻译基准测试中,seq2seq三年后推出的Transformer,完成相同的训练任务所需的算力减少了1/61。seqseq也是谷歌2014年推出的架构,是当时最先进的模型。

2 我们都知道,Deepmind 的AlphaZero是一个从零开始自学下棋的系统,他的进步速度也很快,和在他一年前推出的版本 AlphaGoZero相比,达到相同的性能,只需要

8分之一的算力

。

3 Open AI自己的Dota2游戏系统Open AI Five Rerun和在3个月之前推出的Open AI Five相比,达到相同的性能只需要

1/5的算力

。前者曾经击败过世界冠军,种子选手OG。

当然也要考虑到2012年的计算和2019年的计算不可同日而语,就像美元需要随着时间的推移发生通货膨胀一样。相同的算力在2019年可以完成比2012年更多的任务。从这个意义上讲,可以将某些AI研究进程分为两个阶段,类似于半导体中的「tick tock」发展模型。

以英特尔为例,

Tick年(工艺年)更新制作工艺,Tock年(架构年)更新微架构

。Tick-Tock就是时钟的“嘀嗒”的意思,而在Intel的处理器发展战略上,每一个嘀嗒代表着2年一次的工艺制程进步。每个Tick-Tock中的“Tick”,代表着工艺的提升、晶体管变小,并在此基础上增强原有的微架构,而Tick-Tock中的“Tock”,则在维持相同工艺的前提下,进行微架构的革新,这样在制程工艺和核心架构的两条提升道路上,总是交替进行。

根据摩尔定律,一个集成电路中可容纳的晶体管数量每两年就会翻一番,OpenAI 推测演算法效率可能会超过摩尔定律。

摩尔定律是在1965年提出来的,当时集成电路只有64个晶体管。

Open AI的研究结果表明,AI研发,研究人员时间和计算能力的投入更高,算法演进效率可能会超过硬件效率。

算法效率的提升使得研究人员可以在同等的时间和经济条件下做更多想做的实验。除了作为衡量整体AI进步的指标,算法效率提升还加快了未来AI研究的速度,也意味着整体算力的提升。

除了效率之外,还有许多其他的衡量标准也可以揭示AI的算法演进过程。

1 训练成本(以美元为单位)也是相关的衡量标准,但不再取决于算法的进步,因为它还受到底层硬件、硬件利用率和云基础设施的改进的影响。

2 采样效率也很关键,尤其是当样本数据不足时。训练模型的能力也加快了研究的速度,可以被认为是对感兴趣的学习能力的并行性的一种度量。

3 在 GPU 时间、参数和浮点运算方面,训练模型推理效率也有所提高,但这主要是由于它们的经济影响而不是对未来研究进展的影响。推理效率在5年内(每15个月翻一番)提高了18倍,这表明训练效率和推理效率可能在相同的速率下得到提高。

对于翻译和游戏这样的领域,如何用更少的算力来获取更好的成绩,提升大规模计算的效率是至关重要的。在重要能力方面实现最优训练效率的模型,可以用来规模化,来实现总体计算的最佳性能。

事实上,这项工作最初是通过训练 PyTorch 示例模型来完成的,通过微调来提高早期学习的效率。

Open AI认为,测量算法效率提升的长期趋势将有助于定量描绘整个算法演进的进程。研究表明,硬件和算法效率都是呈倍数增长的,一个良好的AI进步模型可以将二者相结合。

正是出于上述这些原因,Open AI开始公开测试最先进的算法效率。除了图像和翻译效率基准(ImageNet 和 WMT14) 测试以外,Open AI会考虑逐步增加更多的基准测试,同时Open AI鼓励学界提交他更多的测量结果(原创作者和合作者也会受到相应的奖励)。

值得注意的是,OpenAI 并不是第一个提出利用基准测试AI模型效率的公司。去年,艾伦人工智能研究所、卡内基梅隆大学和华盛顿大学的科学家们主张将效率作为AI学术论文的一个更普遍的评估标准,与准确性和相关措施并列。还有人主张要求对机器学习项目进行行业级的耗能分析,并设定每瓦特运行算力的行业标准。

「行业领袖、政策制定者、经济学家和研究人员都在努力更好地理解人工智能的进展,并决定他们应该投入多少精力,并将研究重心放在何处,」OpenAI 写道。「我们的这项测量工作可以帮助他们做出这样的决定。」

论文结尾,Open AI展望了未来,「如果在未来的几十年内,我们观察人工智能算法效率呈指数级倍增,我们不确定这会带来什么。这些结果也意味着,我们正面向着一个AI服务和技术无比强大的未来。」

![]()

参考链接:

https://venturebeat.com/2020/05/05/openai-begins-publicly-tracking-ai-model-efficiency/

https://openai.com/blog/ai-and-efficiency/#rf3

![]()

ImageNet图像分类任务

ImageNet图像分类任务

上图为 ImageNet比赛中各种模型达到AlexNet水平的效率提升情况,图中reduction factor指的就是提升的倍数。

上图为 ImageNet比赛中各种模型达到AlexNet水平的效率提升情况,图中reduction factor指的就是提升的倍数。