脑科学真的可以启发AI吗?

导读:人工智能发展到当前阶段,大家都开始认识到脑科学和人工智能有很密切的关系,脑科学会对人工智能的发展产生很大帮助。反过来思考这个问题,脑科学对人工智能研究真的有帮助吗?离开脑科学之后,人工智能是否依旧能进一步发展?这是很有必要回答的一个问题。

在智源研究院成立两周年暨“2020智源论坛”中,清华大学教授、智源首席科学家刘嘉,作为认知神经科学领域的知名学者,却做了否定式地质疑:

物理世界与心理世界并非一一对应关系,人类智能和物理世界的本质也不同。因此从原理上讲,实现 AI 并不需要认知科学,实现智能,也不需要像素级的拷贝大脑。

在这种自我否定式的质疑后,刘嘉教授邀请了智源研究院不同研究领域的六位科学家,围绕能否借鉴、怎么借鉴等问题进行了深度探讨。

整个研讨分为两部分,首先由清华大学教授刘嘉做引导报告《脑科学真的可以启发AI么》,随后七位学者围绕多个问题进行辩论。

从左到右:吴思、陈良怡、孙茂松、李国齐、王立威、张志华

脑科学可以启发 AI ?

以下是刘嘉教授的报告内容整理:

01

AI存在的问题

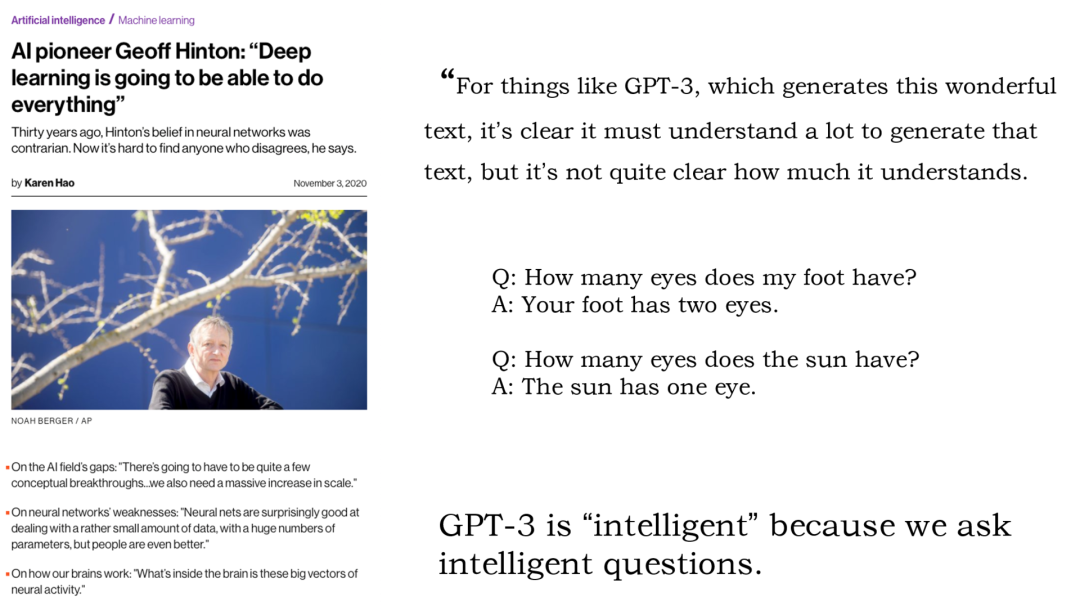

最近Hinton接受了MIT Technology Review的采访,简短的内容中表达了一个重要的观点是“深度学习可以做任何事情”。

他举例说GPT-3可以在一定程度上达到“理解”,但是当我们向GTP-3提问一些很“愚蠢”的问题的时候,比如说“脚上有几只眼睛”,它会回答“两只眼睛”。GTP-3在学习的时候都是在学习“聪明”的问题,从来没有“考虑”过“愚蠢”的问题如何回答,所以只有在我们向它提问“聪明”的问题的时候,它才能够展现其强大之处。从这个角度来说,GTP-3并非达到了真正的理解,而仅是把已有的知识做了一定的关联。

Hinton进一步表示相比于静态的文本的学习,如果能够对场景进行描述,那就表明AI对动作产生了真正的理解,但是相比于AI的描述来说,人类的真实反应会包含更丰富的信息。这些更深层次的理解是AI所不能够达到的。

随后Hinton提到GTP-3目前还没有达到完美的主要原因是,其连接数量还不够多,仅有1750亿个参数,如果能够再提高3个量级,GTP-3可能就能完成人需要做的任务。

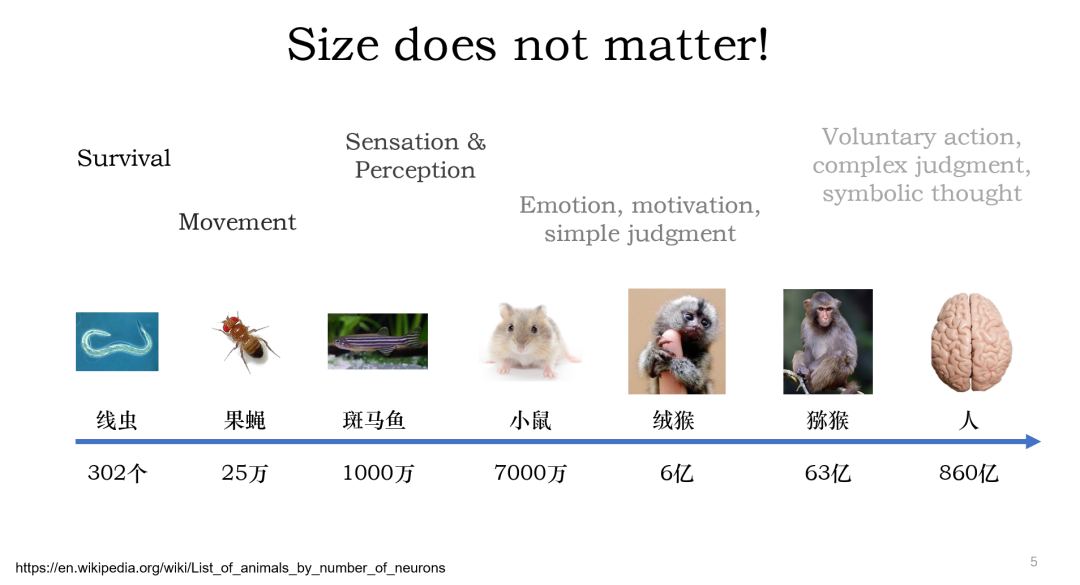

但是从进化的角度来看生物智能,并非是一个线性提高数量的过程,而是形成了“进化树”,从简单的线虫(302个神经元)到人(860亿个神经元),每一种生物都有不同量级的神经元数量,但是这些生物都对外界形成了完美的适应,形成了所谓的“通用智能”,因而提高神经元数量并不是生物智能采用的策略。

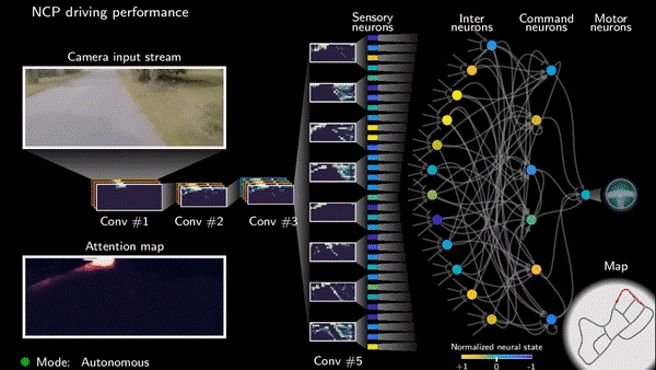

一篇最新发表在Nature Machine Learning的文章,只用了19个包含神经形态的神经元就完成了自动驾驶的任务,其关键是采用了受线虫启发神经环路法则(Neural Circuit Policy),这个网络仅有7500个参数,比传统的自动驾驶神经网络低了3个数量级,但具有更好的扩展性,可解释性和稳定性。所以规模虽然很重要,但是并不是决定智能的唯一因素。

02

生物如何实现智能

就借鉴生物智能的角度来讲,我们当前依然需要回答一些很重要的问题,生物如何实现智能?智能的本质是什么?这些答案将会对AI的研究提供帮助,但是我们不能只停留在帮助的表层(例如人脸识别),而需要挖掘更深层的东西,即智能的本质。

康德(Immanuel Kant)在三百年前就提出一个猜测“人类存在三种先天的先验知识:空间,时间和因果”,这三点在当前的智能研究中依然是非常重要的问题。

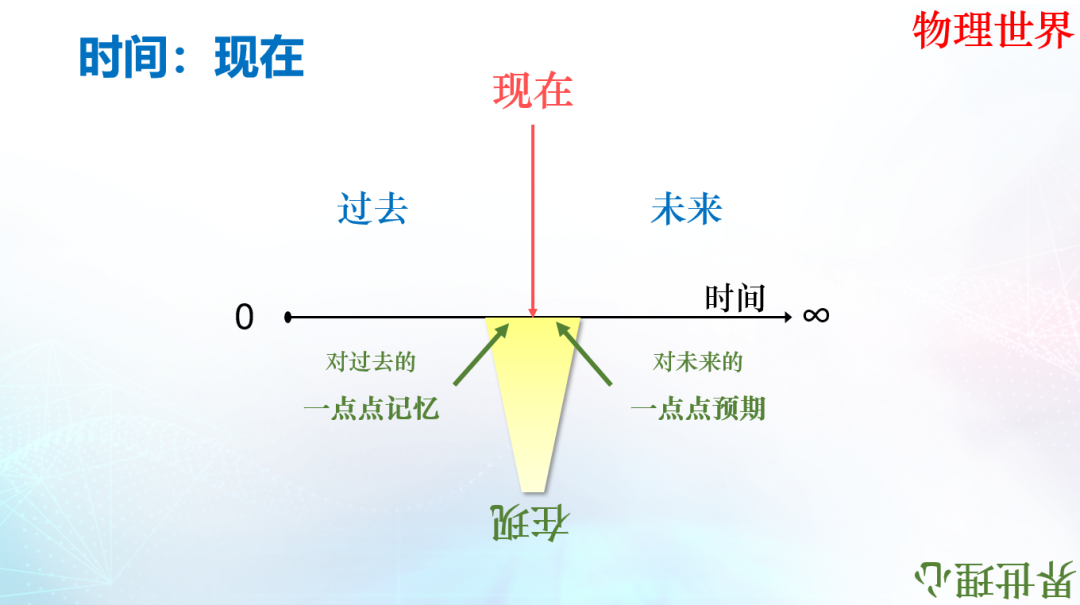

物理量和心理量不存在一一对应的线性关系,比如心理时间和物理时间,物理时间只有“过去”和“未来”,“现在”是无穷小的点,但是心理时间却只有“现在”,而没有“过去”和“未来”,“现在”对于我们来说是唯一真实的存在,是对“过去”的一点点记忆和对“未来”的一点点预期。对物理世界的时间描述转化成主观世界的时间描述是在学习生物智能如何表征时间的之前就需要考虑的问题。

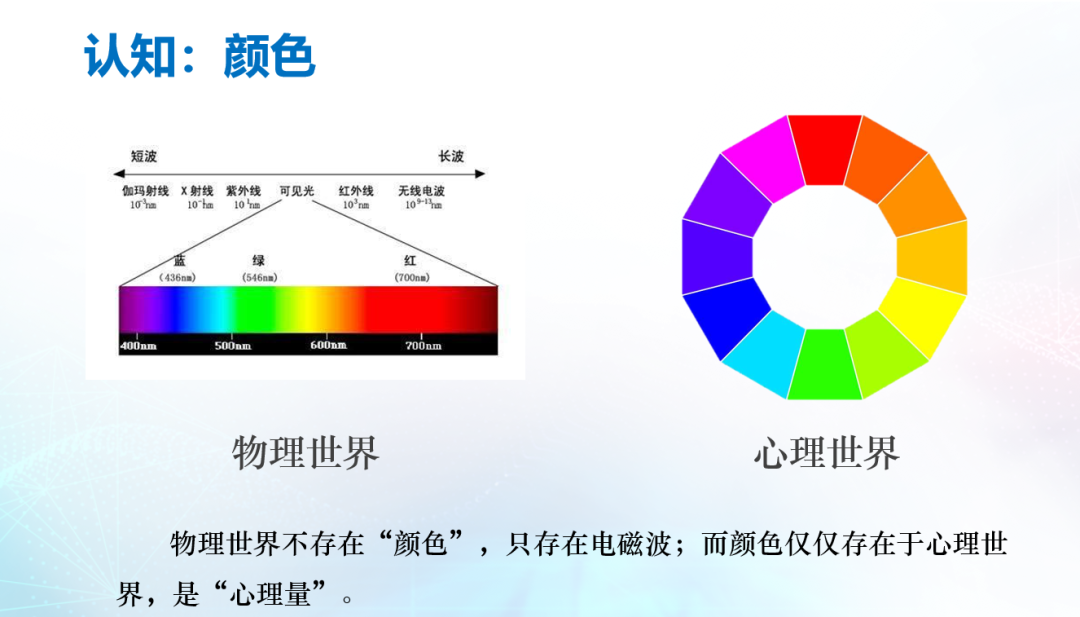

同样地,人类对于色彩的表征也和物理世界有着很大的不同,我们所感知到的不同颜色在物理世界仅仅是不同的电磁波。因此,心理世界和物理世界的法则是存在差异的, 需要新的理论来描述生物智能并引导类人智能的发展,这是脑科学和认知科学对于AI的最大意义。

03

对于人类智能的探索过程

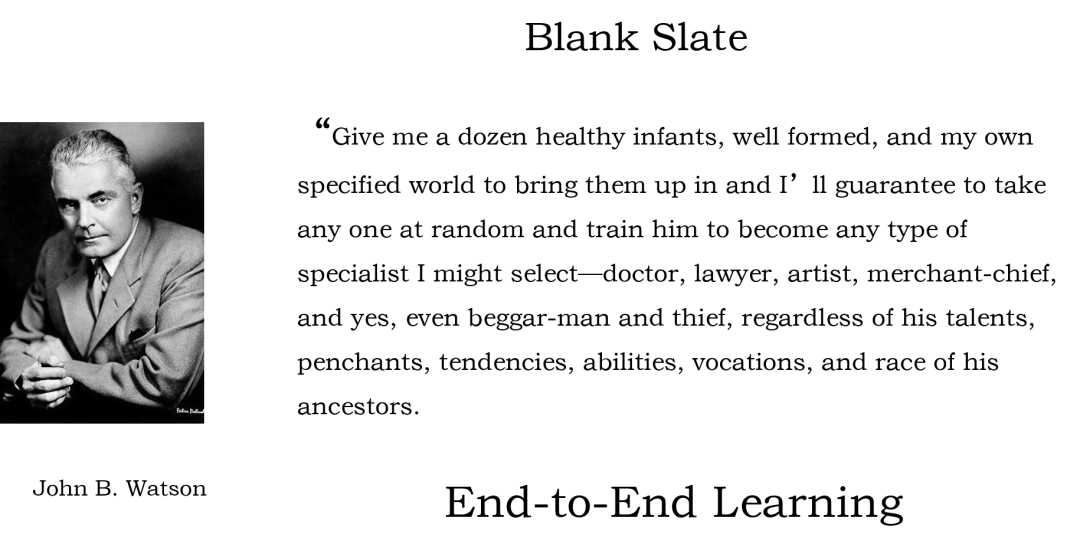

上世纪二十年代,心理学家华生(John B. Watson)提出只要给予充足的环境,可以将婴儿训练成任何预设的目标,而不需要关注其内部特征。这就是目前人工智能“端到端”训练的采用的方法,只要有足够多的数据和反馈,就可以找到二者之间的关系,这属于行为主义。

桑代克(Edward L. Thorndike)提出因果律(The law of effect)认为行为产生的结果对行为产生影响,这实际就是目前的强化学习。不论是行为主义还是巴普洛夫(Ivan Petrovich Pavlov)的条件反射实验,都把大脑当成“黑盒子”。

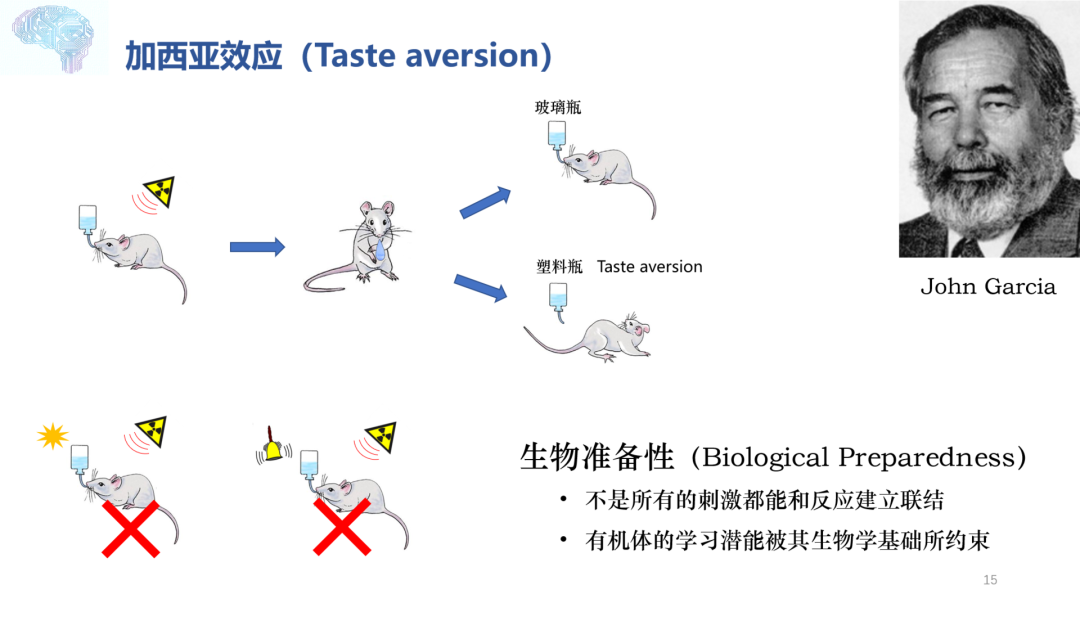

直到加西亚(John Garcia)在上世纪五十年代进行了老鼠的味觉厌恶实验,才引起了认知革命,并不是所有的刺激都能和反应建立连接,这对行为主义提出了否定,有机体的学习潜能要被其他生物学基础所约束,底层的结构会约束上层的学习机制,从此人们才开始思考认知科学。

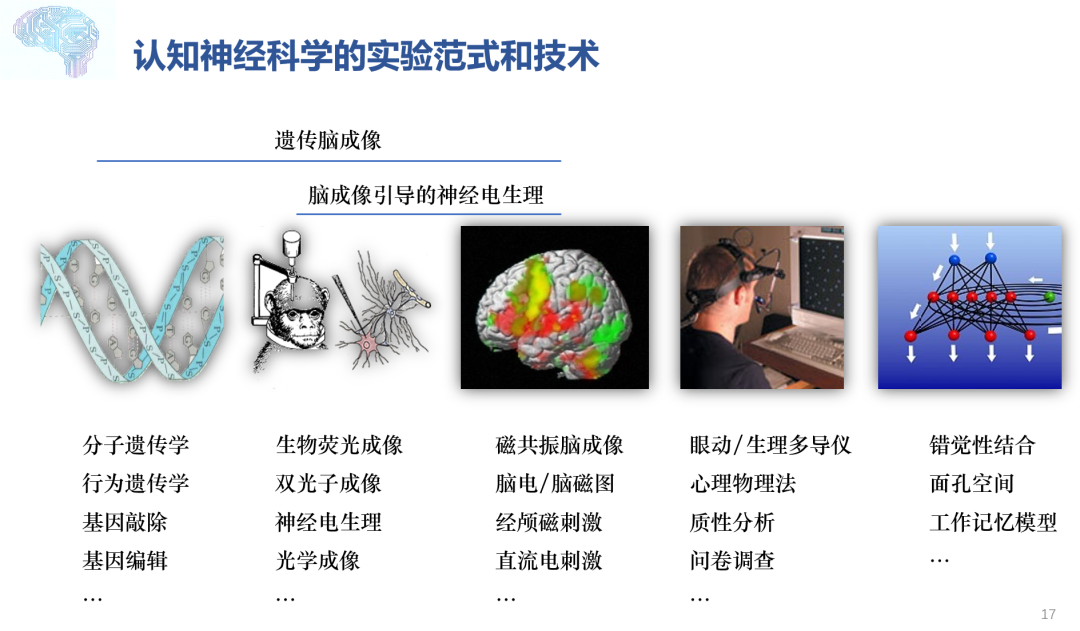

大脑并不是“黑盒子”,充满了许多“先验”、“认知加工“等机制,随着神经科学的加入,最近三十年认知神经科学取得了极大的进步,从基因、单细胞、神经环路、全脑功能、行为和仿真,形成了一整条完整的发展路径。

前沿交叉圆桌

01

必要性

问题:如果希望人工智能网络实现人类水平的认知功能,类脑或者类生物神经系统的结构特征或者算法原则和加工机制是否是必需的?如果存在功能相当的生物智能与人工智能系统,它们之间是否必然存在某种程度上的结构或功能相似性?

吴思:生物智能是智能的样板,必要性很难证明,但是人工智能可以从生物智能中学习很多,例如如何处理维度爆炸的问题。

陈良怡:不一定非要复制生物智能系统,因为不同个体的神经物理连接不同,单纯的物理连接并不一定提供普适性规律,就像我们对于象棋法则的理解需要进行很多局的观察,重点是提取内在的规则。另外计算机系统是决定性的,而生物系统是进化产生的,具有多样性,不一定是最优的,而仅是一种选择的结果,目的是群体对于环境变化具有适应性,如何从数学角度实现是需要考虑的。

孙茂松:对智能本质的理解是关键,当前对于大脑的理解尚不清晰,当务之急还是搞清楚大脑的工作机制,目前大脑还是宇宙中唯一的智能体,逻辑上还是要学习大脑,这样才有机会触及到智能本质的问题。

李国齐:人工智能有多条途径,符号主义和行为主义都遇到了瓶颈,连接主义尝试模拟大脑神经网络,借鉴人脑是一个伟大的信念,是一个值得尝试方向。

王立威:计算机中任何一个问题,最优算法都不是唯一的,从这个角度来看,实现智能可能有多条路径,借鉴生物智能最核心的是对大脑工作原理的借鉴,而目前相比于对大脑工作机制的理解而言,我们对这些原理是什么这个问题的答案还不清楚,这是更应该挖掘的问题。

张志华:机器智能要以机器为核心,对于脑科学来说,我们虽然知道智能存在,但是脑科学并不提供实现智能的途径,当前实现智能的方式还是要通过计算机或者算法来实现。

刘嘉:确定的答案很难获得,目前只能继续进行探索。

02

AI 向大脑学什么

问题:在模仿生物神经网络的时候,需要关注当下人工神经网络与生物神经网络之间可能的机制差异,并不是在大脑里的每一种结构或者机制都是与智能有关。哪些认知功能是最值得下一代人工智能来模拟或借鉴的?(大脑的特异性)另一方面,二者差异的背后可能隐藏着智能真正的本质,对揭示生物智能的独特性有重要意义,这个差异的本质是什么?大脑与当下的AI究竟有什么值得特别关注的区别?

吴思:人工智能和人类智能存在多层次的不同,首先结构不同,大脑的结构是为了解决通用问题,但是就人脸识别这一单一任务来说,并不需要复杂的结构,所以借鉴人脑需要关注任务的差异,当需要构建通用智能的时候,人脑的知识就有很高的借鉴价值;编码机制不同,神经网络的神经元反应是固定的,而生物神经元反应是随机的,人在识别过程中存在置信度水平,更复杂的情况下还受先验知识的影响,机器学习可以从这个角度进行探索。另外表征层面的差异也是值得关注的话题。

刘江:Hinton在最近的采访中也提到核心是表示层面,巨型神经活动向量(big vectors of neural activity),这是能够实现智能的方向。

陈良怡:作为一个能量资源有限的系统,生物系统重要的机制是学习、记忆以及遗忘,生物系统的变量是随时间变化的。生物运用一整套系统来学习周围的环境进而完成趋利避害等,它的个体以及群体的进化策略并不是对数量的堆叠,我们也许能模拟很复杂的人脑变量,但是能否产生多样性是值得怀疑的。

孙茂松:知识表示是很重要的问题,知识是人区别于动物的本质,向量虽然具有合理性,但是人脑是否能处理复杂的向量?用向量计算做逻辑推理也只得怀疑?知识图谱用三元组可以做推理,但是大脑是否是三元组?人的小样本学习机制,人的先验知识都值得深入探索。更大的突破还是脑科学领域,人工智能可以在这个过程中提供帮助。

李国齐:人脑的记忆、计算系统和决策系统的联合是值得借鉴的。能够在计算系统中实现记忆是非常好的研究方向,但是现有计算机体系存算分离,忆阻器系统虽然存算一体,但是并没有把记忆区分层次,如何在计算系统中存取不同层次的记忆并做出决策,是做体系架构时候需要考虑的问题。我们知道大脑的神经元是多样的,但是神经网络的神经元是相同的,要实现这样的网络模型是困难的。另外大脑是复杂的网络动力学模型,引入这样的模型可以做记忆和联想,如何反映到计算系统或者芯片上是很关键的问题,此外还包括稀疏编码,注意力机制都可以融入。在计算系统和计算架构设计中可以考虑多层次多粒度的记忆和联想机制。

王立威:换一个角度思考问题,当前的人工智能在人脸识别或者下棋等特殊的任务中的表现已经远超过人类,如果一个人不借助任何计算机工具,仅通过自主学习,从生物上提升人脸识别和下棋的能力,让他去向现在的人工智能学习,他需要学习什么?这和我们今天从人脑借鉴提高人工智能是一个等价的,对称的问题。相比于网络、权重,这时候更需要学习基础的原理,确定具体的任务,搜集很多数据,定义一个目标函数,用一些优化算法做优化都属于基础的原理。人工智能向人脑借鉴的具体内容是什么,需要两个领域共同研究,深入讨论来得到答案。

张志华:因果和反馈是值得借鉴的,因果学习和强化学习都是借鉴的产物。

03

如何开展交叉学科

问题:我们这个圆桌有来自自然语言理解、机器学习、数据挖掘、数学/统计和芯片等学科,覆盖了智源的每一个方向。您希望交叉的是哪个方向?

吴思:认知科学从概念和哲学上进行解释,数学在神经系统层面有很好的应用。

陈良怡:计算机科学,借鉴深度学习手段来更好的理解实验数据。

孙茂松:广义的脑科学,希望智源能够提供机会普及脑科学相关知识,来更好促进与人工智能融合。

李国齐:学科交叉非常重要,人工智能前沿的学者都有深厚交叉学科背景,个人希望了解神经动力学如何影响计算系统。

王立威:人工智能擅长解决具体问题,而不擅长完成综合性的复杂任务,这是生物擅长的,但是人的智能太复杂了,希望能够合作非高等生物智能研究,问题复杂度介于具体任务和高等任务之间。(陈良怡补充:很多基础的原则完全可以在更简单的生物智能中去寻找)

张志华:认知科学能够对统计学方法给出合理借鉴。

刘嘉:认知神经科学研究内容太宽泛,问题的重要性不好定义,但是人工智能给出很好的提示,希望能够和贝叶斯统计合作,用数学来描述认知过程,贝叶斯可能是最好的模式。不论如何交叉,出发点如何,交叉的领域需要不断拓宽,打破自己的认知边界。

在论坛的最后,吴思老师和刘嘉两人提出了一个值得思考的问题,如果外星人来到地球,能否和人进行交流,二者的思维方式是否相同?

![]()

![]()

![]()

点击阅读原文,查看更多精彩!

喜欢本篇内容,请分享、点赞、在看![]()