【泡泡图灵智库】O-POCO:视觉里程计和SLAM的在线点云压缩建图(ICRA)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:O-POCO: Online POint cloud COmpression mapping for visual odometry and SLAM

作者:Luis Contreras and Walterio Mayol-Cuevas

来源:ICRA2017

编译:黄文超

审核:刘小亮

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——O-POCO:视觉里程计和SLAM的在线点云压缩建图,该文章发表于ICRA2017 。

本文提出了O-POCO这一视觉里程计和SLAM系统,它能够在线决定点云中哪些用于建图、哪些应该忽略。它接受经典SfM的点云输入,并且能够在线采样,选择对6D重定位有用的地图特征。作者使用相机的移动轨迹来划分点云,使用视觉和空间信息来采样和压缩地图。作者提出并评估了诸如描述符信息的相对熵、地图特征占用网格和点云的几何误差等不同的信息层次。作者在公共的数据集和自己采集的数据集中将本文提出的系统与SfM以及ORB-SLAM进行了比较。结果表明,即使在每个关键帧中用于建图的特征数量少于四倍的情况下,作者提出的在线压缩策略也能够胜过基线系统。

主要贡献

1、提出了在线点云压缩算法O-POCO。

2、对该算法进行了评估,展示出该算法对传统 SfM 和基本ORB-SLAM算法的性能提升。

算法流程

1、根据点云建立子地图

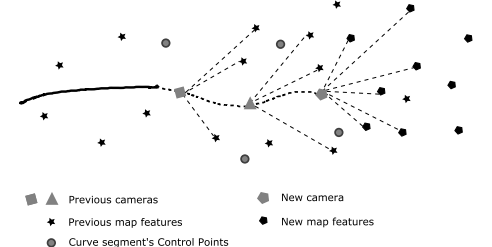

图2 O-POCO建图过程

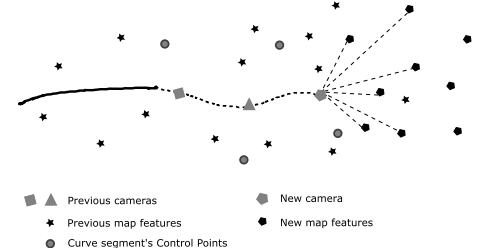

图3 关键帧建图

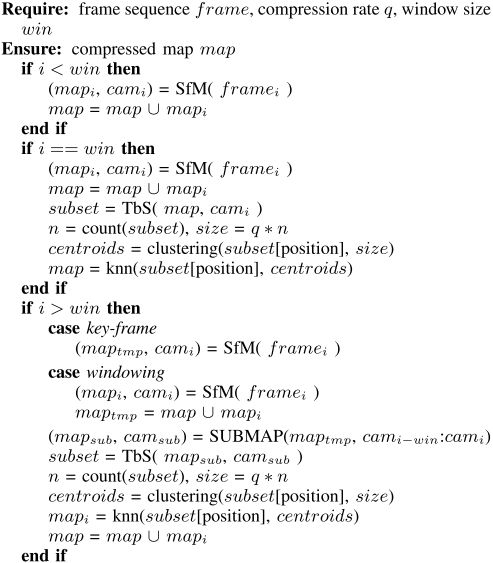

考虑一个基于滑动窗口的建图过程,该过程用当前获得的新特征和在前 n 个相机中可见的全局地图特征生成一个子地图(图2),压缩这个子地图并添加到全局地图中。此外作者还测试了另一种在线压缩方法(图3),只使用当前相机获得的特征生成子地图然后压缩,这可以看成是一种关键帧的压缩。

2、 基于轨迹的子集划分

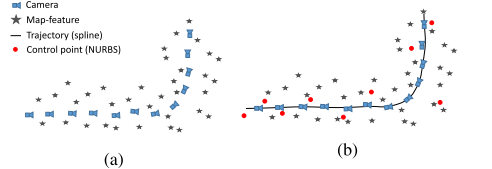

图4 轨迹曲线插值和建模

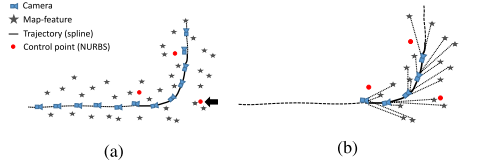

图5 划分子集过程

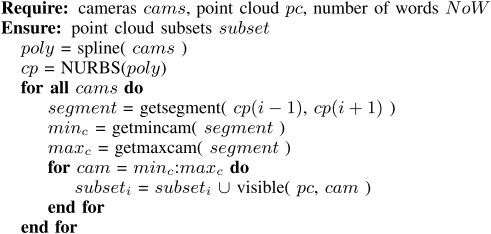

首先,插值出一条最佳拟合相机轨迹的曲线(这有利于减小噪声),使用NURBS(non-uniform rational b-splines)算法用一系列的控制点对该曲线进行建模(图4)。随后根据控制点信息把轨迹分割为几个部分,提取各个部分的地图特征子集。接着利用可见性矩阵在当前片段的点云中生成这些地图特征(图5)。作者将这个过程称为基于轨迹的子集划分(TbS)。该部分算法如下:

3、地图压缩

点的选择是根据在各子集中的地图特征的空间位置,使用 k 均值聚类这些子集。完整的压缩算法如下:

主要结果

1、视觉里程计评估

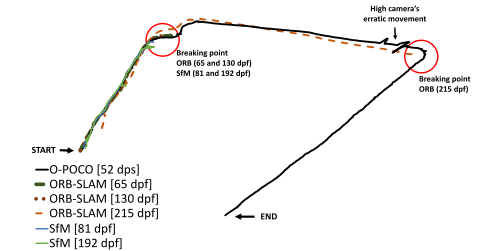

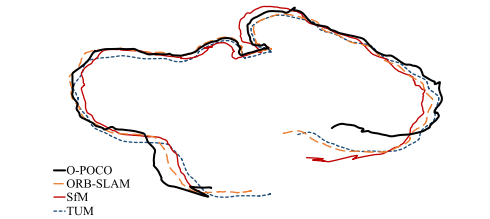

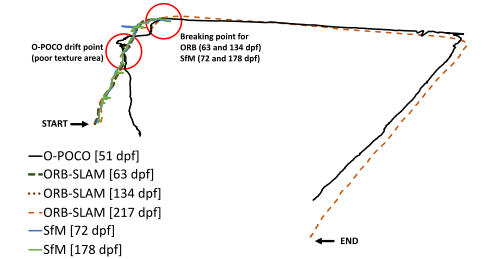

图1、10、11 展示了使用O-POCO算法对经典的SfM和ORB-SLAM算法的性能提升,特别是在缺少纹理或是相机运动不稳定的部分。其中 dpf 代表 descriptor per key-frame,指的是地图中的总点数与用于建图的关键帧数的比值,该值越小越好

2、重定位性能评估

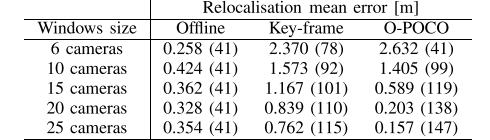

表1 重定位误差(米) 括号中的数值代表 dpf。可以看出在线压缩算法的性能取决于窗口的大小,而离线压缩算法保持在稳定的压缩率。可以看出压缩率和重定位误差是相对矛盾的存在

3、信息保留

作者对不同的信息层次进行了详尽的度量,如描述子信息的相对熵,地图特征占用网格,点云几何误差等。得出的结论是该算法对这几种信息都有较好的保留,有利于重定位,路径规划,导航等任务。

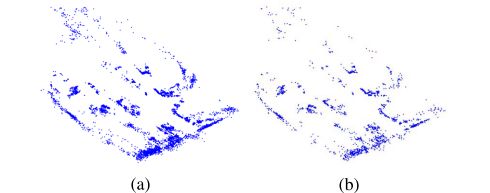

图15 几何信息保留: a)全尺寸地图;b)压缩地图 可以观察到即使点的密度变得稀疏,但是几何结构得到了保留

Abstract

This paper presents O-POCO, a visual odometry and SLAM system that makes online decisions regarding what to map and what to ignore. It takes a point cloud from classical SfM and aims to sample it on-line by selecting map features useful for future 6D relocalisation. We use the camera’s traveled trajectory to compartamentalize the point cloud, along with visual and spatial information to sample and compress the map. We propose and evaluate a number of different information layers such as the descriptor information’s relative entropy, map-feature occupancy grid, and the point cloud’s geometry error. We compare our proposed system against both SfM, and online and offline ORB-SLAM using publicly available datasets in addition to our own. Results show that our online compression strategy is capable of outperforming the baseline even for conditions when the number of features per key-frame used for mapping is four times less.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com