[DLdigest-1] 有人用量子场论来解释深度神经网络

今天开始,深度学习每日摘要将恢复每天短报的形式来分享当天的优质论文、优秀项目或优秀博客,希望以此来真正实现公众号的“每日摘要”初衷。

谈到公众号的初衷,其实我之前有注册过一个公众号,叫【CS漫谈】,那个时候是希望开通一个微信博客,以记录自己学习算法的过程,后来没有坚持写下去,我为自己找了一个停更的理由就是公众号的定位太宽泛了,没有聚焦没有重点,不容易吸引一批垂直领域的用户。

去年六月份的时候,才开始意识到自己要在深度学习方面写点什么,于是就萌发了二次注册微信公众号的想法。之所以取名为【深度学习每日摘要】,是希望自己每天都可以在深度学习上有所收获,再忙也要保持每日一更,但是后来发现如果既要保持原创内容的深度,又要保持更新频率,是很难做到的,后来就改成了知识点分享,并结合代码实践,这种每周一更的方式可以保证文章内容不会太水。

...

由于众所周知的原因,最近某些深度学习必用的知名网站打开的成功率让人失望。即便如此,我还是为大家做了一份今天的深度学习摘要,力求分享一些有用、吸引眼球的深度学习知识,文末会附有每个分享的参考链接,在微信中长按链接即可跳转到指定的参考网站。

今天看到一篇双盲审的文章,作者目前还是匿名状态,标题是“SPONTANEOUS SYMMETRY BREAKING IN DEEP NEURAL NETWORKS”,翻译成中文就是“深度神经网络中的自发对称性缺破”,挺有意思的,“自发对称性缺破”这一术语源自量子力学,文中号称深度神经网络训练的末期,其实就是网络打破了对称性,即发生了自发对称性缺破,并且文中还指出该理论可以解释为什么Residual connection更容易收敛、为什么我们可以实现对随机标签进行零误差分类等尚未解释的现象,文中公式极其繁多复杂,感兴趣的读者可以去啃一下,还顺便学了量子场论。[1]

...

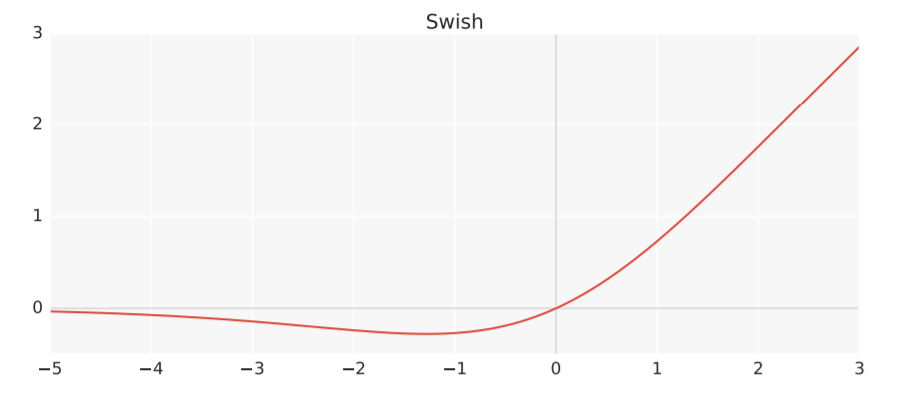

ReLU函数似乎已经作为深度神经网络激活函数的标配,因其收敛快,而谷歌的大神Quoc V. Le最近提出了一种新的激活函数,取名为Swish,形式非常简单:f(x)=x*sigmoid(x),图像如下所示,文中指出Swith在一系列任务上表现要比ReLU要好,期待TensorFlow尽快把这个函数加进去吧。[2]

...

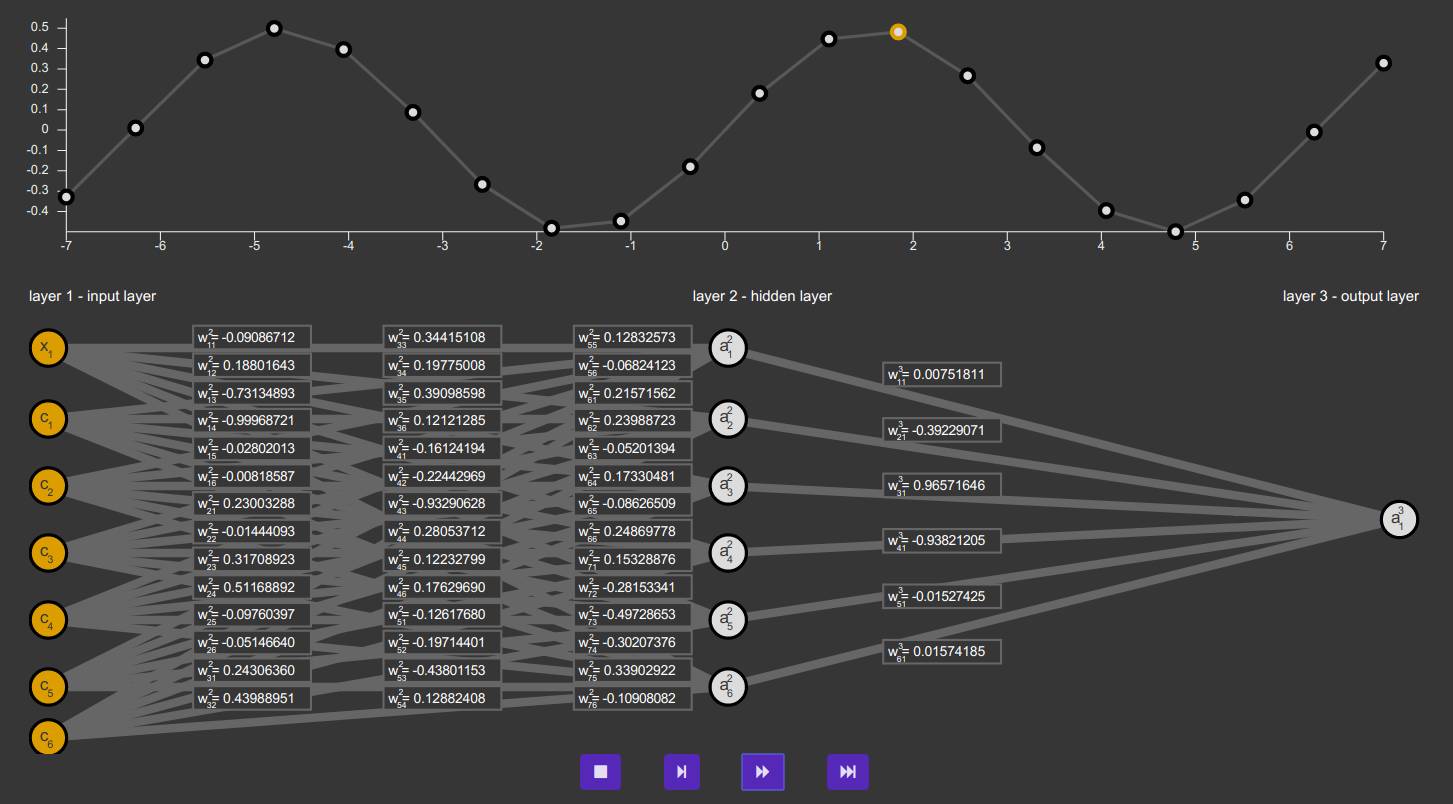

最后分享一个神经网络的可视化网站,网站效果如下图所示,可以点击鼠标观察每一步迭代参数的改变,十分直观。以线性回归器为例,你可以先随意用鼠标在坐标系中初始化一些散点,然后就可以看到线性回归是如何一步步拟合你所画的点了。[3]

参考链接(长按链接即可跳转浏览)

[1] https://openreview.net/pdf?id=SkiCjzNTZ

[2] https://arxiv.org/pdf/1710.05941.pdf

[3] https://www.mladdict.com/

【每日一道算法】

Given an array of integers, return indices of the two numbers such that they add up to a specific target.

You may assume that each input would have exactly one solution, and you may not use the same element twice.

Example:

Given nums = [2, 7, 11, 15], target = 9,

Because nums[0] + nums[1] = 2 + 7 = 9,

return [0, 1].

欢迎大家留言分享深度学习知识或交流每日一道算法的思路,本期算法的解决方法将在下一期中讲解。