【学界】图像自动合成新方法,结果逼真堪比CG|港中大英特尔CVPR论文

来源:量子位

你可能不相信,上面这张图是合成的。

CG要达到这样真实的效果,目前主流的做法是先手动建模,把物体的表面结构搭建出来,然后再贴图、定材质、上灯光,最后渲染。

深度神经网络的出现,给CG带来一道曙光。

根据大致的草图框架(也称语义布局法),深度神经网络现在可以直接合成真实效果的图片。

不过,主流图像合成所用的模型大多是参数模型(parametric models)。这种模型,所有和逼真外观有关的数据,都会体现在深度神经网络的权重里。

不过,这与人类画画的方式不太一样。

我们在画画的时候,不是完全凭记忆复刻现实的。而是把外界真实的物体当作一个参考,然后细节上微调,进行再创作。

参数模型的优点是具有高度的表现力(highly expressive),可进行端对端训练。而非参数模型(nonparametric models)的优点,是可以在测试时提取大型的真实图片数据集里的素材。

为了集结这两种模型的优势,香港中文大学联合英特尔视觉计算实验室共同研究出了一种半参数模型,简称为SIMS,相关工作论文Semi-parametric Image Synthesis已被CVPR 2018接收为口头汇报。

他们工作的思路是:

1)先用大型真实图像数据集先训练非参数模型,相当于获得了一个合成素材库。

2)然后基于语义布局(Semantic layout),把这些素材填充进去,就像一张图被分割成好几个版块之后,再往上打补丁充实细节。

“语义布局”处理,相当于是个草图,指导合成用的

接缝的地方,深度网络会自行融合,并计算好版块之间物体的空间关系,进一步加强视觉的真实效果。

实验结果非常不错。

SIMS合成的效果

在Cityspaces、NYU、ADE20K等数据集上训练得到的效果,真实程度比去年8月量子位报道过的合成方法提高了不少。

对比上下图,你会发现,SIMS合成的图在清晰度上,光线折射关系上,都有出色的表现。物体融合的时候也不会发生扭曲。

去年方法的效果

语义布局合成法,也正是本论文的两位作者——英特尔实验室视觉组主管Vladlen Koltun与的陈启峰提出的。

换句话说,这篇论文是在陈启峰和Koltun之前工作的基础上,作出了进一步的优化。

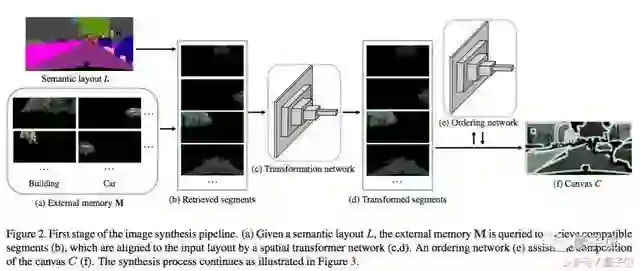

图片的合成流水线

首先,给一个草图。告诉模型,你想合成的图片布局是什么样的。就像下图最左上的小图那样。

另外,也要砌一个素材库。

巧妇难为无米之炊。模型并不能自己瞎开脑洞编造合成用的素材。得“吃”大量的真实图片之后建一个记忆库(External Memory Bank)。

这两步完成后,模型就根据草图切割的形状,提取出记忆库里能对上号的素材,比如说路边的建筑啊,停放好的车辆,以及树啥的。如(b)图所示。

合适的素材拎出来,Transformation网络负责微调,使得各版块的素材之间二维融合的效果比较好,不至于看起来很突兀。

最后,Ordering网络计算出这些板块的空间位置,给予适当的光影关系,合成一幅逼真的图片。

OMT

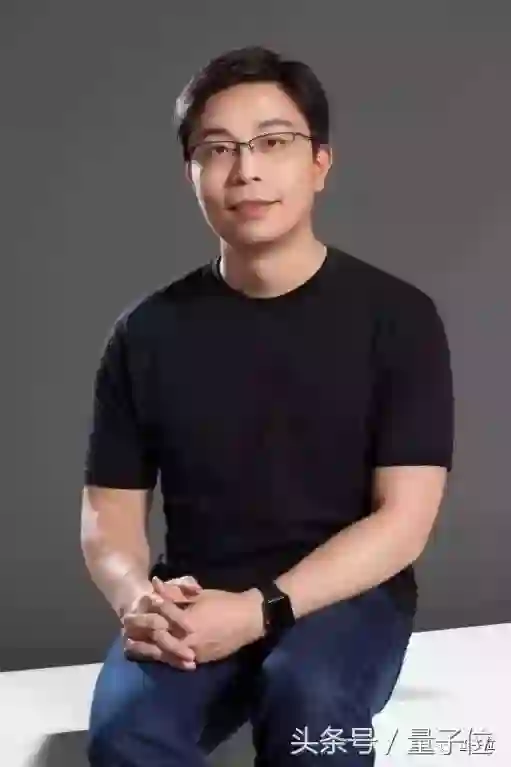

这篇论文的一作和导师都很有来头。

先来介绍一下一作,齐晓娟。

齐晓娟,香港中文大学计算机科学与工程系4年级博士生,本科就读于上海交大电子科学与技术专业。

目前研究方向主要是计算机视觉,深度网络和医学影像分析。目前攻克的课题集中在语义分割,3D场景理解和图像合成上。

据GitHub上的资料介绍,她已有三篇文章被CVPR2018收录。

除了半参数图像合成这篇,另外两篇分别是GeoNet: Geometric Neural Network for Joint Depth and Surface Normal Estimation,Referring Image Segmentation via Recurrent Refinement Networks。

齐晓娟曾在英特尔视觉计算实验室(Intel Visual Computing Lab)实习过半年,师从Vladlen Koltun,研究课题就是图像合成。Vladlen Koltun也是本篇论文的作者之一。

导师贾佳亚博士,不仅是香港中文大学计算机科学与工程系的终生教授,还是腾讯优图实验室的杰出科学家。

贾佳亚教授于去年5月加入腾讯优图实验室。随后组建团队,打造出了好几个产品应用。那个刷爆了票圈的军装照,还有“一键卸妆”应用,都出自他们团队。

在贾佳亚教授的带领下,腾讯优图实验室在ICCV 2017顶会上取得了十分漂亮的成绩单,共有12篇论文入围。今年的CVPR,贾佳亚教授团队一共中了6篇论文。

二作陈启峰的经历也十分传奇。

曾放弃清华保送的资格。本科就读于香港科技大学,并获取2011年的ACM国际大学生程序设计竞赛金牌。本科毕业后,一举拿下九所名校全额奖学金offer,最后他选择了斯坦福。现在英特尔实验室任研究人员。

最后,附code:

https://github.com/xjqicuhk/SIMS

以及论文:

http://vladlen.info/papers/SIMS.pdf

☞【学界】OpenPV:中科院研究人员建立开源的平行视觉研究平台

☞【征稿通知】IEEE IV 2018“智能车辆中的平行视觉”研讨会

☞【征稿】神经计算专刊Virtual Images for Visual Artificial Intelligence

☞【学界】ParallelEye:面向交通视觉研究构建的大规模虚拟图像集

☞【CFP】Virtual Images for Visual Artificial Intelligence

☞【最详尽的GAN介绍】王飞跃等:生成式对抗网络 GAN 的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王飞跃教授:生成式对抗网络GAN的研究进展与展望

☞【智能自动化学科前沿讲习班第1期】王坤峰副研究员:GAN与平行视觉

☞【重磅】平行将成为一种常态:从SimGAN获得CVPR 2017最佳论文奖说起

☞【学界】ETH Zurich提出新型网络「ROAD-Net」,解决语义分割域适配问题