每日三篇 | KMNIST数据集;DropMax正则化;Inst2Vec程序指令嵌入

KMNIST Dataset

MNIST不能代表现代计算机视觉任务,深度学习社区在这一方面已经取得共识。新版的TensorFlow入门文档就把MNIST换成了Fashion-MNIST。而CODH在NIPS 2018上发表的KMNIST数据集则是另一个MNIST替代品。该数据集的任务是分类日文崩し字(日文古籍常用的书写体)。类似MNIST,KMNIST包含70000张28x28的灰度图像,共有10个分类。

地址:http://codh.rois.ac.jp/kmnist/

DropMax: Adaptive Variational Softmax

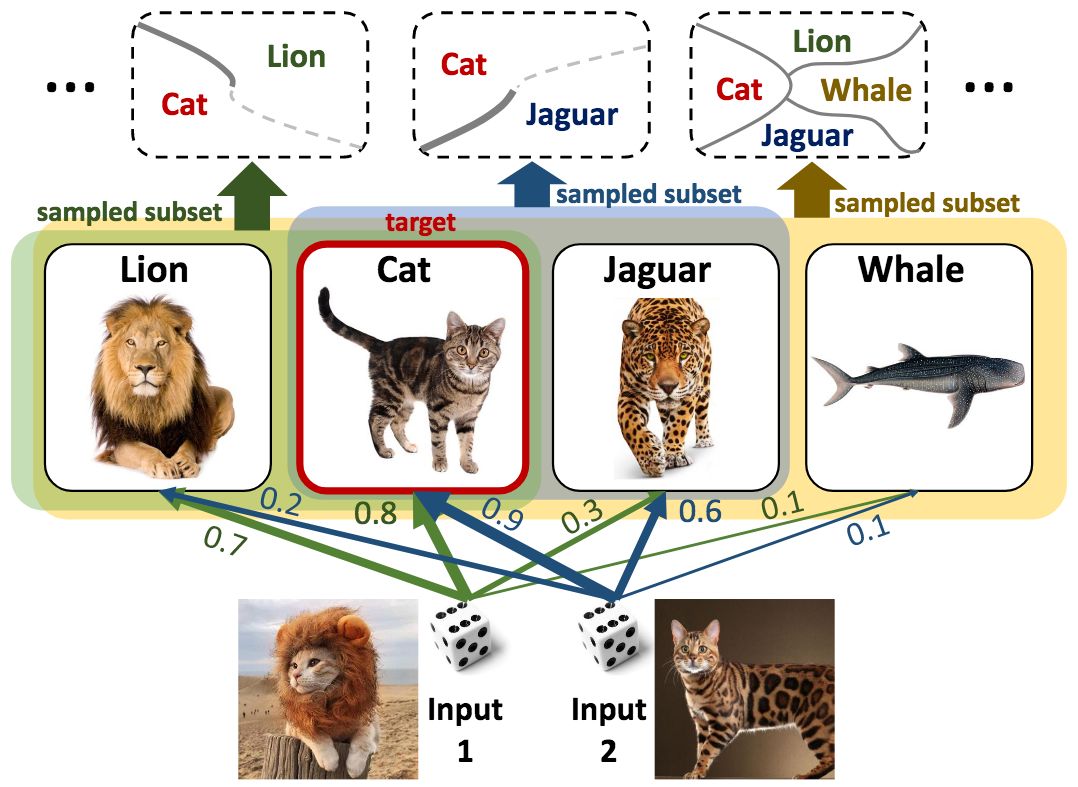

韩国科学技术学院和牛津大学的研究人员在NIPS 2018上提出了一种新的随机softmax分类器,DropMax。DropMax在每次迭代中随机抛弃一些非目标分类,从而起到正则化作用。某种意义上,这种做法有点像boosting集成学习。因为分类任务中softmax层几乎是标配,所以DropMax的适用范围很广,可以应用于各种网络架构。

地址:http://papers.nips.cc/paper/7371-dropmax-adaptive-variational-softmax

Neural Code Comprehension: A Learnable Representation of Code Semantics

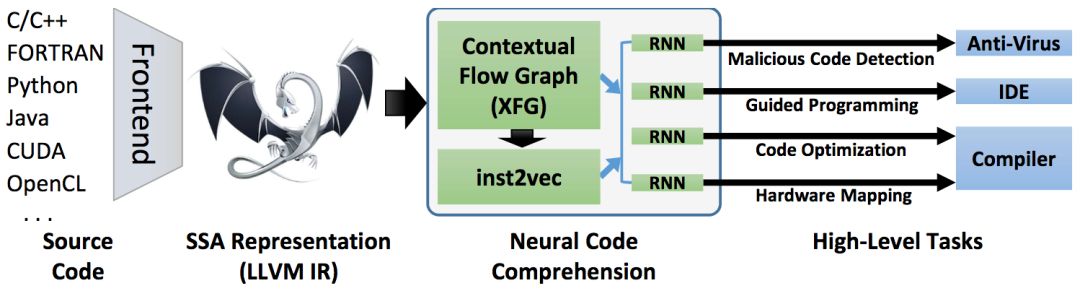

ETH的Tal Ben-Nun、Alice Shoshana Jakobovits、Torsten Hoefler在NIPS 2018上发表了一种新的学习代码语义的技术,基于独立于源编程语言的中间表示(IR)学习指令嵌入Inst2Vec。

地址:http://papers.nips.cc/paper/7617-neural-code-comprehension-a-learnable-representation-of-code-semantics

登录查看更多

相关内容

MNIST 数据集来自美国国家标准与技术研究所, National Institute of Standards and Technology (NIST). 训练集 (training set) 由来自 250 个不同人手写的数字构成, 其中 50% 是高中学生, 50% 来自人口普查局 (the Census Bureau) 的工作人员. 测试集(test set) 也是同样比例的手写数字数据。

Arxiv

3+阅读 · 2018年5月31日