ICLR 引用量最高的10篇论文!Adam霸榜!引用量破5万

点击上方“CVer”,选择加"星标"置顶

重磅干货,第一时间送达

前言

三大CV顶会引用量最高的10篇论文均已整理完毕,详见:

接下来,Amusi 将继续整理其他顶会,像NeurIPS、ICLR、ICML上也有很多优质的CV论文,而且有更多深度学习、机器学习基础性研究工作。

ICLR,全称为「International Conference on Learning Representations」,2013 年才刚刚成立了第一届。相当"年轻"的会议,但已经被学术研究者们广泛认可,被认为「深度学习的顶级会议」。在谷歌发布的2020年的学术指标(Scholar Metrics)榜单,ICLR 位列总榜第17位!这个排名是依据过去五年发表研究的数据(覆盖2015-2019年发表的文章),并包括截止2020年6月在谷歌学术中被索引的所有文章的引用量。

本文就来盘点ICLR 2015-2019年引用量最高的10篇论文。根据此数据,一方面能看出这段深度学习黄金时期的研究热点,另一方面查漏补缺,看看这些必看的Top级论文是不是都掌握了。

注1:2015年之前的论文不在统计范围内

注2:引用量是根据谷歌给出的数据,会有波动,但影响不大

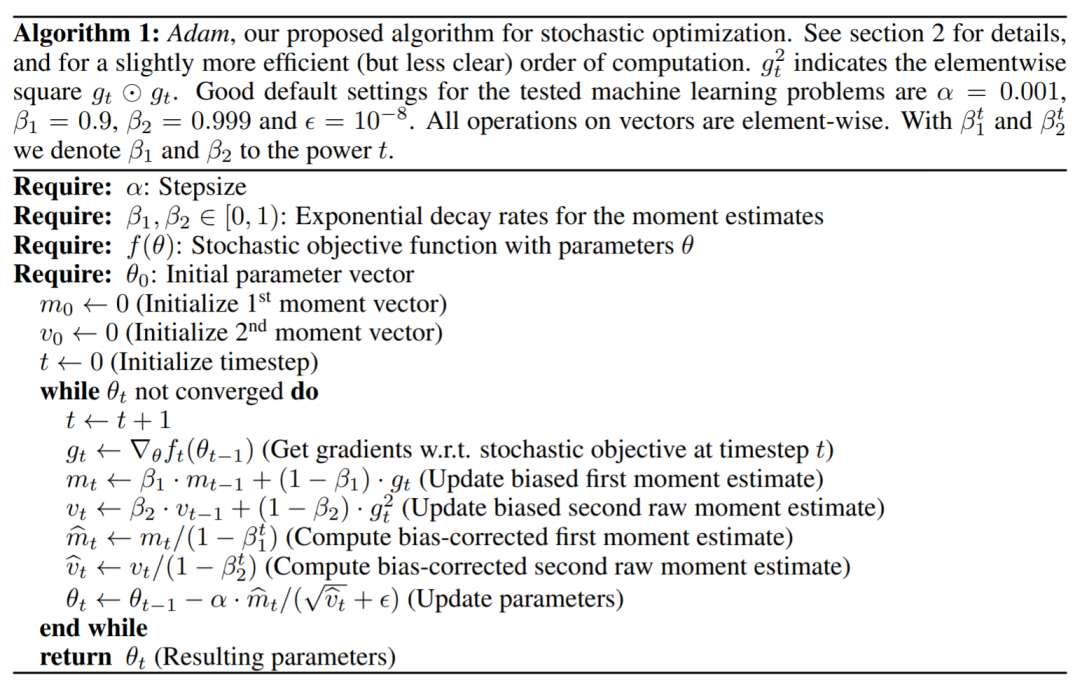

第一名:Adam

Adam: A Method for Stochastic Optimization

作者单位:阿姆斯特丹大学, OpenAI, 多伦多大学

作者团队:Diederik P. Kingma, Jimmy Ba

引用量:47774(截止目前是50344)

论文链接(收录于ICLR 2015):

https://arxiv.org/abs/1412.6980

Adam是近年来,最广泛被使用的优化器之一。其结合了AdaGrad和RMSProp两种优化算法的优点,利用梯度的一阶矩估计和二阶矩估计动态调整每个参数的学习率。

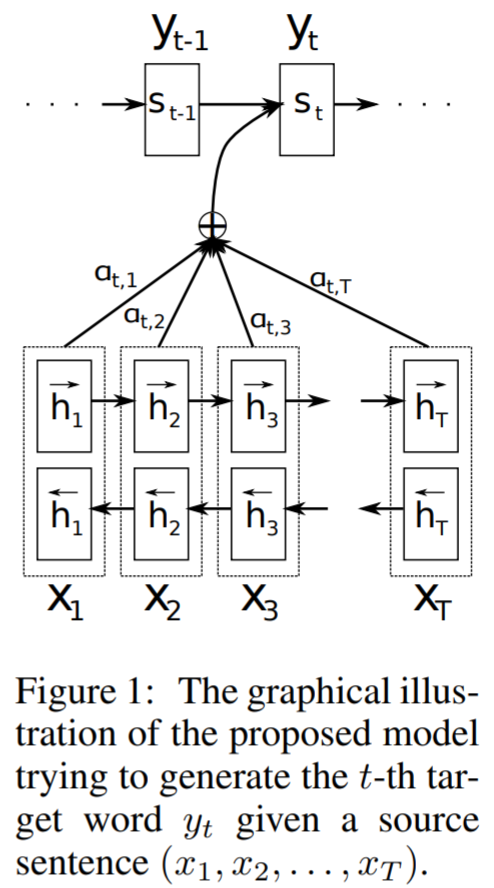

第二名:Neural Machine Translation by Jointly Learning to Align and Translate

Neural Machine Translation by Jointly Learning to Align and Translate

作者单位:不来梅雅各布大学, 蒙特利尔大学

作者团队:Dzmitry Bahdanau, Kyunghyun Cho, Yoshua Bengio

引用量:13000

论文链接(收录于ICLR 2015):

https://arxiv.org/abs/1409.0473

据了解,这篇论文是第一次将注意力机制应用到NLP领域,其使用类似attention的机制在机器翻译任务上将翻译和对齐同时进行。

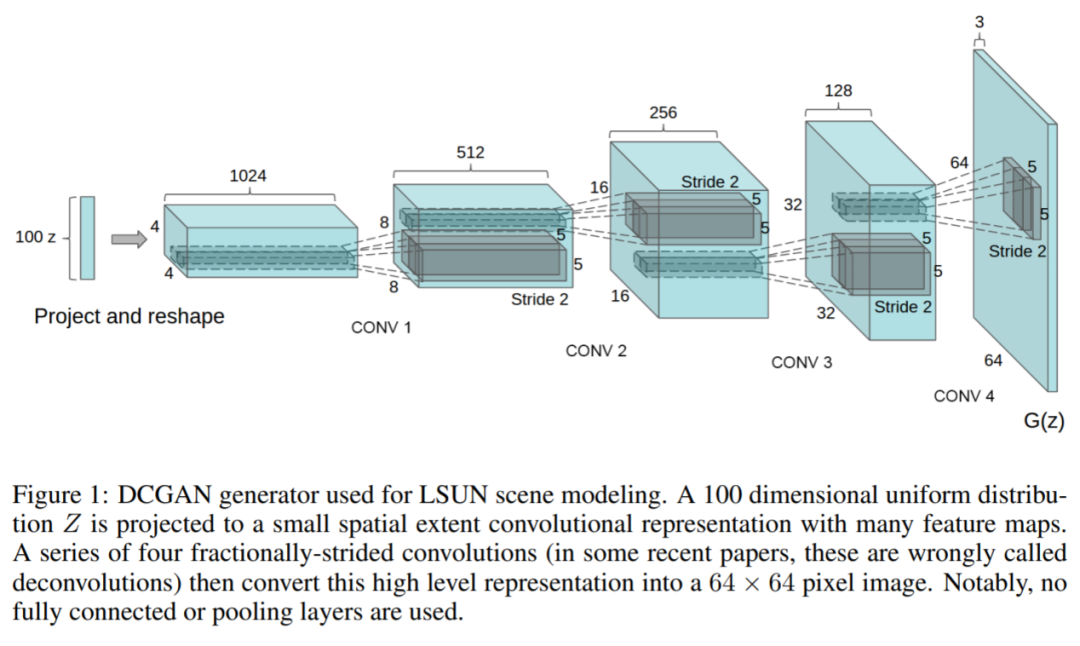

第三名:DCGAN

Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks

作者单位:indico Research, Facebook AI Research

作者团队:Alec Radford, Luke Metz, Soumith Chintala

引用量:6544

论文链接(收录于ICLR 2016):

https://arxiv.org/abs/1511.06434

本文提出一些技巧,来提升GAN的稳定性。DCGAN 就是GAN的变体,其将卷积引入到网络中。

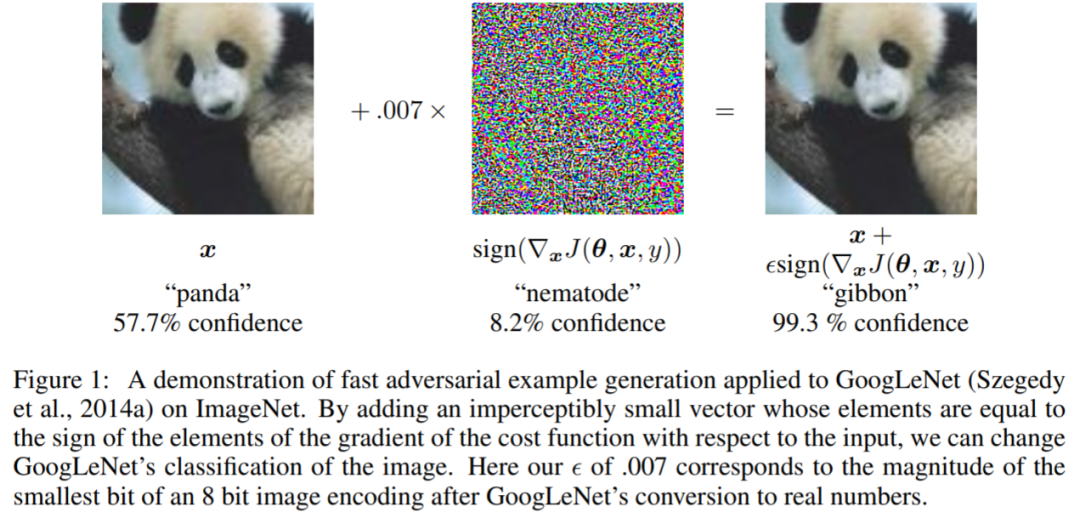

第四名:Explaining and Harnessing Adversarial Examples

Explaining and Harnessing Adversarial Examples

作者单位:谷歌

作者团队:Ian J. Goodfellow, Jonathon Shlens, Christian Szegedy

引用量:4827

论文链接(收录于ICLR 2015):

https://arxiv.org/abs/1412.6572

本文定量分析来解释Adversarial Example(对抗样本)在不同网络,不同数据集能够work的原因,并提出一种快速生成AdversarialExample的方法。

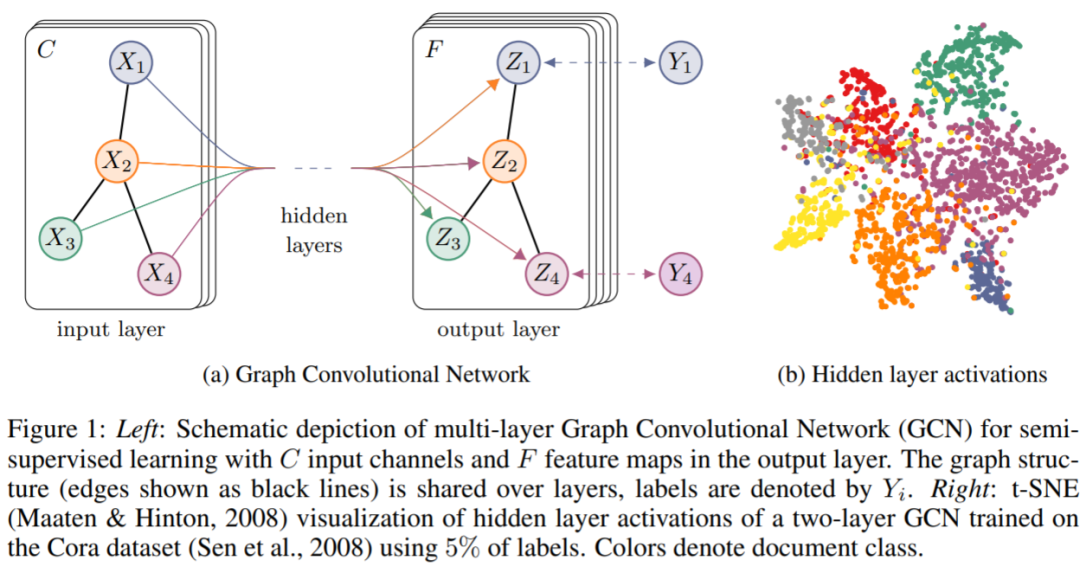

第五名:Semi-Supervised Classification with Graph Convolutional Networks

Semi-Supervised Classification with Graph Convolutional Networks

作者单位:阿姆斯特丹大学, CIFAR

作者团队:Thomas N. Kipf, Max Welling

引用量:4036

论文链接(收录于ICLR 2017):

https://arxiv.org/abs/1609.02907

本篇文章的主要工作是将卷积扩展到图结构的数据中,能够得到比较好的数据表示,并且在半监督任务中也取得了不错的效果。

注:图卷积网络,半监督都是目前大热的方向,或者说应用结合

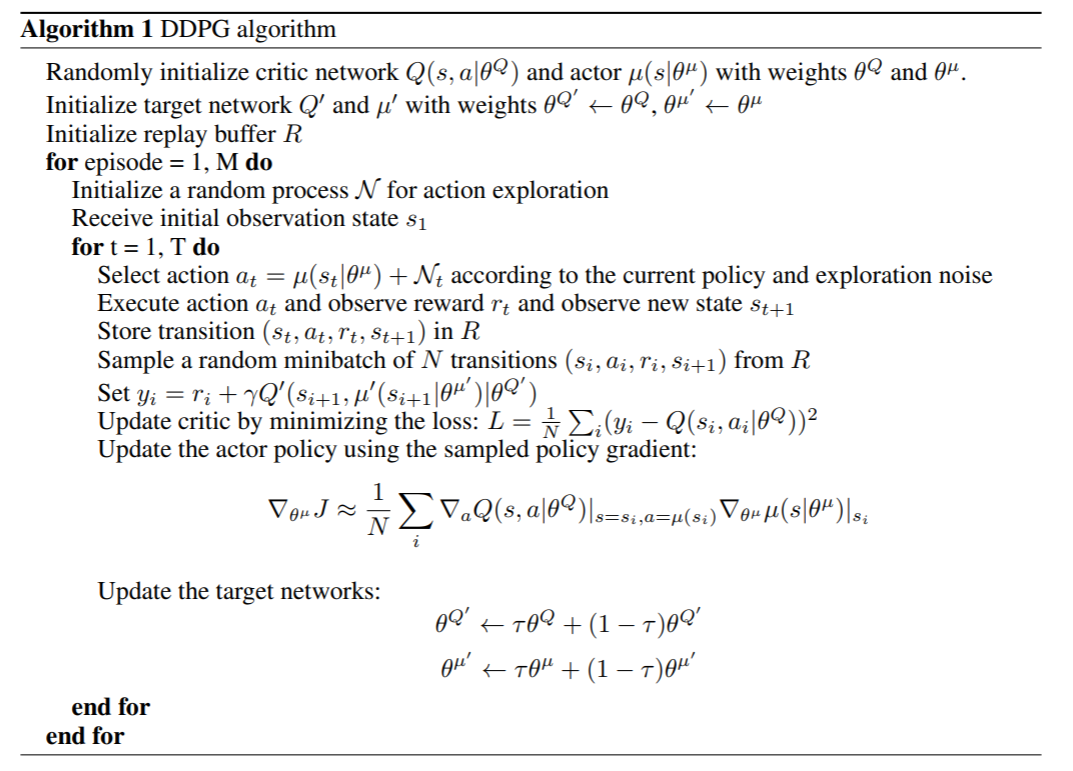

第六名:DDPG

Continuous control with deep reinforcement learning

作者单位:Deepmind(谷歌)

作者团队:Timothy P. Lillicrap, Jonathan J. Hunt, Alexander Pritzel等

引用量:3683

论文链接(收录于ICLR 2016):

https://arxiv.org/abs/1509.02971

将Deep Q-Learning应用到连续动作领域continuous control(比如机器人控制)

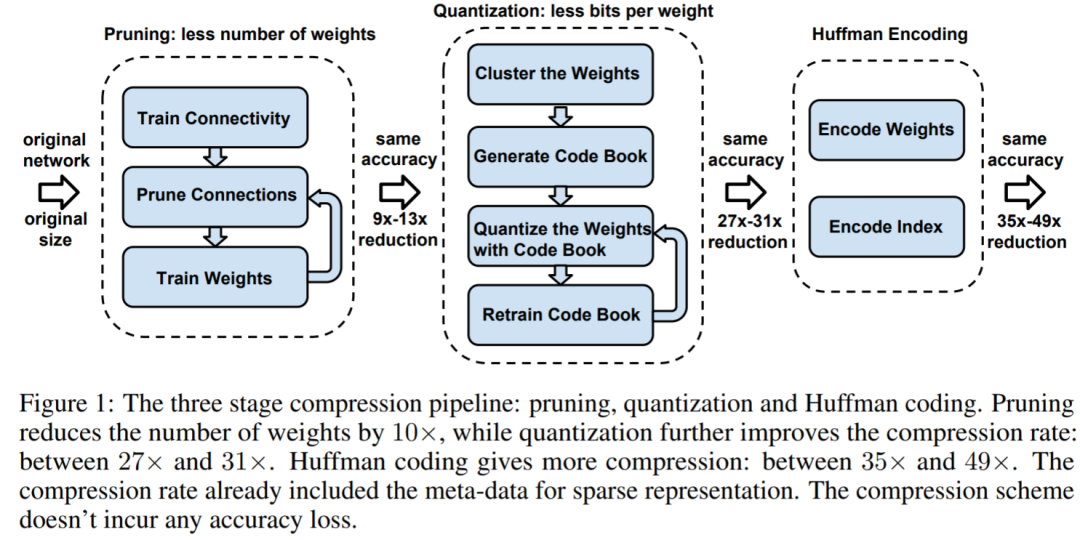

第七名:Deep Compression

Deep Compression: Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffman Coding

作者单位:斯坦福大学, 清华大学, NVIDIA

作者团队:Song Han(韩松), Huizi Mao, William J. Dally

引用量:3559

论文链接(收录于ICLR 2016):

https://arxiv.org/abs/1510.00149

Deep Compression 获得ICLR 2016 最佳论文(Best Paper),实现了剪枝、量化和霍夫曼编码三大模型压缩任务。

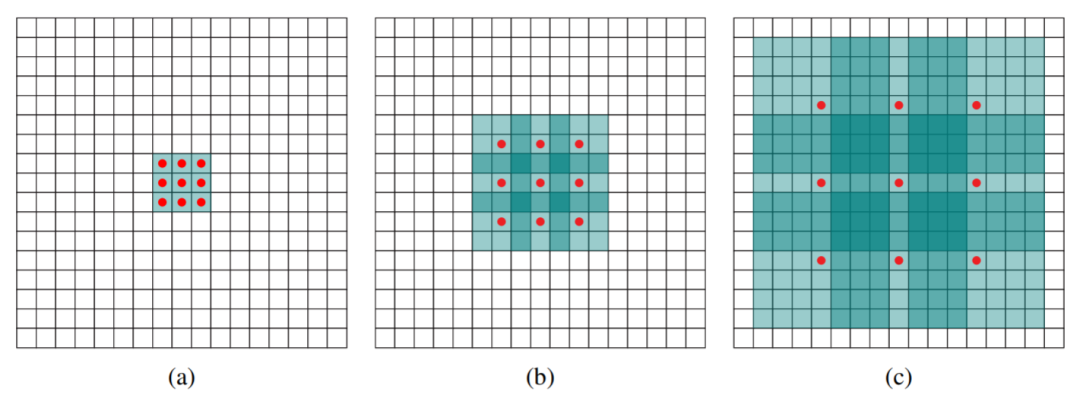

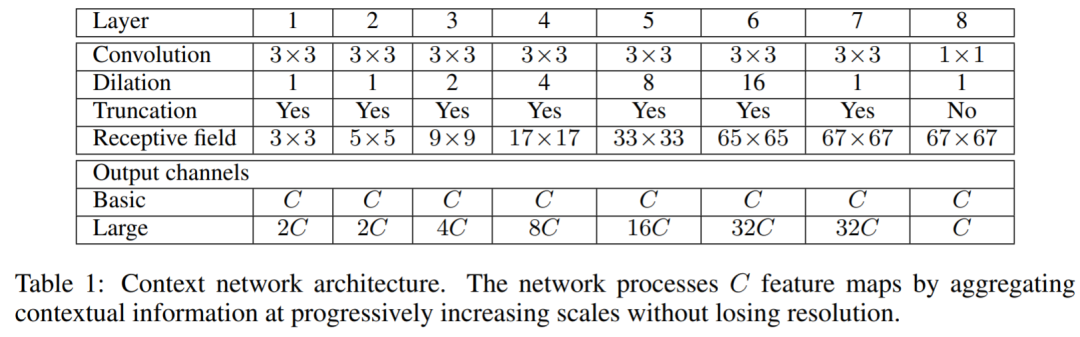

第八名:Multi-Scale Context Aggregation by Dilated Convolutions

Multi-Scale Context Aggregation by Dilated Convolutions

作者单位:普林斯顿大学, Intel Labs

作者团队:Fisher Yu, Vladlen Koltun

引用量:3314

论文链接(收录于ICLR 2016):

https://arxiv.org/abs/1511.07122

本文提出使用 dilated convolutions(空洞卷积或者扩张卷积) 得到multi-scale context 信息来提升语义分割性能。

如今在语义分割领域,dilated convolutions已经成为必备的涨点神器!

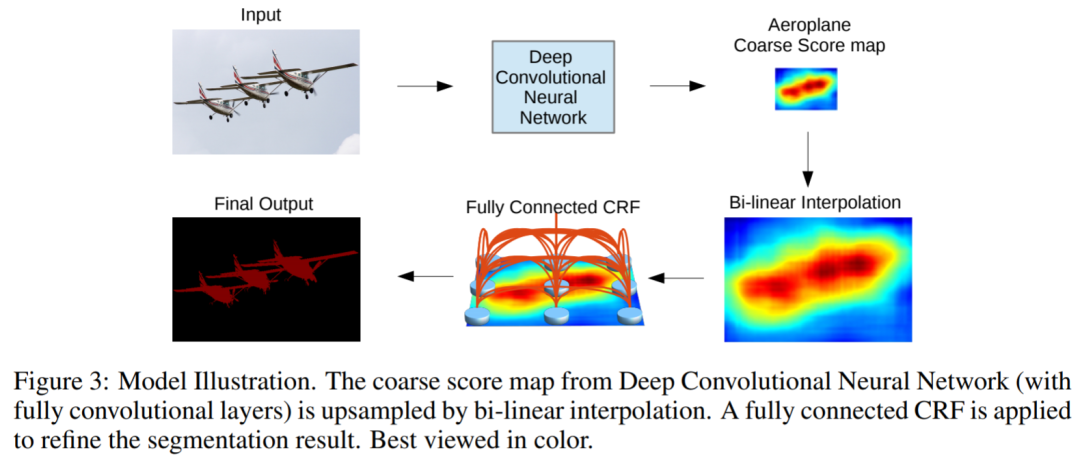

第九名:DeepLabv1

Semantic Image Segmentation with Deep Convolutional Nets and Fully Connected CRFs

作者单位:UCLA, 谷歌等

作者团队:Liang-Chieh Chen, George Papandreou, Iasonas Kokkinos等

引用量:2496

论文链接(收录于ICLR 2015):

https://arxiv.org/abs/1412.7062

DeepLab 系列开山之作!DeepLabv1-v3+ 成为语义分割最知名也是最具影响力的论文系列工作。

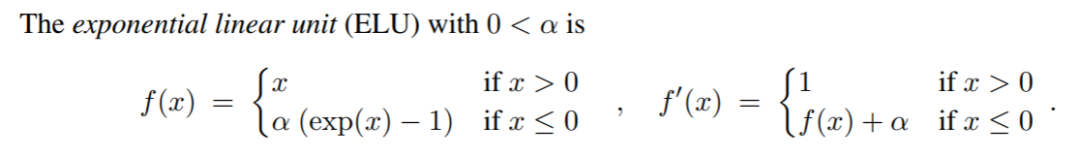

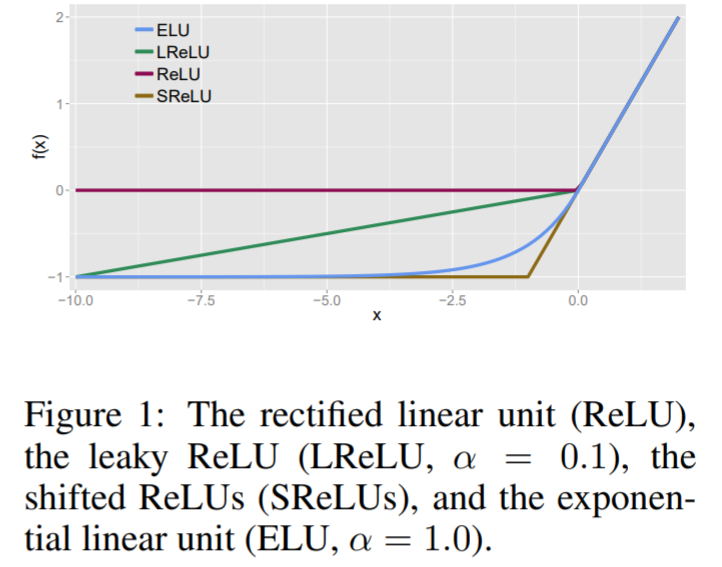

第十名:ELUs

Fast and Accurate Deep Network Learning by Exponential Linear Units (ELUs)

作者单位:约翰尼斯·开普勒林茨大学

作者团队:Djork-Arné Clevert, Thomas Unterthiner, Sepp Hochreiter

引用量:2436

论文链接(收录于ICLR 2016):

https://arxiv.org/abs/1511.07289

ELUs(exponential linear unit,指数线性单元),它试图将激活函数的平均值接近零,从而加快学习的速度。同时,它还能通过正值的标识来避免梯度消失的问题

侃侃

1. Adam 引用量超过其他9篇引用量之和

2. 谷歌有三篇论文入围;

3. 阿姆斯特丹大学有两篇论文以第一作者单位入围;

下载1

上述10篇论文已打包好,在CVer公众号后回复:ICLR引用量,即可下载全部论文

下载2

在CVer公众号后台回复:OpenCV书籍,即可下载《Learning OpenCV 3》书籍和源代码。注:这本书是由OpenCV发起者所写,是官方认可的书籍。其中涵盖大量图像处理的基础知识介绍,虽然API还是基于OpenCV 3.x,但结合此书和最新API,可以很好的学习OpenCV。

下载3

在CVer公众号后台回复:CVPR2020,即可下载CVPR2020 2020代码开源的论文合集

在CVer公众号后台回复:ECCV2020,即可下载ECCV 2020代码开源的论文合集

重磅!CVer-论文写作与投稿交流群成立

扫码添加CVer助手,可申请加入CVer-论文写作与投稿 微信交流群,目前已满2000+人,旨在交流顶会(CVPR/ICCV/ECCV/ICML/ICLR/AAAI等)、顶刊(IJCV/TPAMI等)、SCI、EI等写作与投稿事宜。

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如论文写作+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加微信群

▲长按关注CVer公众号

整理不易,请给CVer点赞和在看!