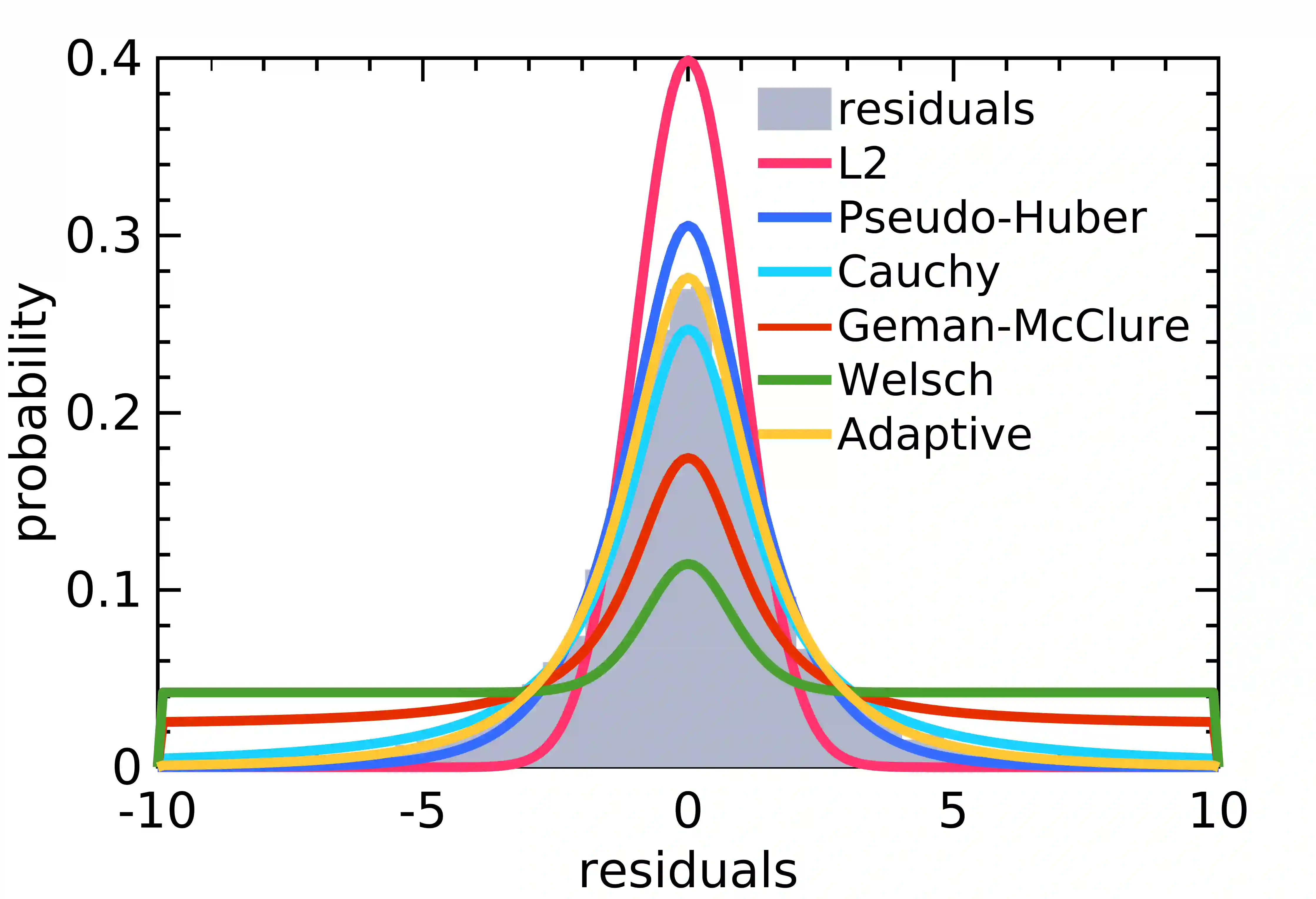

State estimation is a key ingredient in most robotic systems. Often, state estimation is performed using some form of least squares minimization. Basically, all error minimization procedures that work on real-world data use robust kernels as the standard way for dealing with outliers in the data. These kernels, however, are often hand-picked, sometimes in different combinations, and their parameters need to be tuned manually for a particular problem. In this paper, we propose the use of a generalized robust kernel family, which is automatically tuned based on the distribution of the residuals and includes the common m-estimators. We tested our adaptive kernel with two popular estimation problems in robotics, namely ICP and bundle adjustment. The experiments presented in this paper suggest that our approach provides higher robustness while avoiding a manual tuning of the kernel parameters.

翻译:国家估算是大多数机器人系统的一个关键要素。 通常,国家估算是使用某种形式的最小平方最小化来进行。 基本上,所有在现实世界数据方面起作用的最小化错误程序都使用强力内核作为处理数据外部线的标准方法。 然而,这些内核往往是手工挑选的,有时是不同的组合,其参数需要针对特定问题手工调整。 在本文中,我们建议使用一个普遍稳健的内核系,该系根据残留物的分布自动调整,并包括共同的内核。 我们用机器人的两个流行的估计问题,即比较方案(CICP)和捆绑调整(捆绑)测试了我们的适应内核。 本文中介绍的实验表明,我们的方法在避免人工调整内核参数的同时提供了更高的稳健性。