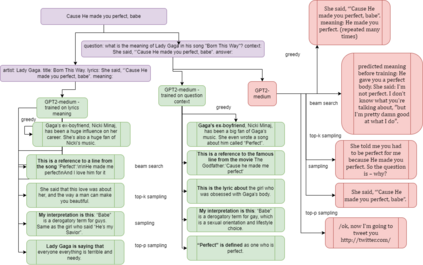

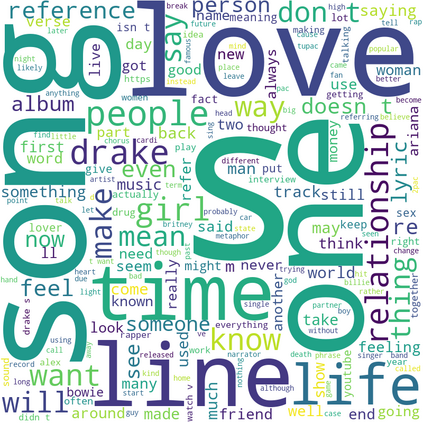

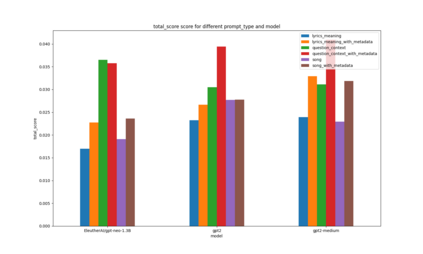

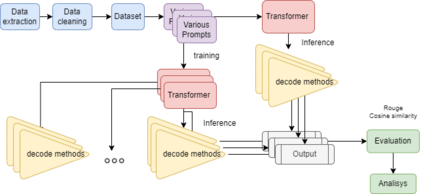

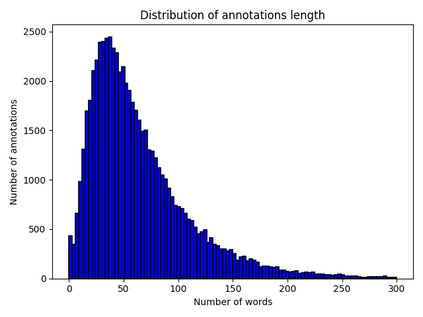

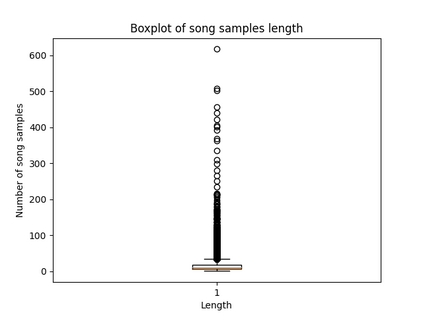

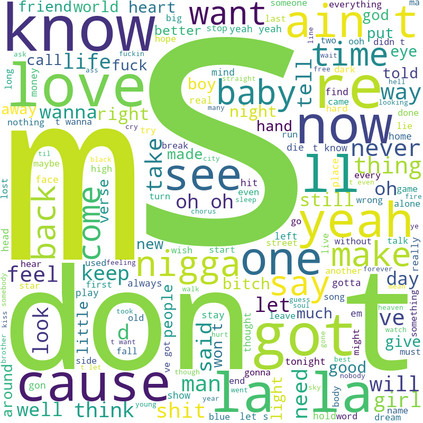

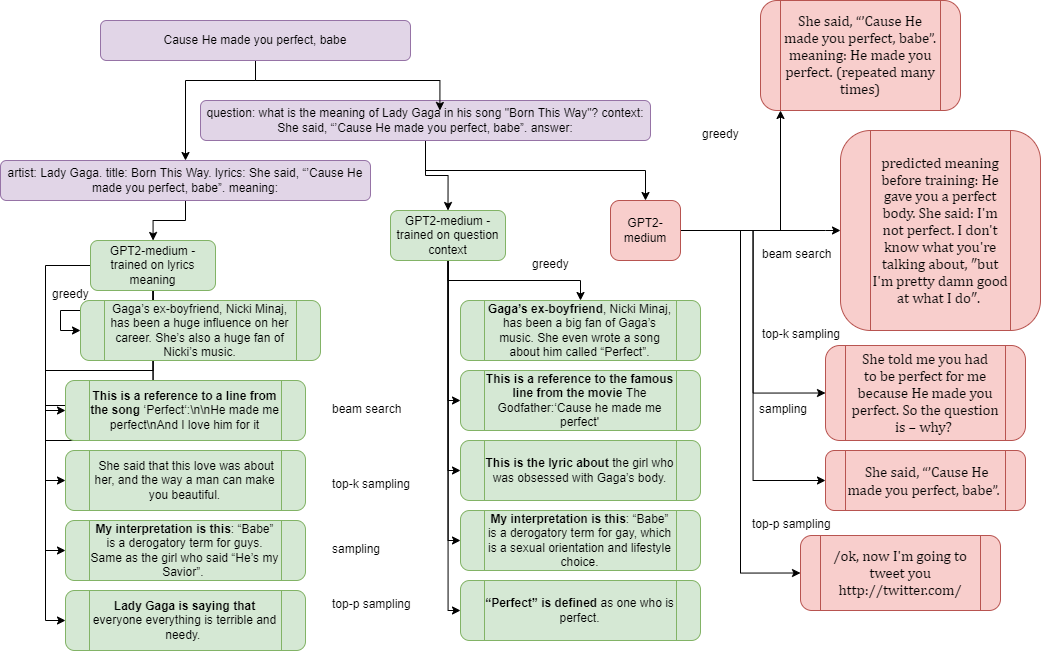

Even for us, it can be challenging to comprehend the meaning of songs. As part of this project, we explore the process of generating the meaning of songs. Despite the widespread use of text-to-text models, few attempts have been made to achieve a similar objective. Songs are primarily studied in the context of sentiment analysis. This involves identifying opinions and emotions in texts, evaluating them as positive or negative, and utilizing these evaluations to make music recommendations. In this paper, we present a generative model that offers implicit meanings for several lines of a song. Our model uses a decoder Transformer architecture GPT-2, where the input is the lyrics of a song. Furthermore, we compared the performance of this architecture with that of the encoder-decoder Transformer architecture of the T5 model. We also examined the effect of different prompt types with the option of appending additional information, such as the name of the artist and the title of the song. Moreover, we tested different decoding methods with different training parameters and evaluated our results using ROUGE. In order to build our dataset, we utilized the 'Genious' API, which allowed us to acquire the lyrics of songs and their explanations, as well as their rich metadata.

翻译:即便对于我们来说, 理解歌曲的意义也是困难的。 作为这个项目的一部分, 我们探索了产生歌曲含义的过程。 尽管广泛使用文本到文本的模型, 但很少试图实现类似的目标。 主要是在情绪分析背景下研究歌曲。 这涉及到在文本中识别意见和情绪, 将这些意见和情绪评价为正面或负面, 并利用这些评价来提出音乐建议。 在本文中, 我们展示了一个为歌曲几行提供隐含含义的基因化模型。 作为这个项目的一部分, 我们的模型使用一个解码变异器结构 GPT-2, 其中输入的是一首歌的歌词。 此外, 我们比较了这个结构的性能与 T5 模型的编码- 解码变异器结构的性能。 我们还研究了不同类型快速的效应, 并选择附加更多信息, 例如艺术家的姓名和歌曲的标题。 此外, 我们测试了不同的解码方法, 并用不同的培训参数来评估我们的成果 。 为了构建我们的数据集, 我们使用了“ Genrious ” ATI 。