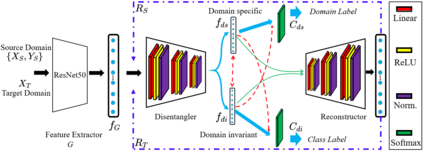

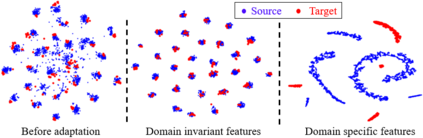

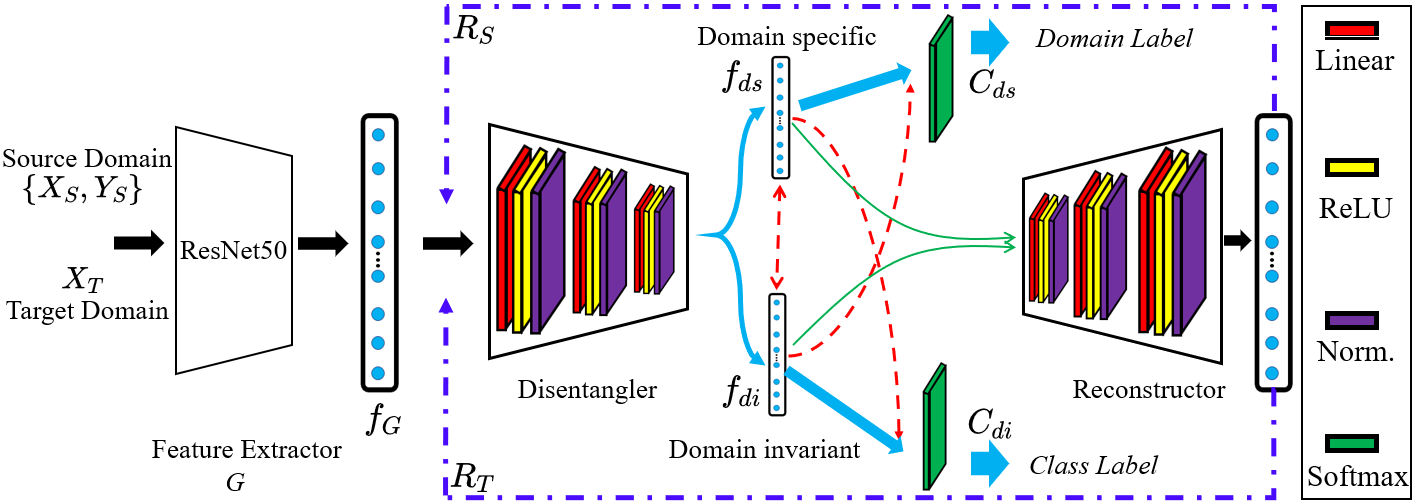

Domain adaptation aims to mitigate the domain gap when transferring knowledge from an existing labeled domain to a new domain. However, existing disentanglement-based methods do not fully consider separation between domain-invariant and domain-specific features, which means the domain-invariant features are not discriminative. The reconstructed features are also not sufficiently used during training. In this paper, we propose a novel enhanced separable disentanglement (ESD) model. We first employ a disentangler to distill domain-invariant and domain-specific features. Then, we apply feature separation enhancement processes to minimize contamination between domain-invariant and domain-specific features. Finally, our model reconstructs complete feature vectors, which are used for further disentanglement during the training phase. Extensive experiments from three benchmark datasets outperform state-of-the-art methods, especially on challenging cross-domain tasks.

翻译:域适应的目的是在将知识从现有标签域转移至新域时缩小领域差距,但是,现有的分解法没有充分考虑到域变量和域特定特性之间的分离,这意味着域变量和域特定特性之间没有区别,这意味着域变量特性没有区别。在培训期间,重新组合的特性也没有得到充分使用。在本文件中,我们提出了一个新的强化的可分离分离模型(ESD),我们首先使用脱钩器来蒸馏域变量和域特定特性。然后,我们采用特征分离强化程序来尽量减少域变量和域特定特性之间的污染。最后,我们的模式重建了完整的特性矢量,用于在培训阶段进一步分解。从三个基准数据集中进行广泛的实验,它们超越了最先进的方法,特别是在挑战性跨域任务方面。