在过去的十年中,深度机器人学习的进步使机器人获得了显著的能力。然而,这些机器人在新任务上的泛化能力仍然较弱,突显了开发通用机器人(generalist robots)的必要性。尽管现有研究主要通过大规模预训练来增强泛化能力——为机器人提供海量数据集和大量参数,并将泛化视为一种自然出现的特性——这种方法并未完全解决现实世界的复杂性。现实世界呈现出无限多样的任务,其中许多超出了这些机器人之前遇到的训练场景。例如,在医疗领域,机器人必须处理由于患者多样化潜在意图导致的部分可观测性,这些意图无法在数据集中完全涵盖。类似地,自动驾驶车辆必须应对不可预测的交通、天气和道路状况,这些情况可能超出了训练数据的范围。

本论文主张,除了可扩展性外,强大的适应能力对于提升在现实世界应用中的泛化能力至关重要。论文探讨了构建能够在部署时有效适应的机器人的策略,重点关注数据效率、参数效率和鲁棒性。研究深入探讨了各种自适应学习方法,包括在有限数量的示范条件下进行的上下文机器人学习、自主的持续强化学习以揭示机器人任务的结构,以及使用大型基础模型构建具身代理。这些方法展示了显著的潜力,使机器人能够在各种应用中获取新的运动技能,并通过创造性地使用工具解决复杂的、长时间跨度的物理难题。

现实中,机器人不可避免地会遇到新的任务。例如,家用机器人必须操作未见过的物体或完成具有新组成部分的长时间烹饪任务(Kipf et al., 2019; Kirk et al., 2023)。而自动驾驶车辆则必须与具有显著不同行为的未知人类驾驶员安全互动(Sadigh et al., 2016; Shalev-Shwartz et al., 2016)。这种现实且高度不确定的场景对机器人学习算法提出了重大挑战,并在大规模部署机器人之前需要强大的泛化能力。鉴于这些现实问题,我的研究愿景是开发能够在类似日常生活的挑战性新环境中泛化的机器人。

我们见证了通过广泛的预训练来增强机器人泛化能力的显著进展。这涉及为机器人配备海量的数据集,包括现实世界和模拟数据集,例如Open-X Embodiment(Padalkar et al., 2023)和DROID数据集(Khazatsky et al., 2024),并开发具有数百万到数十亿参数的模型,如RT-1(Brohan et al., 2022)、RT-2(Brohan et al., 2023)和Octo(Octo Model Team et al., 2023)。这些方法将泛化视为一种随着规模增加而自然显现的特性。然而,它们未能完全解决现实世界环境的复杂性,这些环境呈现出无限多样的任务,许多任务超出了机器人初始训练场景的范围。不断扩大的数据集和模型的趋势表明对可扩展性的依赖日益增加。然而,机器人必须准备好处理与其训练任务显著不同的任务,这些任务由于环境参数的部分观测或人类隐藏的意图以及训练数据的多样性有限等因素而有所不同。

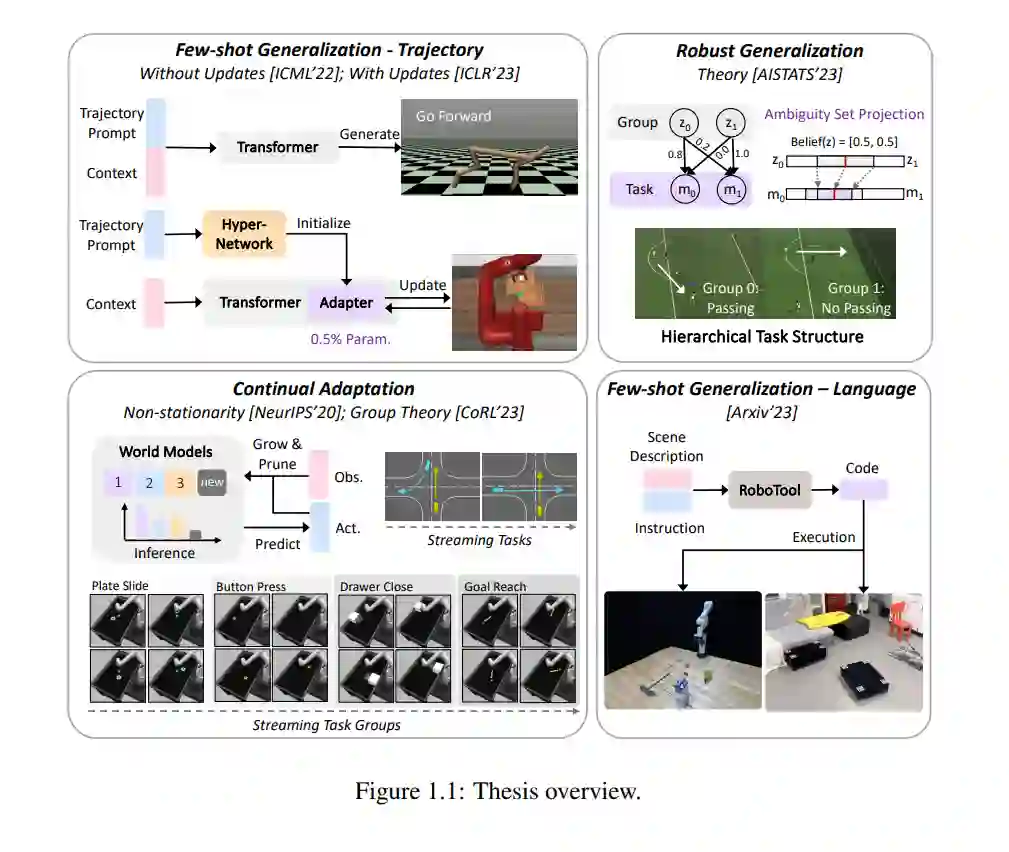

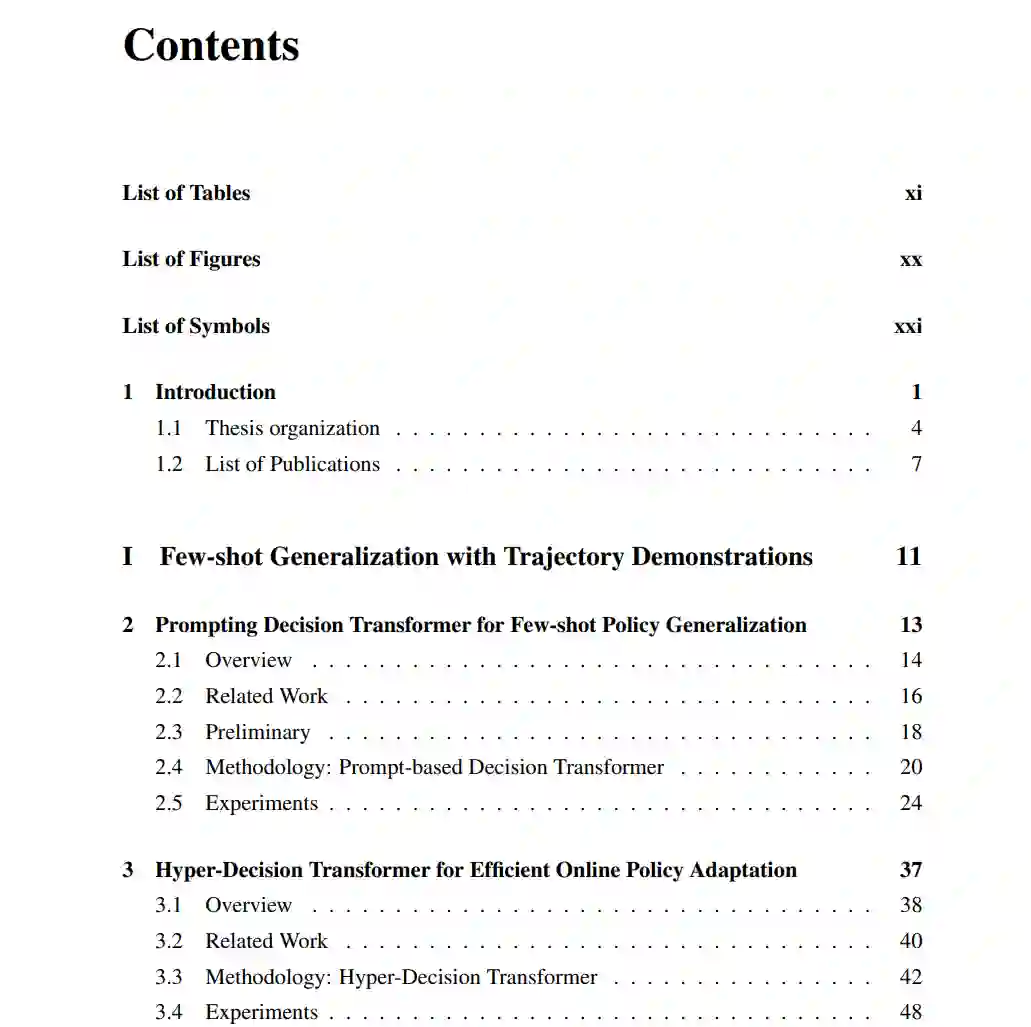

为了弥合训练与现实世界部署之间的差距,本论文认为适应性与可扩展性同样重要,以增强泛化能力。论文探讨了在部署时能够有效适应的通用机器人的构建方法,重点关注数据效率、参数效率和鲁棒性。论文研究了在不同测试时监督下的各种自适应学习策略,包括依赖少量示范的上下文机器人学习、利用奖励信号发现机器人任务结构的无监督持续强化学习,以及将大型基础模型整合用于具身代理。这些方法展示了巨大的潜力,使机器人能够在不同环境中学习新的运动技能,并通过创造性地使用工具解决复杂的长时间任务。论文的组织结构如下所示。 论文的第一部分深入探讨了少样本泛化,特别是从单一示范中学习目标任务。这部分的独特之处在于探索数据稀缺的情境,其中存在足够的训练任务数据,但仅有有限的测试任务示范。这些示范可能来自各种来源,包括人类专家、脚本策略、学习的迁移模型或网络数据。我们提出的解决方案利用了Transformer架构的序列建模能力和丰富的训练任务数据,来建模机器人策略与任务之间的对应关系。 第二部分重点转向持续适应,其中目标任务是在没有先前示范的情况下实时解决。这种情境与持续强化学习(RL)一致,特点是非平稳环境和不断变化的任务。我们的目标是高效学习新的序列决策任务,尽量减少环境交互。为此,我们引入了任务无关的在线学习算法,通过高斯过程表示每个动态模型或通过等变神经网络捕捉几何相似性。 论文的第三部分集中于决策算法的鲁棒泛化和评估。前几部分使用了一种主要评估来自均匀任务分布的目标任务样本平均性能的指标。考虑到现实世界中的机器人应用通常是高风险的,我们在第三部分研究了两个以安全为中心的指标。第一个指标在解决从目标任务分布中抽取的任务时检查最差性能。第二个指标探讨稀有事件概率,特别是在长尾目标任务分布的背景下,提供了一个超越简单平均性能指标的全面而细致的评估框架,用于评估可泛化的机器人学习。 论文的第四部分受到最近大型基础模型成功的强烈启发。我们探索了如何使用大型基础模型通过创造性的工具使用行为解决多种物理难题。我们介绍了RoboTool,一个促进三种不同类型创造性工具使用的系统:工具选择、顺序工具使用和工具制造。该系统适用于两种不同的机器人形式:机械臂和四足机器人。RoboTool利用大型语言模型的上下文学习能力来掌握基本的物理概念,制定基于文本的行动计划,并将这些计划转换为可执行的Python脚本。 论文组织结构:

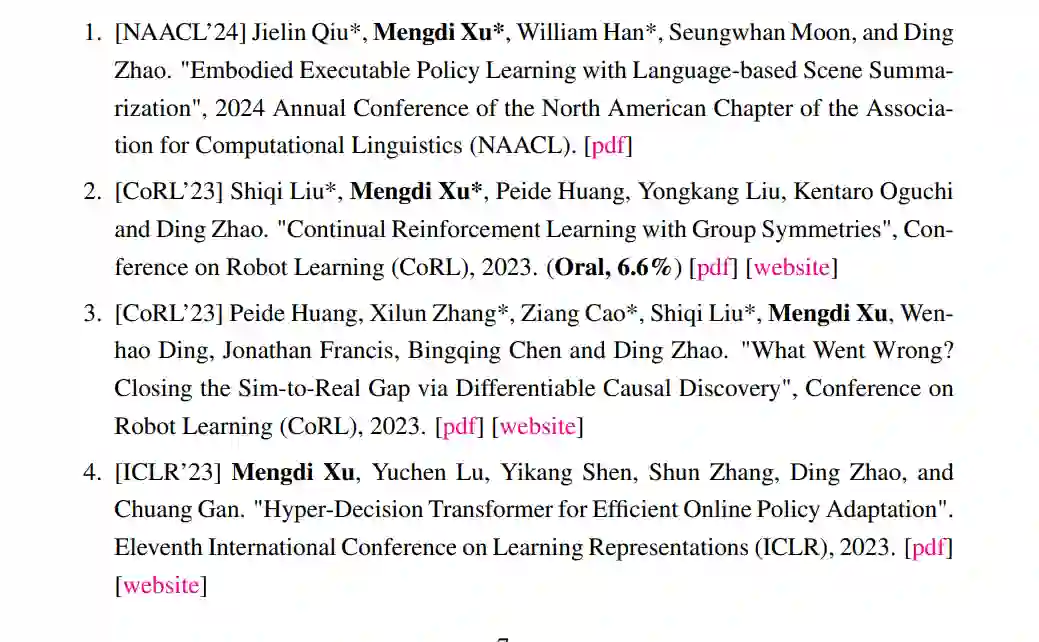

第二章提出了基于提示的决策Transformer(Prompt-DT),用于解决离线少样本强化学习问题。我们通过实验证明,该算法在多个基准领域优于最新的离线元强化学习算法MACAW(Mitchell et al., 2021)。我们还展示了Prompt-DT在使用专家数据集训练时,对提示长度变化具有鲁棒性,但对提示中提供数据的质量敏感。据我们所知,这是序列预测模型在离线少样本强化学习设置中的首次应用,基于决策Transformer(Chen et al., 2021b)开发。我们的算法实现简单,仅涉及训练一个基于提示的Transformer,而不是像MACAW那样使用actor-critic算法分别训练策略和价值网络(Mitchell et al., 2021)。我们希望这项工作能激发对序列预测模型在强化学习中应用的更多研究。在未来的工作中,我们考虑设计平衡轨迹提示和历史上下文权重的目标函数,因为目前提示长度被视为超参数,并将基于提示的Transformer用于其他强化学习任务,如元模仿学习(Duan et al., 2017;Finn et al., 2017b)。我们还注意到,当使用从专家轨迹中抽取的提示时,Prompt-DT和Prompt-MT-BC在Meta-World的ML10基准中未能泛化。这激励我们在未来设计更好的提示和基于提示的算法来解决复杂的组合任务。

第三章提出了超决策Transformer(HDT),一种能够以高数据和参数效率泛化到新颖任务的Transformer代理。在微调过程中,HDT对每个Transformer块引入适配层进行微调,这仅占预训练Transformer代理0.5%的参数。我们展示了在包含精细操作任务的Meta-World基准中,HDT比使用专家动作微调整个Transformer代理收敛更快。此外,HDT通过使用超网络预训练适配层参数显示出强大的数据效率。当专家动作不可用时,HDT在成功率方面远超基准。我们将其强大表现归因于适配层的良好初始化,这帮助HDT迅速实现成功的在线展开。我们希望这项工作能激励未来关于如何优化微调大型Transformer模型以解决下游新任务的研究。一个有趣的未来方向是扩展HDT以处理具有高维自我中心图像输入的具身AI任务。

第四章提出了一种可扩展的在线基于模型的强化学习方法,通过无限混合高斯过程(GP)处理有限先验知识的真实世界任务无关情境。我们的方法通过使用数据高效的GP作为动态模型实现快速适应,避免了通过保留专家混合体来避免灾难性遗忘。当动态显著不同且任务识别可以阻止有害知识转移时,我们的方法表现良好。我们提出了一个转移先验,以显式建模时间依赖性,从而释放任务独立同分布的假设。此外,我们的方法在每个时间步检测动态变化,因此适用于任务划分未知的情况。我们通过在线顺序变分推断学习混合模型,该方法可以扩展到具有数据蒸馏和合并和修剪技术的大规模流数据。由于GP的后验计算随着数据量和数据维度的增加变得不可行,将GP替换为神经过程(Garnelo et al., 2018;Kim et al., 2019)将是一个有趣的探索方向。另一个方向是将元学习整合到我们的方法中,以更好地利用不同动态之间的共性信息。

第五章提出了COVERS,一种新颖的基于视觉的持续强化学习(CRL)框架,利用群对称性促进泛化到同一群操作下未见但等效的任务。COVERS基于不变特征无监督检测群边界,并为每组等效任务而不是单个任务增长策略。我们展示了COVERS能够高精度地分配任务到不同群,具有强大的泛化能力,并保持解决已见群的能力,表现远超基准。COVERS的一个限制是其占用的内存随任务群数量线性增长。然而,值得注意的是,COVERS仍比为每个任务维护策略缓冲区占用更少的内存,只存储代表性数据帧,如每个任务群的初始帧。另一个限制是虽然现有工作广泛采用固定基座的自上而下摄像头,但在实验室外很难实现。结合更一般的群操作,如仿射变换和域随机化技术,以处理变形图像将是有趣的。此外,我们仅实验了具有等变结构的群。COVERS在既具有等变任务又具有非等变任务的更复杂场景中的表现尚不清楚。

第六章我们考虑了任务估计不确定性下的鲁棒性。我们提出了GDR-MDP框架,能够利用丰富的分布信息,包括关于任务群的自适应信念和先验知识。据我们所知,GDR-MDP是第一个在自适应环境下建模信念估计不确定性的分布鲁棒MDP框架。我们理论上展示了GDR-MDP的分层潜在结构如何相比于平坦任务结构增强其分布鲁棒性。我们还通过实验证明,我们提出的群分布鲁棒训练方法在面对现实场景中的信念推断错误时生成的策略比基准更鲁棒。我们希望这项工作能激发未来关于不同领域知识如何影响鲁棒性和泛化的研究。一个令人兴奋的未来方向是将群分布鲁棒训练扩展到高维和连续潜在任务分布,以应用于各种决策应用。

第七章我们提出了加速策略评估(APE),受现有策略评估方法面对稀有事件的限制启发。APE通过从强大的函数逼近器中汲取灵感扩展到复杂任务,并通过学习一个对手与自适应重要性抽样探索由序列交互引起的稀有事件。我们展示了APE的有效性,其样本节省量级可实现收敛。APE为在安全关键系统中评估和随后的智能代理部署提供了一个基本工具,这在其他情况下计算上是不可行的。我们希望这项工作能作为在存在稀有事件情况下进行策略评估的替代方案,并激发新的自适应重要性抽样对抗训练。它还通过揭示极端情况下(稀有事件)代理行为提高了策略解释性。值得注意的是,APE专注于估计终止前的期望成本,并依赖实验者在实践中设计公平合理的成本函数。APE在序列环境中评估稀有事件的可扩展性开启了两个重要的未来方向。首先是训练稀有事件感知的智能代理。这需要一个极小极大训练机制,以优化代理避免稀有事件的策略,后者通过本文中的自适应重要性抽样学习的环境对手捕捉。其次是更强大的值函数和重要性分布更新方法,如在GP回归模型中结合(贝叶斯)不确定性估计和使用多步TD。

第八章我们介绍了RoboTool,一个由大型语言模型(LLM)驱动的创造性机器人工具用户,使其能够解决具有隐含物理约束的长时间规划问题。RoboTool包含四个组件:(i)“分析器”,识别与任务可行性相关的关键概念,(ii)“计划者”,生成创造性工具使用计划,(iii)“计算器”,计算技能参数,以及(iv)“编码器”,生成可执行代码。我们提出了一个基准来评估三种创造性工具使用行为,包括工具选择、顺序工具使用和工具制造。通过在创造性工具使用基准上的评估,我们展示了RoboTool能够识别正确的工具,生成精确的工具使用计划,并创造新工具完成任务。我们将我们的方法与四种基准方法进行了比较,展示了当所需任务需要精确和创造性工具使用时,RoboTool表现优越。