Transformers 正在成为许多神经网络架构的核心部分,被广泛应用于诸如NLP、语音识别、时间序列和计算机视觉等领域。Transformers 经历了许多改编和改造,从而产生了新的技术和方法。《Transformers 机器学习:深度探究》是第一本全面介绍Transformers的书。 https://www.routledge.com/Transformers-for-Machine-Learning-A-Deep-Dive/Kamath-Graham-Emara/p/book/9780367767341#

主要特点:

- 一本全面的参考书,详细解释了与Transformers有关的每个算法和技术。

- 全面覆盖60多个Transformers架构。

- 一本理解如何在语音,文本,时间序列,和计算机视觉应用Transformers技术的书。

- 每个架构的实用技巧和技巧,以及如何在现实世界中使用它。

- 使用这些工具和库进行理论和实际现实分析的实践案例研究和代码片段,都可以在谷歌Colab中运行。

最先进的Transformers 架构的理论解释将吸引研究生和研究人员(学术界和工业界),因为它将为快速发展的领域的深入讨论提供一个单一的入口点。实践动手案例研究和代码将吸引本科生、从业者和专业人士,因为它允许快速实验并降低进入该领域的门槛。

第一章将从时间线、历史及其对学术界和工业界的影响向读者介绍Transformers。然后,我们将在分类的基础上,从理论、实践和应用的角度出发,完成本章的布局。这一章,然后进行全面的讨论,在实践方面,如资源,工具,书籍,和课程,将在其他章节。

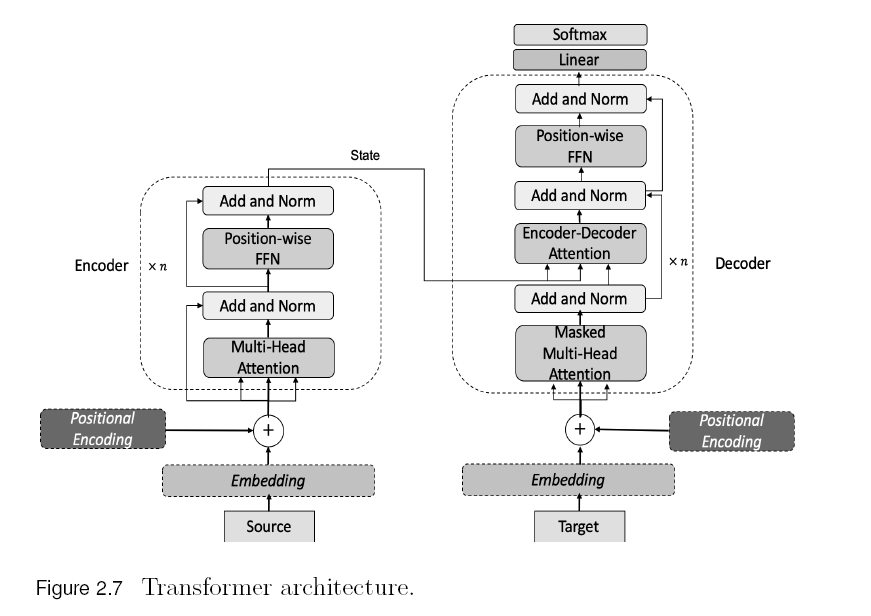

第二章开始介绍序列到序列模型及其局限性。这一章然后一步一步地介绍了Transformers的各种构造块,如注意力、多头部注意力、位置编码、残差连接和编码器-解码器框架。所有这些功能单元都从理论和实践的角度进行了详细的论述,以便读者更全面地理解本课题。最后,通过一个真实世界的案例研究,展示了本章的操作方面。

BERT的出现彻底改变了自然语言处理(NLP)领域,并帮助在许多传统上具有挑战性的任务中达到接近人类水平的性能。第三章介绍了BERT架构的细节,以及如何对经典的nlp任务进行预训练和微调,如单对文本分类、双kentagging和问答。本章还讨论了BERTology的相关领域,研究了BERTology的内部工作原理以及如何处理和分析扩展信息。最后,这一章介绍了一些改进的架构以提高效率(例如,RoBERTa)和NLP应用的类型(例如,NLP用于tabulardata-TaBERT)。本章总结了使用BERT进行情感分类和话题建模应用的真实案例研究。