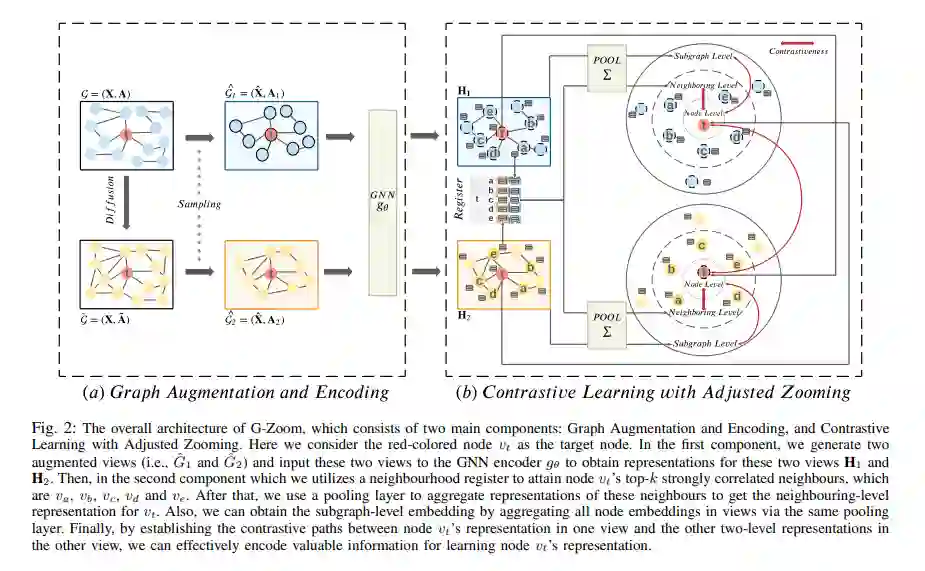

图表示学习(GRL)是图结构数据分析的关键。然而,现有的大多数图神经网络(gnn)严重依赖于标签信息,而在现实世界中,获取标签信息的成本通常很高。现有的无监督GRL方法存在一定的局限性,如过分依赖单调的对比性和有限的可扩展性。为了克服上述问题,根据图对比学习的最新进展,我们引入了一种新的自监督图表示学习算法,即G-Zoom,利用所提出的调整缩放方案来学习节点表示。具体来说,该机制使G-Zoom能够从多个尺度: 微观(即节点级)、中观(即邻域级)和宏观(即子图级)的图中探索和提取自监督信号。首先,我们通过两种不同的图扩充来生成输入图形的两个扩充视图。然后,我们在上述三个尺度上逐步建立三个不同的对比,从节点、相邻到子图级别,在那里我们最大化了跨尺度的图表示之间的一致性。虽然我们可以从微观和宏观角度的给定图表中提取有价值的线索,社区层面的对比为G-Zoom提供了一个可定制的选项,基于我们的调整缩放方案,手动选择一个介于微观和宏观视角之间的最佳视角,以更好地理解图数据。此外,为了使我们的模型可扩展到大的图,我们采用了一种并行的图扩散方法来解耦模型训练和图的大小。我们在真实的数据集上进行了广泛的实验,结果表明,我们提出的模型始终优于最先进的方法。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年4月18日