机器人顶级会议精华提炼(20190617-20190622)

每天一分钟,带你读遍机器人顶级会议文章

来源:ICRA 2018

播音员:水蘸墨,赵嘉珩

汇总:张宁

编译:泡泡一分钟全体组员

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

2019年6月17日至2019年6月22日,泡泡一分钟共推送了11篇文章,其内容涉及到姿态估计(4篇)、语义分割(2篇)、数据集(1篇)、视觉里程计(1篇)和自动驾驶(1篇)、路径规划(1篇)、模仿学习(1篇)等。

姿态估计

姿态估计是本周的重点,总共推送4篇文章。

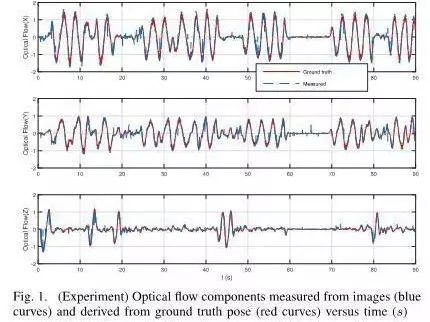

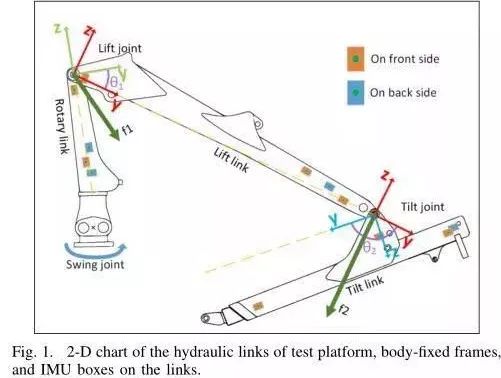

第一篇文章讨论了IMU-相机对平面目标姿态、线速度和深度的估计问题。考虑的解决方案依赖于光流追踪(从连续同形图中提取),并辅以陀螺和加速度计测量。提出了一种确定性观测器,并对该观测器进行了可观测性分析,指出了摄像机的运动激励条件,其满足度使观测器的稳定性和估计误差的收敛性为零。通过对IMU-相机系统进行实验测试,说明了观测器的性能。

利用连续同形和惯性数据观测平面目标的相机姿态、线速度和深度估计

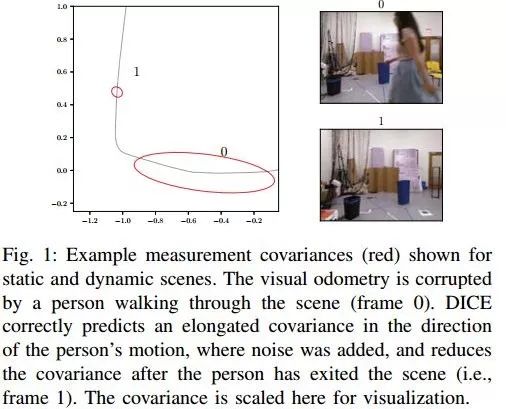

在第二篇文章中,作者提出了一种新的测量值协方差估计方法,该方法将测量值的不确定程度建模为测量值本身的函数。在本研究中,我们提出了协方差估计值的深度推理方法(DICE),它利用深度神经网络来预测传感器测量值与原始传感器数据的协方差。

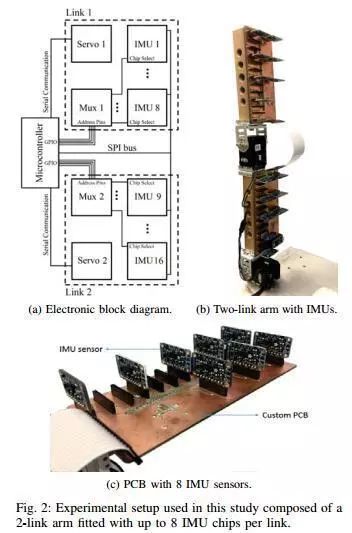

第三篇文章提出了一种基于低成本惯性测量单元(IMU)的浮基机器人平台连杆角估计算法。该算法通过由六自由度轮式工作台和三自由度液压拟人臂组成的商用移动工作机进行了验证。

基于低成本IMU的浮式机器人臂角度估计

第四篇文章提出了对于机器人手臂姿态估计过程中加速度计的优化配置方法。本研究分析了如传感器的数量,传感器在机器人上的位置,以及机器人姿态估计质量的噪声特性及其信噪比(SNR)等设计参数的影响。

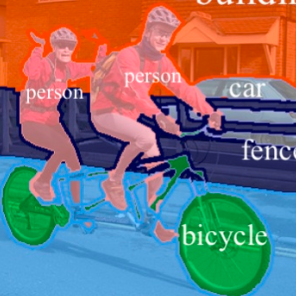

语义分割

语义分割方面本周共推送2篇文章。

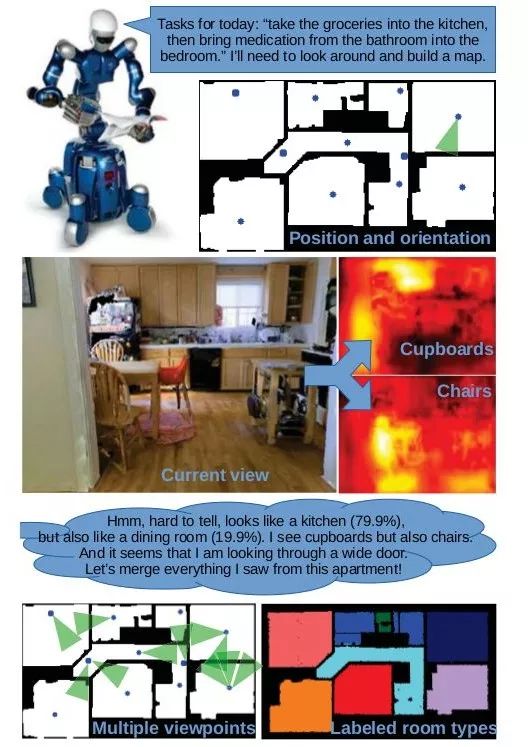

在第一篇文章中,作者提出了一种自动为从公寓的3D RGB地图重建的房间分配语义标签的方法。

第二篇文章提出了一种关于图像运动分割的新方法,用于在城市环境中进行车辆导航。我们利用两个特定的因素(受限的相机运动和已知类型的运动目标)来处理两个影响大多数以前“通用”运动分割算法的主要因素(缺少数据和强大的透视效果)。

数据集

数据集方面本周推送了1篇文章。

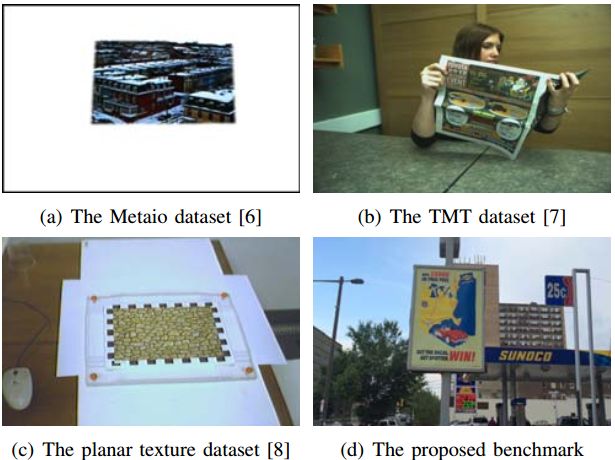

本文介绍了一种精心设计的平面目标跟踪基准,该基准包含30个在自然环境中采样的平面目标210个视频。特别是,对于每个对象,我们拍摄七个涉及各种困难因素的视频,即比例变化、旋转、透视失真、运动模糊、遮挡、不可见和不受约束。真实值经过半人工仔细标注,确保质量。

自动驾驶

关于自动驾驶,本周推送了1篇文章。

自动驾驶方面,作者展示了一种实时车辆检测及追踪的系统来实现诸如城市环境中驾驶行为分析的复杂任务。作者提出了一种结合了单目相机和2D Lidar的鲁棒的融合系统。该系统充分利用了以下3个关键的部分:使用深度学习技术的鲁棒的车辆检测,从Lidar获得的高精度距离数据,以及预先知道的道路环境。相机与Lidar传感器的融合,数据关联以及跟踪管理全部都在考虑了传感器的特征之后在全局地图坐标系上执行。

视觉里程计

视觉里程计方面本周推送了1篇文章。

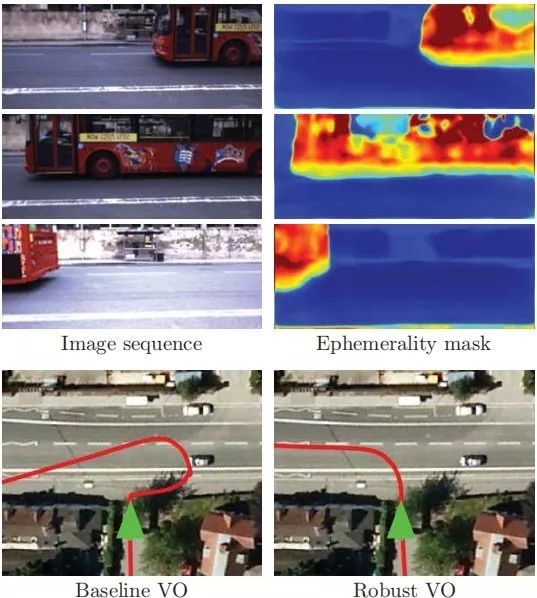

本文介绍了一种自监督学习遮挡的方法来提高城市环境中单目视觉里程计的鲁棒性。我们提出了一种可以忽略相机图像中“干扰物”的自监督方式,用来在杂乱的城市环境中更鲁棒地估计汽车的运动。我们利用离线的多场景建图的方法为每个输入的图片自动形成每个像素短暂的遮挡和深度地图,我们用它来训练深度卷积网络。在运行时,我们使用预测的短暂性和深度作为单目视觉里程计(VO)生成的输入,使用稀疏特征或者稠密的光度匹配。我们的方法仅使用一台相机即可产生公尺制的VO,即使动态、独立移动的物体遮挡了90%的图像信息,也可以恢复出正确的运动。

一种自监督学习遮挡的方法来提高城市环境中单目视觉里程计的鲁棒性

路径规划

路径规划方面本周推送了1篇文章。

在本文中,考虑了由运输任务中涉及的多个地面和空中机器人组成的系统的建模和规划问题。地面机器人严格地抓住负载,而飞行器通过非刚性不可伸展的电缆连接到物体上。这种异构多机器人系统背后的想法是受益于两种类型的机器人的优点,这些机器人可能是地面机器人的精确度和多个飞行器的高负荷。

模仿学习

模仿学习方面本周推送了1篇文章。

本周介绍了一种新的在最小的人类监督的例子中训练使用基于学习的视觉感知和逆最优控制。当在灾难恢复等动态环境中与人类合作者一起工作时,无人地面车辆(UGV)可能需要快速地适应现场以履行其职责或学习新任务。在灾难恢复情况下,人员和设备受到限制,因此必须在最少的人类监督下完成训练。

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号(paopaorobot_slam)。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/bbs/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com