变态「三角恋」?世界知识、大脑和计算是AGI的新「三驾马车」

新智元报道

新智元报道

来源:nextweb

编辑:白峰

【新智元导读】「冰镇椅子」和「彩虹蕉」见过没?反正神经网络要泪奔了。近年来,吃数据的人工智能狭隘性日益凸显,而来自旧金山的科学家们,认为智能来源于归纳偏差,他们试图通过已知的世界属性、大脑的物理结构和算法来构建一种新的世界模型。

智能来自「偏见」?人脑中有一个归纳偏见的世界模型

规则和大数据行不通,AGI需要AI和神经科学的「碰撞」

轻松识别「变态」码,「生成模型」是类脑智能的关键

研究人员写道: 「从进化历史中来看,通用智能是通过大脑皮层实现的,而不是通过专用电路的集成。」

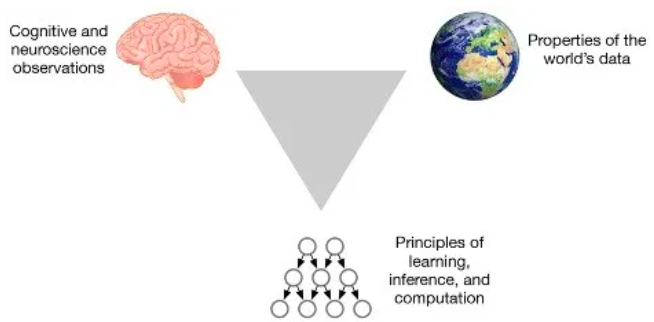

作者提出了一个三角模型,通过已知的世界属性、大脑的物理结构和算法来理解智能行为。从这三个角度出发,可以构建出一个具有一般问题解决能力的人工智能算法。

三角模型

「当我们观察大脑的一个属性时,我们能将这个属性与世界的组织原则匹配吗?这种特性能否用计算框架来表示,能否通用,能否具备学习/推理能力?」

对比这个模型来看,纯粹的机器学习模型处理的仅是算法和数据,而没有考虑大脑中学到的见解。

大脑的一个关键属性是「生成模型」 ,它允许我们在大脑内部形象化事物,并在抽象和概念层面上推理世界。

这个生成模型可以帮助我们填补视觉场景和自然语言推理的空白。

例如,当你听到「小明在地板上敲钉子」这个句子时,你会自动想象这个过程,而且不需要明确地告诉你小明是垂直地拿着钉子。

生成模型的目标不是重现真实场景,相反,它应该能够按照其组成部分和它们之间的关系组成场景。

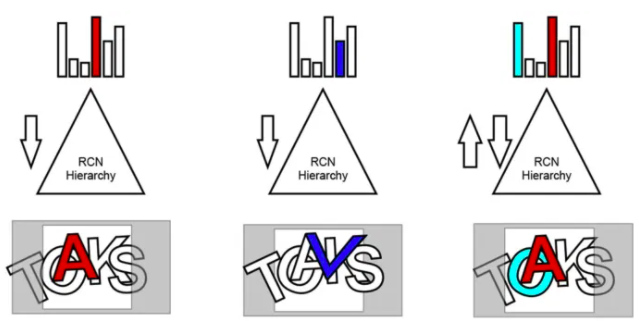

具有这些属性的人工智能算法可以执行诸如分类(场景包含哪个对象)、分割(哪个像素属于哪个对象)、遮挡推理(检测部分遮挡的对象)等任务。

目前的深度学习系统可以被训练来执行一个任务,但无法通用。

你说的挺好,这些道理我都懂,如何才能实现呢?

基于「轮廓-表面因子分解」的递归皮层网络(RCN)

基于「轮廓-表面因子分解」的递归皮层网络(RCN)

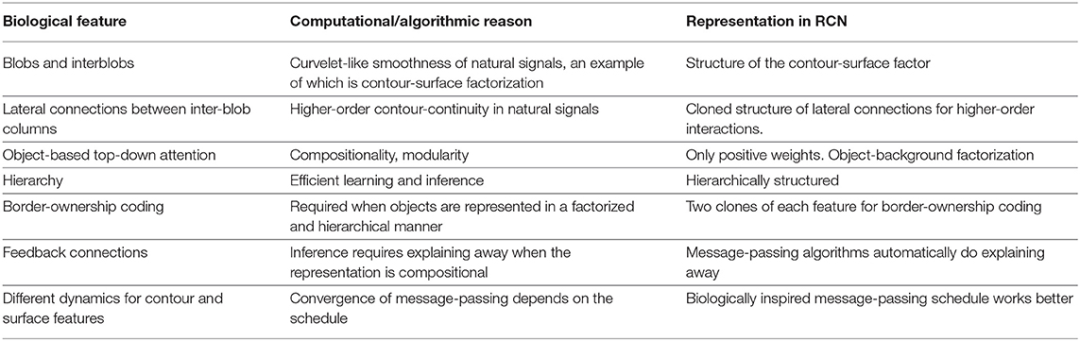

该论文的两位作者迪里普 · 乔治和米格尔 · 拉扎罗根据上述理论开发了递归皮层网络(RCN)。RCN 借鉴了神经科学的知识,以统一的方式处理识别、分割和推理任务。

根据作者的测试,RCN 能够利用较小的训练数据集解决基于文本的验证码,并且比深度学习模型具有更大的灵活性。

实验表明,人类视觉系统优先考虑形状和轮廓而不是纹理。因为即使它们的颜色和纹理在不同的光照条件下发生变化,形状还是回保持原样。

人类大脑对形状和轮廓有「偏见」,也是为什么你不需要用带标签的例子来识别下面这些奇怪的物体。

研究人员观察到: 「轮廓-表面因子分解」可能是大脑皮层处理自然信号的一般原理,而这种偏好可能来源于进化。

深度神经网络虽然也归纳各种偏差,例如,卷积神经网络可以被训练,然后以非常高的精度检测二维码--这是大多数人无法做到的。但是,QR检测模型,检测其他物体时,就会无从下手。

「QR 码不是人类视觉系统天生偏好的那种自然信号」,研究人员补充说, CNN识别 QR 码这种情况表明它们跟人类大脑的偏好不一致,并且不如人类的好。

研究人员讨论的另一个有趣的特性是层次组合。

人类的视觉系统倾向于把这个世界看作是嵌套对象的组合,这也是世界的一个关键属性。

例如,树木是由树枝、树叶和树根组成的,而不管每个部分的形状如何。我们甚至可以在我们第一次看到的树上,辨别出这些部分。

深度学习的先驱 Geoffrey Hinton,也在探索层次结构作为一种手段来概括计算机视觉能力。

作者写道,「通过探索世界的层次结构,视觉皮层可以逐渐建立对象的不变表征,分层组织也适用于高效的学习和推理算法」。

同样值得注意的是我们的视觉系统对环境和细节水平的敏感度。

我们通过考虑局部和全局的反馈机制来处理世界的可变性。例如,下面几个图,没有其他补充信息的话,想要分辨出来可太难了。

但是,放在另一种环境中就很好理解了,相同的像素点与周围的其他细节一对比,我们就能理解图片代表啥。

深度学习的局限可能就来自于此,只能观测到局部的信息,如果能像人一样,将这些局部特征放在一个更大的整体中结合知识去看,局部的模糊性就会瞬间消失。

上下文可以解决很多问题,比如验证码的遮挡。

虽然长期目标是 AGI,但根据这些原则创建的 RCN 已经在各个领域中开始使用。RCN最大的优势就在于只需要少量的数据。

结果表明,RCN 可以高效识别各种各样的验证码,且只要很少的训练数据,而且不需要使用特定的启发式算法。

相比之下,卷积神经网络需要50,000倍的训练集,鲁棒性还很差。

作为一个生成模型,RCN 在测试嘈杂例子时优于神经网络模型,并且可以通过一次性手写字符训练生成逼真的样本。

而构建AGI的另一个关键部分,就是找到一个新的「图灵测试」。

Keras之父Francois Chollet设计了一个抽象推理语料库(ARC) ,ARC 的目的是测试AI系统能否用极少的例子在抽象层面上解决问题。

迪里普 · 乔治和他的同事认为,RCN灵活高效地解决验证码是一个很好的迹象,表明人工智能算法的确可以解决多任务,并使我们更接近 AGI 。

他们正将RCN扩展到更多领域,后面会把RCN和与概念学习、语音结合起来,实现更通用的智能。

你还听过哪些有趣的AGI呢?评论区留言分享一波。

参考链接:

https://www.frontiersin.org/articles/10.3389/fncom.2020.554097/full