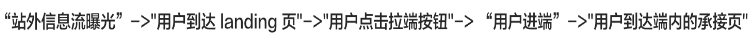

如何快速上手 AB Testing ?阿里技术专家秘方公开

什么是 A/B Testing?

-

对于一个初创项目,产品刚刚孵化,这种时候不太适合做 A/B 测试,因为这个时候我们的目标相对是比较明确的,就是快速形成“原型”产品和大框架,把“产品生下来”,因此也基本上不会有太多抠细节的部分。 -

而当产品到了一定的阶段,模式已经成型比较稳定,相对处于快速迭代的阶段,就比较适合利用 A/B Testing 来助力业务发展了。

-

原假设,又叫零假设、无假设(Null Hypothesis),代表我们希望通过试验结果推翻的假设。 -

备择假设(Alternative Hypothesis),代表我们希望通过试验结果验证的假设。

-

我们要写明,实验目标是什么,包括上面说的假设。 -

在实验分组上,我们要考虑如何划分分组,是否要有 A/A 对照,要切多少流量来做实验? -

另外在投放上,我们的实验要针对谁做? 是否要投放在特定的地区? 或是投放在特定的端?

-

指标的样本量(反过来样本量也决定了实验的运行时长)。 -

实验的显著性水平(α)、统计功效(1-β),一般业界普遍设定 α 为 5%,β 为 10%~20%。

第 I 类错误(弃真错误):原假设为真时拒绝原假设;第 I 类错误的概率记为 α(alpha),对应就是显著性水平值。

第 II 类错误(取伪错误):原假设为假时未拒绝原假设。第 II 类错误的概率记为 β(Beta),取反后(1-β)对应就是统计功效值。

第一类的错误是指,加大按钮的尺寸,按钮点击率实际没有什么变化,但因为误差,我们认为有变化。

第二类的错误是指,加大按钮的尺寸,按钮点击率实际产生了变化,但因为误差,我们认为没有变化。

-

实验显著性是否满足要求? -

实验的结论是否证实了假设对数据的提升? -

实验是否带来了漏斗中其他数据变差?

解决A/B 成本高的问题(这里我们从几个角度来解决):

1.平台的操作效率(是否简单易用),平台工具是否通俗易懂(A/B 那么多统计学的概念的理解成本能否被我们平台侧抹平)。

2.开发更加规范,我们需要从开发 sdk 上规范业务的定制 A/B 开发,提供开发。

3.开发效率提升:

从工程侧,我们可以利用代码脚手架、代码生成等方式来提升效率。

从平台功能上来说,我们可以提供 UI Editor 等之类的工具,把一些“静态配置”类的部分开放给运营和产品,允许他们做改动来做 A/B 实验,减少开发人员自己的投入。

4.A/B 的能力需要融入到其他的流程、平台、系统里面。

想要快速构建更稳定、安全的应用,提升运维效率,降低IT成本吗?识别下方二维码或点击“阅读原文”立刻学习。

当达摩院大牛学会抠图,这一切都不受控制了……

当达摩院大牛学会抠图,这一切都不受控制了……

为什么 APP 纷纷开发“暗黑模式”?优酷实践总结

登录查看更多

相关内容

统计学(Statistics)是研究收集、分析、解读、展示及组织(collection, analysis, interpretation, presentation and organization)数据的学科,通过量化地研究随机性,从而理解数据的产生机制,并进行判别、预测、优化、决策。统计学理论和方法是很多现代科学分支的支柱,其广泛的应用深刻地影响现代生活,具有代表性的应用领域包括:

生物/医学(生物统计学,基因统计学,生物信息学,制药学等)

社会学/环境学(社会统计学,心理学,人口学,空间统计学,环境统计学等)

工业工程学(质量控制,可靠性分析等)

经济学/金融学(精算学,金融统计学等)

工程学/计算机科学(统计学习,数据挖掘,信号/图像采样/处理等)

基础科学(统计物理学,统计化学等)

社会学/环境学(社会统计学,心理学,人口学,空间统计学,环境统计学等)

工业工程学(质量控制,可靠性分析等)

经济学/金融学(精算学,金融统计学等)

工程学/计算机科学(统计学习,数据挖掘,信号/图像采样/处理等)

基础科学(统计物理学,统计化学等)

Arxiv

3+阅读 · 2018年1月18日