【上海交大】可解释CNN的对象分类,Interpretable CNNs for Object Classification

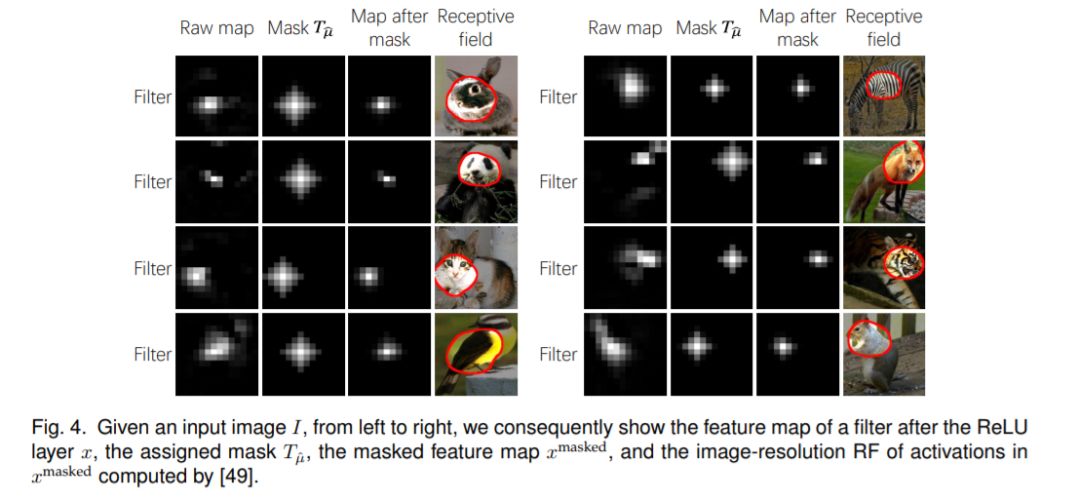

本文提出了一种学习深度卷积神经网络(CNN)中可解释卷积滤波器的通用方法,用于对象分类,每个可解释滤波器都对一个特定对象部分的特征进行编码。我们的方法不需要额外的注释对象部分或纹理的监督。相反,我们使用与传统CNNs相同的训练数据。在学习过程中,我们的方法在一个高卷积层中自动分配每个可解释的过滤器,每个过滤器的对象都是某个类别的一部分。在CNN的卷积层中,这种显式的知识表示有助于人们理清CNN中所编码的逻辑,即,回答CNN从输入图像中提取什么模式并用于预测。我们使用不同结构的基准CNNs测试了我们的方法,以证明我们的方法具有广泛的适用性。实验表明,我们的可解释过滤器比传统过滤器在语义上更有意义。

https://www.zhuanzhi.ai/paper/c4e2374bfab81795f03d20bb05fab53f

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“ICNN” 就可以获取《【上海交大】可解释CNN的对象分类,Interpretable CNNs for Object Classification》论文专知下载链接

登录查看更多

相关内容

专知会员服务

32+阅读 · 2020年6月11日

专知会员服务

49+阅读 · 2020年1月1日

专知会员服务

102+阅读 · 2019年11月24日