简介:

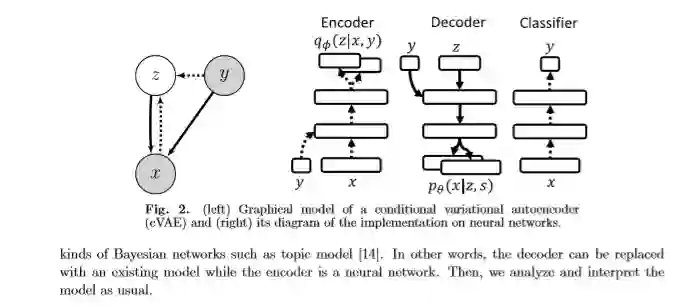

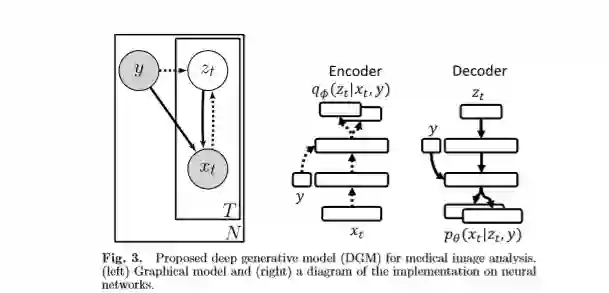

深度学习被认为是一种无模型,端到端和黑盒子的方法。它需要大量数据样本,而不是目标领域的专家知识。因此,它没有指定决策的机制和原因。这方面被认为是深度学习的关键限制。本文介绍了另一种观点,即贝叶斯深度学习。深度学习可以应用在任何框架中,例如贝叶斯网络和强化学习。随后,专家可以将知识实现为图结构,加快学习速度,并获得目标域上的新知识。该框架被称为深度生成模型。相反,我们可以将贝叶斯建模方法直接引入深度学习。随后,有可能通过不确定性量化输出来探究关于其决策确定性的深度学习,并检测错误的决策或异常输入。使用上述方法,可以调整深度学习的“brightness”。

成为VIP会员查看完整内容

相关内容

专知会员服务

117+阅读 · 2019年12月22日