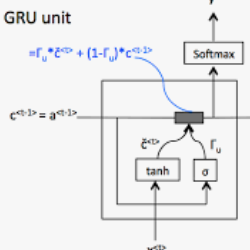

Human activity recognition (HAR) in ubiquitous computing has been beginning to incorporate attention into the context of deep neural networks (DNNs), in which the rich sensing data from multimodal sensors such as accelerometer and gyroscope is used to infer human activities. Recently, two attention methods are proposed via combining with Gated Recurrent Units (GRU) and Long Short-Term Memory (LSTM) network, which can capture the dependencies of sensing signals in both spatial and temporal domains simultaneously. However, recurrent networks often have a weak feature representing power compared with convolutional neural networks (CNNs). On the other hand, two attention, i.e., hard attention and soft attention, are applied in temporal domains via combining with CNN, which pay more attention to the target activity from a long sequence. However, they can only tell where to focus and miss channel information, which plays an important role in deciding what to focus. As a result, they fail to address the spatial-temporal dependencies of multimodal sensing signals, compared with attention-based GRU or LSTM. In the paper, we propose a novel dual attention method called DanHAR, which introduces the framework of blending channel attention and temporal attention on a CNN, demonstrating superiority in improving the comprehensibility for multimodal HAR. Extensive experiments on four public HAR datasets and weakly labeled dataset show that DanHAR achieves state-of-the-art performance with negligible overhead of parameters. Furthermore, visualizing analysis is provided to show that our attention can amplifies more important sensor modalities and timesteps during classification, which agrees well with human common intuition.

翻译:在无处不在的计算中,人类活动识别(HAR)已开始将注意力纳入深层神经网络(DNNS)的背景中,在这种网络中,使用来自加速计和陀螺仪等多式联运传感器的丰富感知数据推断人类活动。最近,通过与Gated 经常单位(GRU)和长短期内存(LSTM)网络(LSTM)相结合,提出了两种关注方法,可以同时捕捉空间和时空范围内感知信号的依赖性。然而,与革命神经网络(CNNs)相比,经常网络的频率比起来往往有一个薄弱的特征,代表着更强大的能量。 另一方面,通过与CNNC(CN)相结合,对时间域应用了两种关注,即硬性关注和软性关注,通过对目标活动进行长期关注。然而,它们只能指出重点和错漏频道信息的位置,从而在决定重点领域,因此,它们无法解决多式机能感测信号的空间依赖性依赖性,与关注的GRRU或LSTM相比。 在纸上,我们用新的直观度分析中, 展示了一种新的双向性直观性直观性流数据, 展示了一种双向轨道上的注意方式, 展示了一种双向导数据,这需要显示了一种双向导的轨道的轨道上的注意,从而显示了一种双向导向导测测。