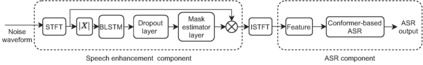

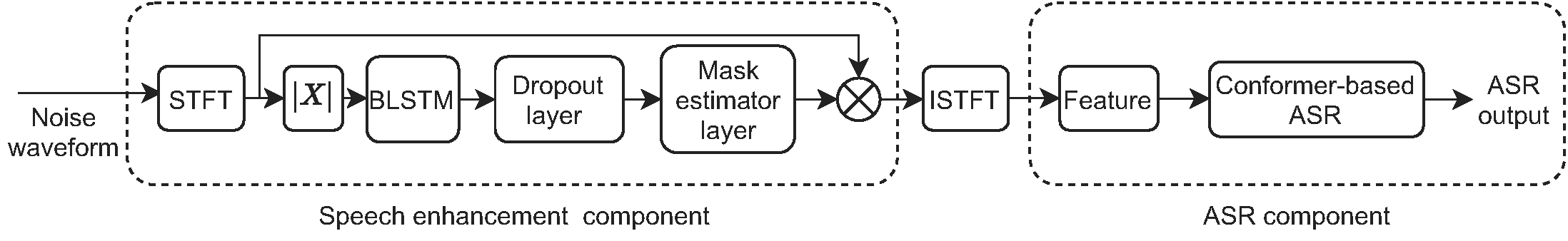

To realize robust end-to-end Automatic Speech Recognition(E2E ASR) under radio communication condition, we propose a multitask-based method to joint train a Speech Enhancement (SE) module as the front-end and an E2E ASR model as the back-end in this paper. One of the advantage of the proposed method is that the entire system can be trained from scratch. Different from prior works, either component here doesn't need to perform pre-training and fine-tuning processes separately. Through analysis, we found that the success of the proposed method lies in the following aspects. Firstly, multitask learning is essential, that is the SE network is not only learning to produce more Intelligent speech, it is also aimed to generate speech that is beneficial to recognition. Secondly, we also found speech phase preserved from noisy speech is critical for improving ASR performance. Thirdly, we propose a dual channel data augmentation training method to obtain further improvement.Specifically, we combine the clean and enhanced speech to train the whole system. We evaluate the proposed method on the RATS English data set, achieving a relative WER reduction of 4.6% with the joint training method, and up to a relative WER reduction of 11.2% with the proposed data augmentation method.

翻译:为了在无线电通信条件下实现稳健的端到端自动语音识别(E2E ASR),我们提议采用基于多任务的方法,将语音增强模块作为前端和E2E ASR模型作为本文件的后端,作为前端和E2E ASR模型作为本文件的后端。拟议方法的一个优点是,整个系统可以从零开始接受培训。与以前的工作不同,这里的两个组成部分都不需要分别进行训练前和微调程序。通过分析,我们发现拟议方法的成功在于以下几个方面。首先,多任务学习至关重要,即SE网络不仅学习制作更多的智能语言,还旨在生成有利于承认的语音。第二,我们还发现从噪音中保留的语音阶段对于改进ASR的性能至关重要。第三,我们提出一种双频道数据增强培训方法,以获得进一步的改进。我们把清洁和强化的语音结合到整个系统的培训。我们评估了拟议的RATS英语数据集方法,实现了相对的WER降幅4.6%,同时采用联合培训方法,将WER的相对降幅率方法,将WER数据降为11.1%。