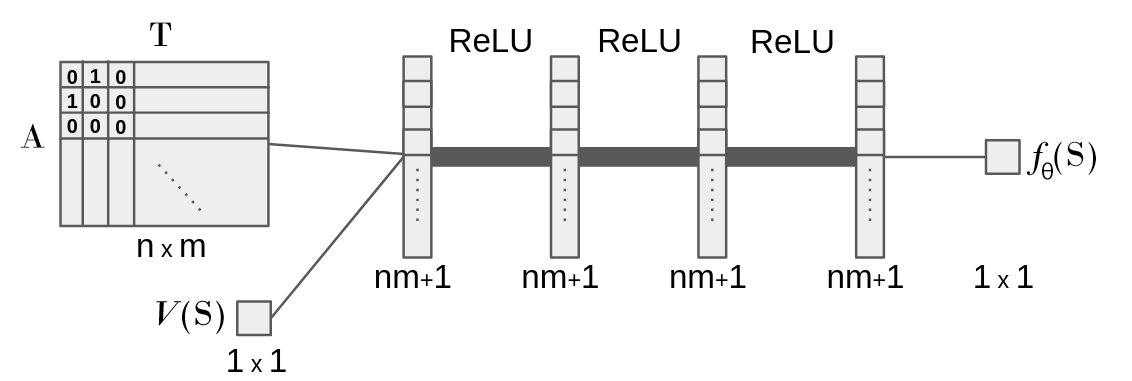

This paper presents preliminary work on using deep neural networks to guide general-purpose heuristic algorithms for performing utilitarian combinatorial assignment. In more detail, we use deep learning in an attempt to produce heuristics that can be used together with e.g., search algorithms to generate feasible solutions of higher quality more quickly. Our results indicate that our approach could be a promising future method for constructing such heuristics.

翻译:本文件介绍了关于利用深层神经网络指导通用超自然算法执行功利主义组合式任务的初步工作。 更详细地说,我们利用深层次的学习来试图产生可以与例如搜索算法一起使用的超自然学,以更快地产生更高质量的可行解决方案。 我们的结果表明,我们的方法可以成为今后建造这种超自然学的有希望的方法。