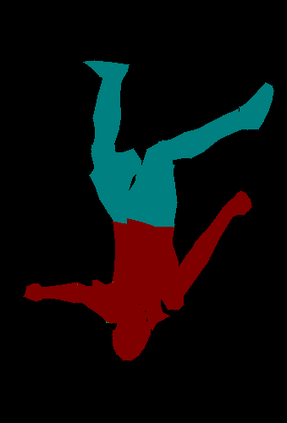

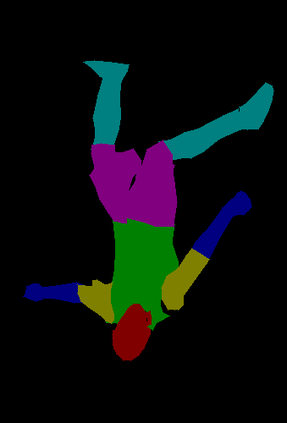

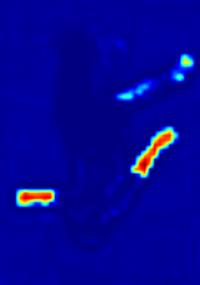

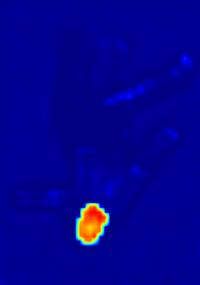

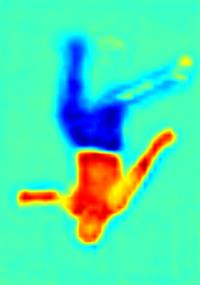

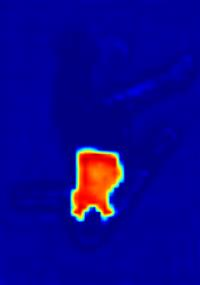

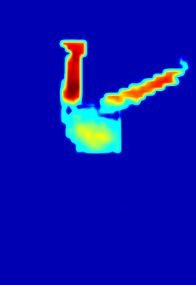

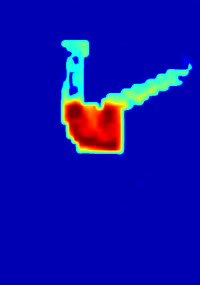

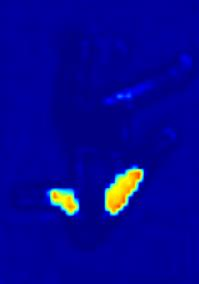

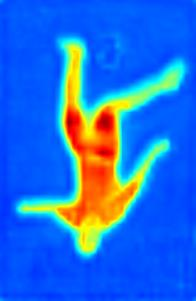

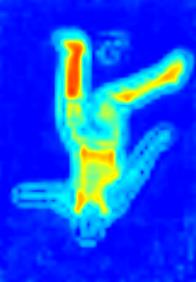

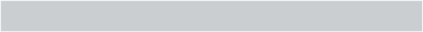

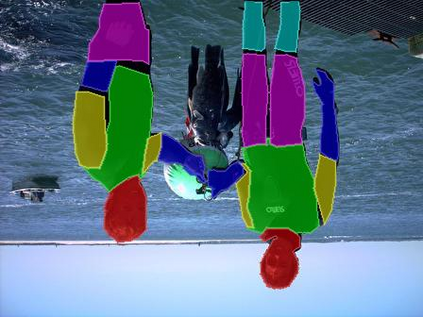

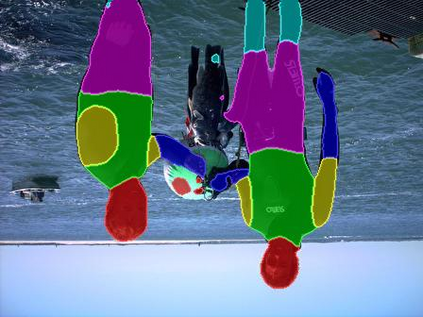

Human parsing is for pixel-wise human semantic understanding. As human bodies are underlying hierarchically structured, how to model human structures is the central theme in this task. Focusing on this, we seek to simultaneously exploit the representational capacity of deep graph networks and the hierarchical human structures. In particular, we provide following two contributions. First, three kinds of part relations, i.e., decomposition, composition, and dependency, are, for the first time, completely and precisely described by three distinct relation networks. This is in stark contrast to previous parsers, which only focus on a portion of the relations and adopt a type-agnostic relation modeling strategy. More expressive relation information can be captured by explicitly imposing the parameters in the relation networks to satisfy the specific characteristics of different relations. Second, previous parsers largely ignore the need for an approximation algorithm over the loopy human hierarchy, while we instead address an iterative reasoning process, by assimilating generic message-passing networks with their edge-typed, convolutional counterparts. With these efforts, our parser lays the foundation for more sophisticated and flexible human relation patterns of reasoning. Comprehensive experiments on five datasets demonstrate that our parser sets a new state-of-the-art on each.

翻译:人类剖析是用于像素的人类语义理解。 由于人体是等级结构基础, 如何建模人类结构是这项任务的中心主题。 聚焦于此, 我们寻求同时利用深图网络和等级人类结构的代表性能力。 特别是, 我们提供两种贡献。 首先, 三种部分关系, 即分解、 构成和依赖, 首次被三个不同的关系网络完全和准确地描述。 这与以前的分析者形成鲜明的对比, 以前的分析者只关注部分关系, 并采用类型认知关系建模战略。 更明显的关联信息可以通过在关系网络中明确设置参数来满足不同关系的具体特征来捕捉到。 其次, 以前的分析者基本上忽略了对循环人类等级的近似算法的必要性, 而我们则用一个迭代推理过程, 将通用信息传递网络与其边缘类型、 革命性对应者同化。 通过这些努力, 我们的剖析者为我们每一个更复杂和灵活的人际关系提供了基础, 展示了我们五种新的推理学模式。