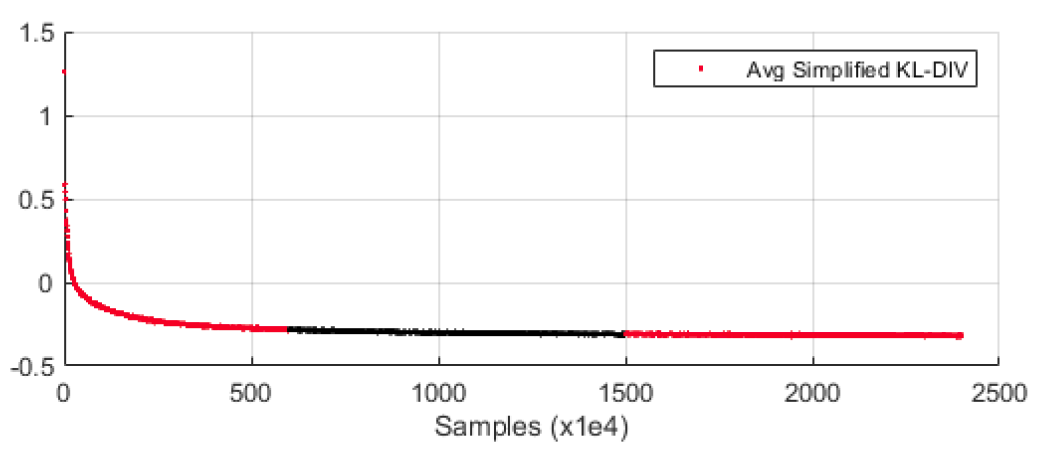

Generative neural networks are able to mimic intricate probability distributions such as those of handwritten text, natural images, etc. Since their inception several models were proposed. The most successful of these were based on adversarial (GAN), auto-encoding (VAE) and maximum mean discrepancy (MMD) relatively complex architectures and schemes. Surprisingly, a very simple architecture (a single feed-forward neural network) in conjunction with an obvious optimization goal (Kullback_Leibler divergence) was apparently overlooked. This paper demonstrates that such a model (denoted SGN for its simplicity) is able to generate samples visually and quantitatively competitive as compared with the fore-mentioned state of the art methods.

翻译:产生神经网络能够模仿诸如手写文字、自然图像等的复杂概率分布。 自从它们诞生以来,提出了若干模型,其中最成功的模型是基于对抗性(GAN)、自动编码(VAE)和最大平均差异(MMD)相对复杂的结构和计划。令人惊讶的是,一个非常简单的结构(一个单一的向神经网络)和明显的优化目标(Kullback_Leibeller差异)显然被忽视了。本文表明,这种模型(注意到SGN的简单性)能够产生与前述艺术方法状态相比具有视觉和数量竞争力的样本。