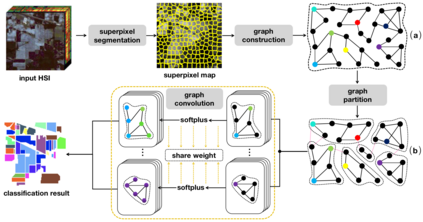

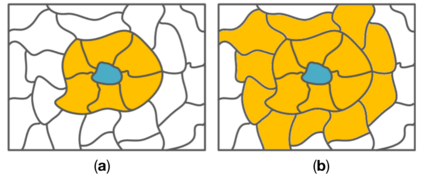

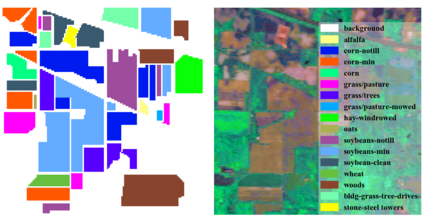

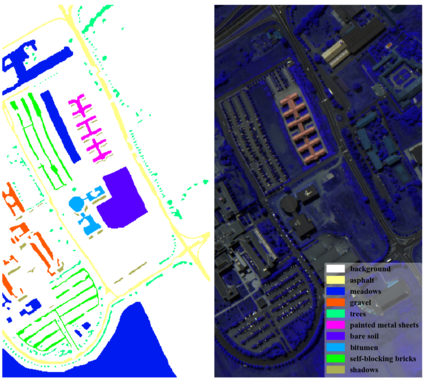

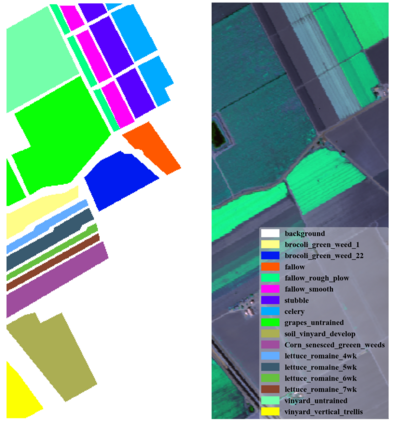

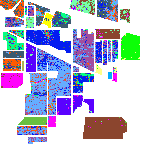

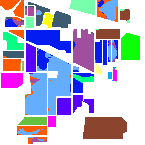

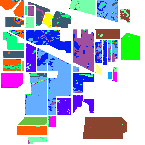

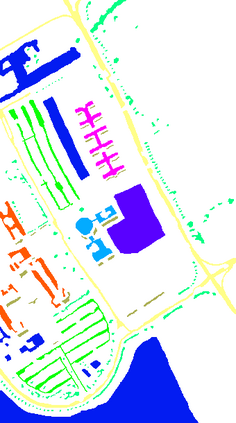

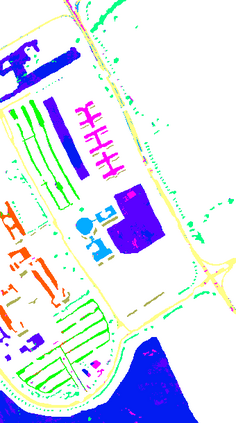

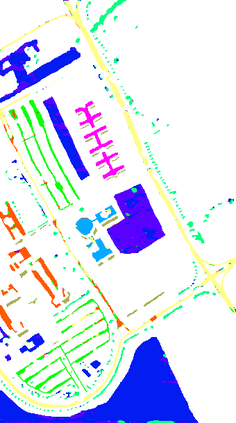

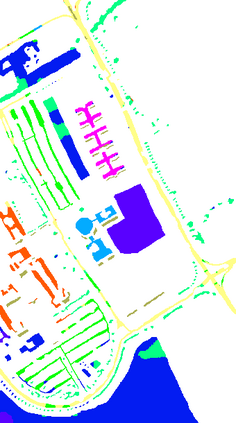

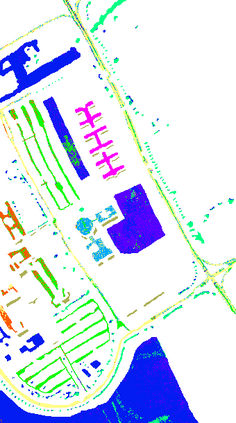

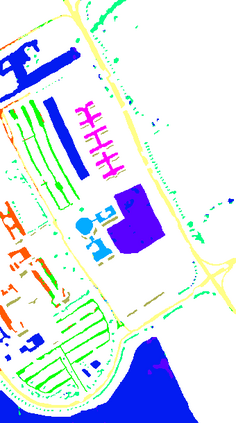

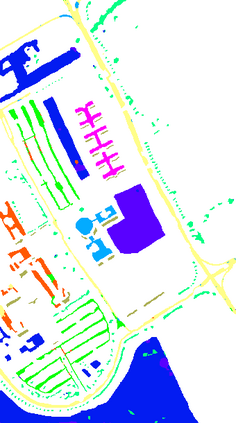

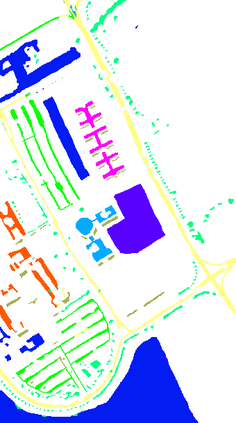

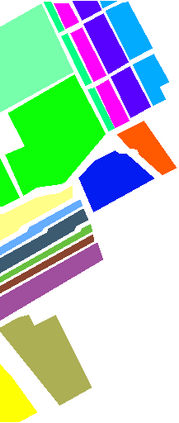

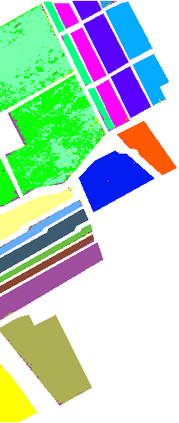

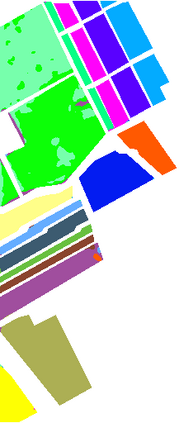

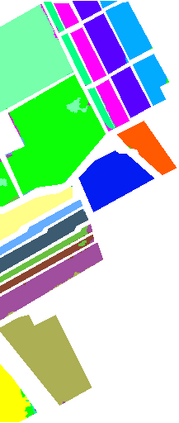

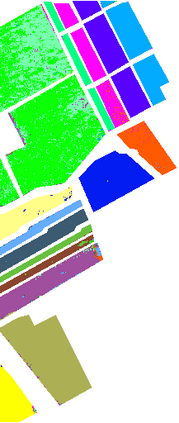

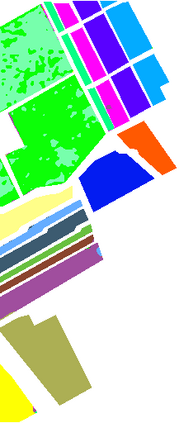

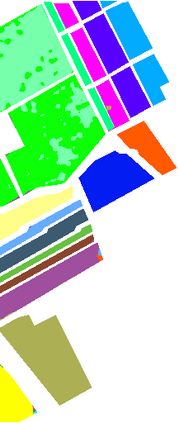

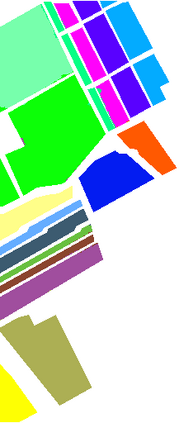

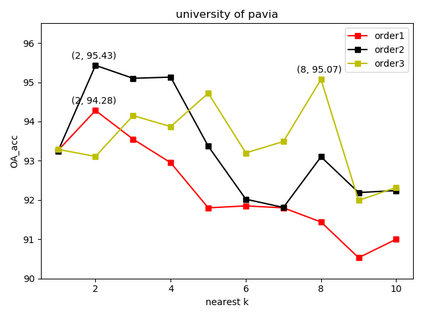

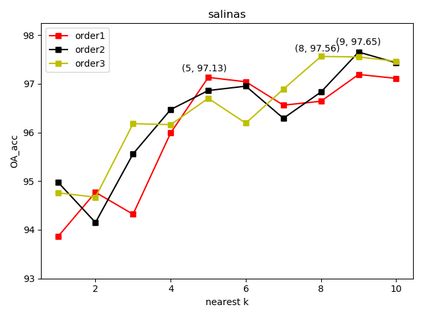

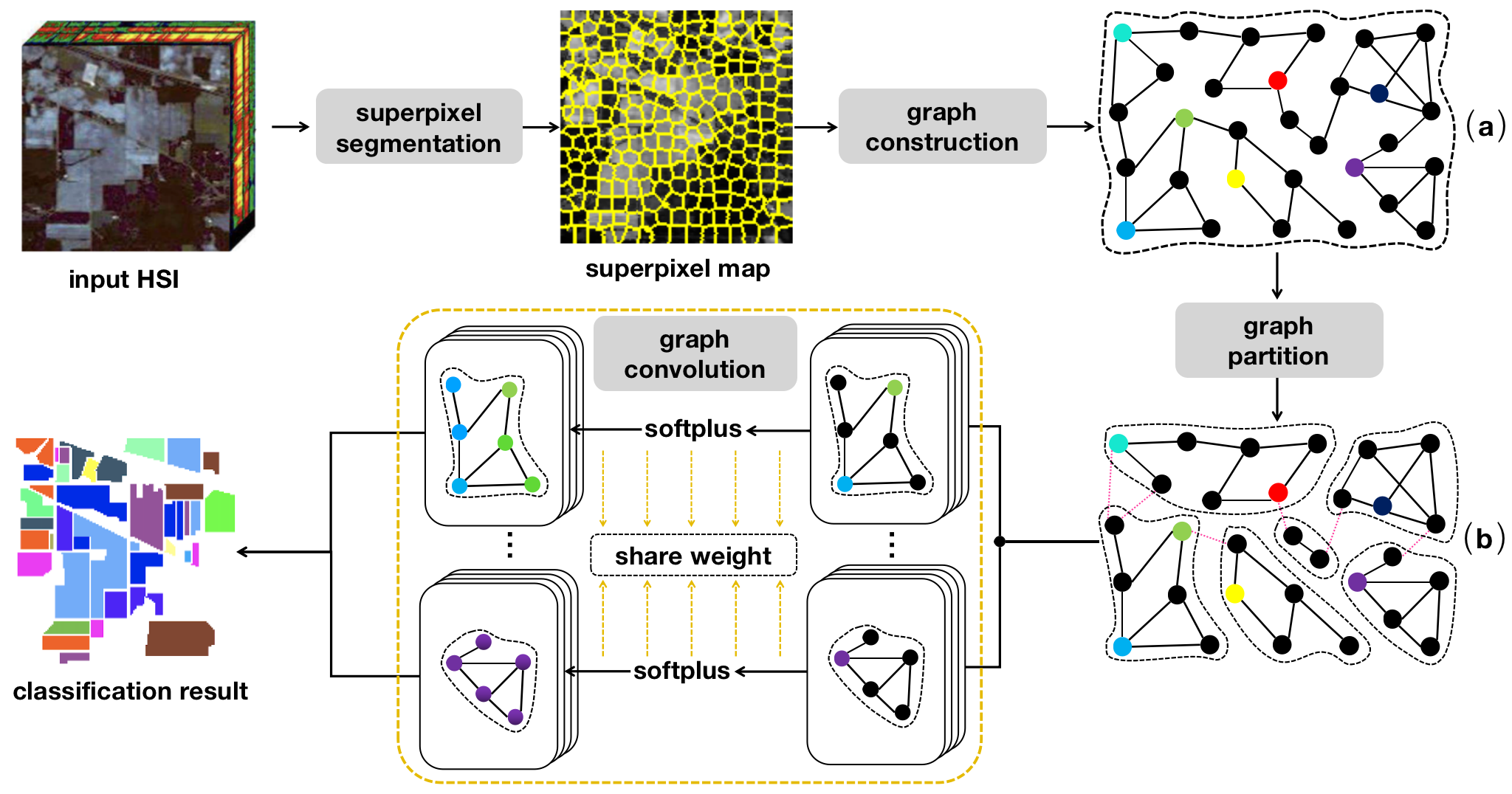

Hyperspectral image classification (HIC) is an important but challenging task, and a problem that limits the algorithmic development in this field is that the ground truths of hyperspectral images (HSIs) are extremely hard to obtain. Recently a handful of HIC methods are developed based on the graph convolution networks (GCNs), which effectively relieves the scarcity of labeled data for deep learning based HIC methods. To further lift the classification performance, in this work we propose a graph convolution network (GCN) based framework for HSI classification that uses two clustering operations to better exploit multi-hop node correlations and also effectively reduce graph size. In particular, we first cluster the pixels with similar spectral features into a superpixel and build the graph based on the superpixels of the input HSI. Then instead of performing convolution over this superpixel graph, we further partition it into several sub-graphs by pruning the edges with weak weights, so as to strengthen the correlations of nodes with high similarity. This second round of clustering also further reduces the graph size, thus reducing the computation burden of graph convolution. Experimental results on three widely used benchmark datasets well prove the effectiveness of our proposed framework.

翻译:超光谱图像分类(HIC)是一项重要但具有挑战性的任务,限制该领域算法发展的问题是,超光谱图像(HISI)的地面真实性极难获得。最近,根据图形相联网络(GCNs)开发了几套HIC方法。最近,根据图形相联网络(GCNs)开发了一些HIC方法,这些方法有效地缓解了深层学习基于 HIC 方法的标签数据稀缺问题。为了进一步提升分类性能,我们在此工作中提议了一个基于图形相联网络(GCN)的基于HSI分类的框架,它使用两个组合操作来更好地利用多点节点关联性,并有效地缩小图形大小。特别是,我们首先将具有类似光谱特征的像素混成一个超级像素,然后根据输入HSI的超级像素网络(GCNs)建立图表。然后,我们通过用微重的边缘来将它进一步分隔成几个子图,从而强化高相似度结点的关联性。这第二轮组合还进一步减少了图形大小,从而缩小了我们使用的图表基数基准框架的计算负担。