题目: Algorithmic Decision Making with Conditional Fairness

摘要:

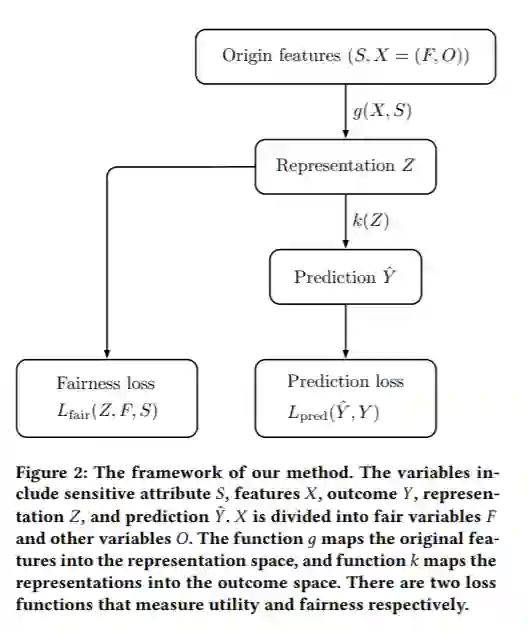

当前,公平问题已成为决策系统中备受关注的问题。人们提出了各种公平概念来衡量算法的不公平程度。在实践中,经常存在一组我们称为公平变量的变量,即用户的选择等决策前协变量。公平变量的影响与评价决策支持算法的公平性无关。因此,我们定义条件公平作为一个更健全的衡量公平的条件,对公平变量。鉴于对公平变量的不同先验知识,我们证明了传统的公平符号,如人口均等和均等概率,是我们的条件公平符号的特殊情况。此外,我们提出了一种可推导的条件公平性调节器(DCFR),该调节器可集成到任何决策模型中,以跟踪算法决策精度与公平性之间的权衡。具体地说,我们在DCFR中提出了一个基于条件独立性损失的对抗性表示来衡量不公平的程度。通过对三个真实数据集的广泛实验,我们证明了我们的条件公平性表示法和DCFR的优点。

成为VIP会员查看完整内容

相关内容

专知会员服务

47+阅读 · 2020年6月3日

专知会员服务

38+阅读 · 2020年5月30日

【2020密歇根大学论文】基于学习的序列决策算法的公平性综述论文,Fairness in Learning-Based Sequential Decision Algorithms: A Survey

专知会员服务

22+阅读 · 2020年1月15日

Arxiv

7+阅读 · 2019年10月21日

Arxiv

15+阅读 · 2018年5月24日

Arxiv

4+阅读 · 2018年2月22日