现在来自密西根州立大学的汤继良团队即将出版一本全面性介绍图深度学习的书:《Deep Learning on Graphs》。

全书概要

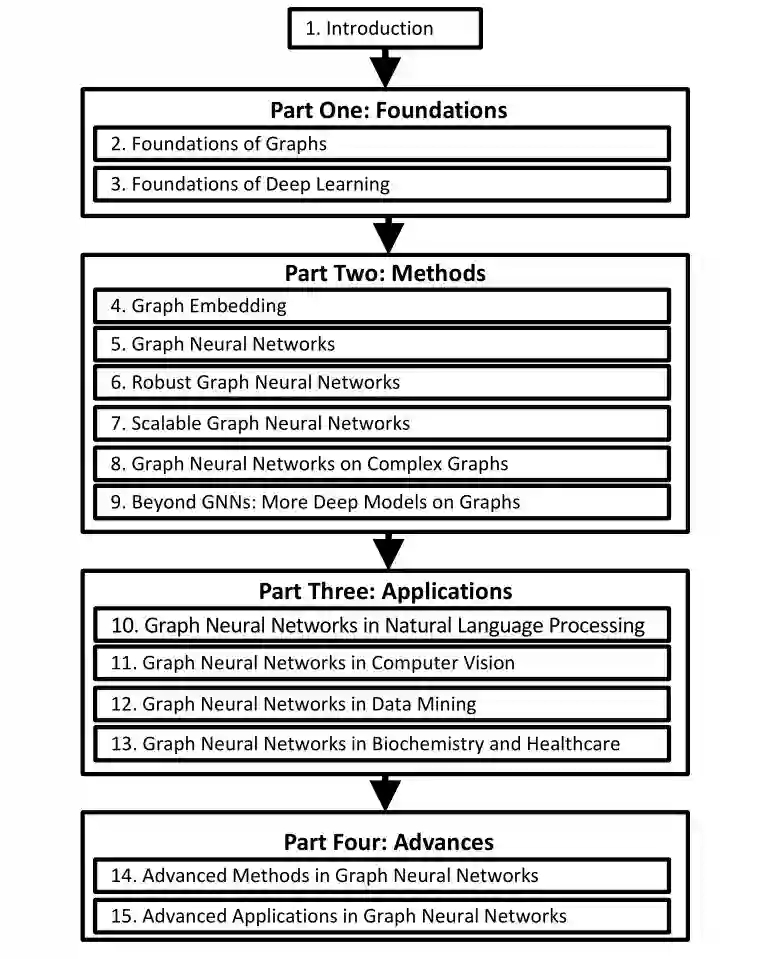

为了最好地适应具有不同背景和阅读目的的读者,该书由四个部分组成。 第1部分介绍了基本概念;第2部分讨论了该领域最成熟的方法;第3部分介绍了最具代表性的实际应用,而第4部分介绍了有可能成为将来研究热点的高级方法和应用。每部分的内容如下:

第1部分:基本概念篇

在该部分的章节重点介绍图和深度学习的基础知识,这些基础将为图的深度学习奠定基础。在第1章中,介绍了图的关键概念和属性,图傅里叶变换,图形信号处理,并正式定义了各种类型的复杂图和在图上的计算任务。在第2章中,讨论了各种最基础的神经网络模型,训练深度模型的关键方法以及防止训练过程中过度拟合的实用技术。

第2部分:方法篇

这些章节涵盖了从基本设置到高级设置的最成熟的图深度学习方法。在第3章中,从信息保存的角度介绍了一种通用的图嵌入框架,提供了有关在图像上保留多种类型信息的代表性算法的技术细节,并介绍了专门为复杂形设计的嵌入方法。典型的图神经网络模型包括两个重要操作,即图过滤操作和图池化操作。

在第4章中,回顾了最新的图过滤和池化操作,并讨论了如何在给定下游任务的时学习GNN参数。GNNs是传统深度模型在图上的泛化,因此它们继承了传统深度模型的缺点,容易受到对抗攻击。

在第5章中,重点介绍图对抗攻击的概念和定义,并详细介绍了具有代表性的对抗攻击和防御技术。GNN执行跨层邻域的递归扩展。单个节点邻域的扩展会迅速涉及图的很大一部分甚至整个图。因此,可扩展性是GNN需要解决的紧迫问题。

在6章中详细介绍了用于可扩展性GNN的代表性技术。在第7章中,讨论了为更复杂的图设计的GNN模型。为了使深度学习技术能够在更广泛的设置下推进更多的图应用,在第8中介绍了GNN之外的众多图深度模型。

第3部分:实际应用篇 图提供了真实数据的通用表示方法;因此,在图深度学习方法已应用于各个领域。在这部分的章节中,将介绍了GNN的最具代表性的应用,包括第9章中的自然语言处理,第10章中的计算机视觉,第11章中的数据挖掘和第12章中的生物化学与医疗保健。

第4部分:进展篇 在该部分章节中,重点介绍方法和实际应用方面的最新进展。在13章中,从表达性,深度,公平性,可解释性和自我监督学习方面介绍了高级GNNs。在第14中,讨论了GNN应用的更多领域,包括组合优化,物理,程序表示, 和计算机网络。

英文书预印本免费下载链接如下。大家可以订阅该书。订阅者会自动推送关于该书的最新信息包括针对该书的中英文版的幻灯片和教程视频。同时欢迎大家提供反馈。