清华大学朱文武课题组:《图深度学习》综述论文,15页pdf

【导读】今年以来,DeepMind、Google大脑、MIT等各大研究机构相继发表了一系列的关于图深度学习的论文,包括关系性RNN、关系性深度强化学习、图卷积神经网络等,是当前的研究热点。今日,清华大学朱文武老师课题组在ArXiv上发表了一篇《图深度学习》综述论文,详细全面总结了最新图深度学习的进展,是研究该领域的重要的参阅资料。

作者介绍

张子威,清华大学计算机科学与技术系博士生,研究兴趣为网络嵌入与社会网络分析,特别是运用矩阵分析理论

https://zw-zhang.github.io/

崔鹏,清华计算机系副教授、博导,CCF YOCSEF 学术委员会委员,中国科协第九届全国委员会委员。研究领域包括大数据环境下的因果推理与稳定预测、网络表征学习、社会动力学建模。已在数据挖掘及多媒体领域顶级国际期刊和会议上发表论文百余篇,并先后获得7项国际会议及期刊最佳论文奖。目前担任IEEE TKDE、IEEE TBD、ACM TOMM等三个Transactions期刊的编委。获得中国计算机学会青年科学家奖,国际计算机协会(ACM)中国新星奖,并入选中国科协首届青年人才托举计划。曾先后获得教育部自然科学一等奖、北京市科技进步一等奖、中国电子学会自然科学一等奖。

http://pengcui.thumedialab.com/

朱文武,CCF杰出会员。清华大学计算机系副主任、数据科学研究院首席科学家,国家“千人计划”特聘专家,国家973项目首席科学家。 IEEE Fellow、AAAS Fellow、SPIE Fellow、ACM Distinguished Scientist。曾任微软亚洲研究院主任研究员,英特尔中国研究院首席科学家,及美国贝尔实验室研究员等职。现主要从事三元空间大数据计算、视频大数据计算、未来多媒体网络等研究工作。现担任IEEE Transactions on Multimedia 主编。曾6次获ACM及IEEE等国际最佳论文奖。获2012年度国家自然科学二等奖(排名第2)

图深度学习

网址:

http://www.zhuanzhi.ai/paper/abe85f14a3697712fd1c3d0c3b5ddcb0

摘要:

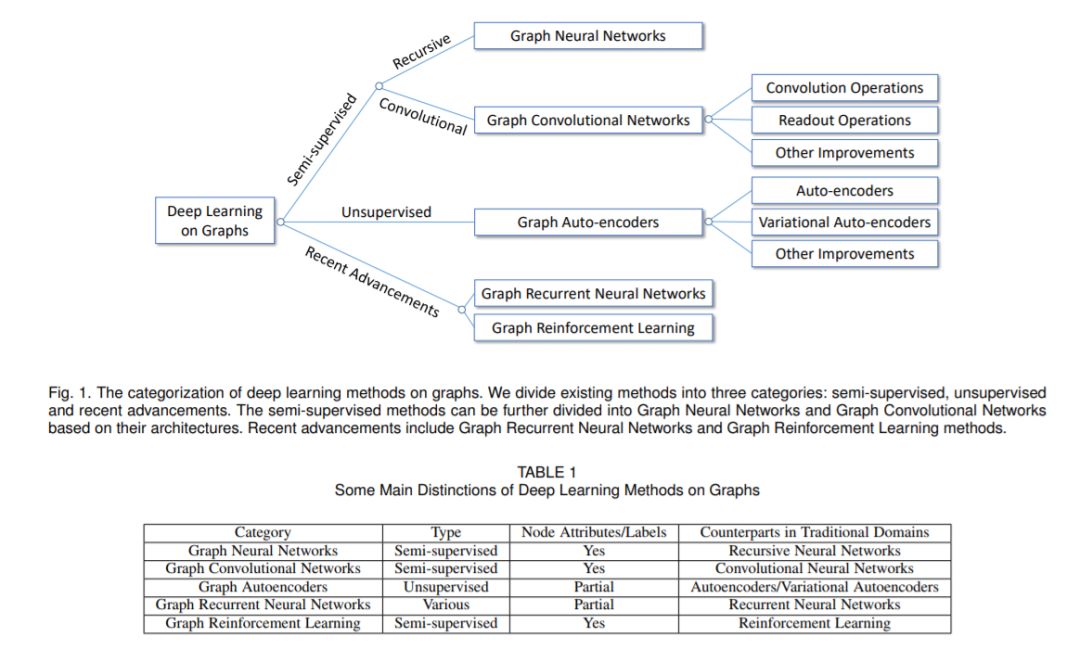

从声学、图像到自然语言处理,深度学习在许多领域都取得了成功。然而,将深度学习应用于无所不在的图数据并非易事,因为图形具有独特的特性。近年来,这一领域的研究取得了很大的进展,极大地推动了图分析技术的发展。在本研究中,我们全面回顾了应用于图深度学习各种方法。我们将现有的方法分为三大类:半监督方法,包括图神经网络和图卷积网络; 非监督方法,包括图自动编码器; 然后,我们根据这些方法的发展历史,系统地概述这些方法。我们还分析了这些方法的差异以及如何组合不同的体系结构。最后,简要概述了它们的应用,并讨论了未来可能的发展方向。

图深度学习方法分类

请关注专知公众号(点击上方蓝色专知进行关注)

后台回复“GDLS” 就可以获取图深度学习页pdf下载链接~

-END-

专 · 知

人工智能领域26个主题知识资料全集获取与加入专知人工智能服务群: 欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知