现代军事行动不仅要求数据与知识保持最新状态并能体现既定背景与目标,还日益意味着需采用自适应、智能且鲁棒的系统、方法与解决方案,其中人类专家与基于人工智能(AI)的系统经常通过交互与协调来实现共同目标。在此背景下,本研究旨在为军事行动领域内的人机AI编队引入一种计算本体,以便对其组成智能体、作为集体智能体的编队设置及其底层结构、特征、关系和行为进行表示、建模和推理,同时考量相应的自主性、反馈和信任维度。在此范围内,本研究考虑采用遵循知识表示与推理(KRR)指导原则的设计科学研究(DSR)方法论。

现代军事行动日益凸显的复杂性、动态性和不确定性特征,要求采用创新的智能自适应解决方案来支持决策、态势感知和交互。由于这些行动跨越涵盖特定战场要素与信息的多个领域,并涉及各种人类及系统行为方面与动态,实现任务成功越来越依赖于由负责任、可信赖的智能系统支持的及时且知情的决策。军事领域持续技术进步的核心是人工智能(AI)技术[1], [2],其中一个特定的技术领域致力于构建人类专家与AI模型之间的交互与协作系统,形成人机AI团队,从而将人类的战略、创造性、多面性及伦理判断与AI系统的计算能力、精确性和严谨性相融合[3]。

这一新范式——人机AI编队——在军事领域指的是人类与AI智能体之间旨在动态复杂的军事环境与设定下实现共同军事目标的协作性交互与协调。这种伙伴关系涵盖从态势感知、决策支持到作战执行与评估的一系列交互,其中自主性水平、信任和反馈机制等因素对确保有效且基于伦理的结果起着重要作用[4]–[6]。一个关键关切在于平衡编队环境中存在的自主性水平(从完全人工控制到全自主系统),同时确保智能体队友间无缝的反馈交流并维持相互信任[7], [8]。另一个关切与各种AI模型所具有的不透明性相关,因为这直接影响到编队智能体的可解释性与透明度[9]–[11],尤其是在需要关键伦理判断或不确定性下快速决策(例如,目标接战)的场景中。

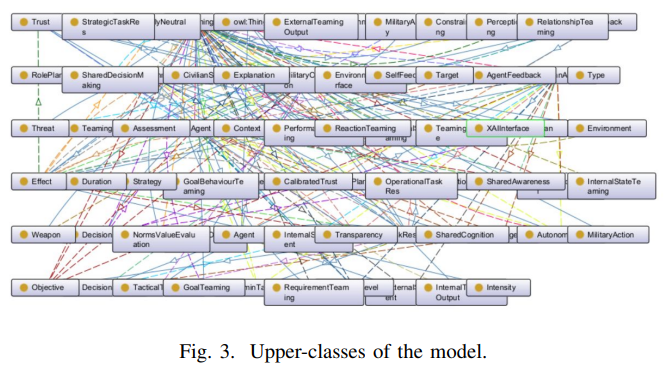

解决这些问题需要一种形式化的建模方法来表示和分析这些智能体团队的交互、行为及结构特征,并明确关注自主性、反馈和信任维度之间的相互作用。因此,本研究旨在开发一种用于军事行动中的人机AI编队的计算本体。此类模型为知识表示与推理提供形式化结构,使得能够规范表征特定领域的实体、关系及属性。在本研究背景下,所提出的模型对两个组成智能体(人类与AI)、作为集体智能体的编队设置以及支撑决策过程的交互进行建模。这项工作是在知识表示与推理范式原则的指导下,遵循设计科学研究方法进行的,以同时支持描述性推理和推理性推理[12]–[14]。这有助于考量涉及自主性水平变化、作战需求转变以及威胁演变性质等方面的各种人机AI编队军事应用场景。

通过计算模型将人机AI编队形式化,本研究解决了该领域现有的一个空白,并为未来的计算发展奠定了基础。同时,该模型能够对人机AI编队设置中的自主性、性能和信任等关键维度进行形式化表示和推理。具体而言,信任影响人机AI编队的可靠性并直接影响所获得的效果。例如,高自主性系统必须展现出足够的透明度以培养信任,而共享自主性设置则需要决策责任的高效协调。因此,该模型通过将性能结果与透明度、可解释性及反馈质量相联系来形式化此类动态,创建一个知识库,该知识库可进一步建模并为军事领域开发负责任、可信赖的AI系统提供信息。

本文提纲结构如下。第二部分介绍在该领域进行的相关研究。第三部分讨论本研究中采用的方法论。第四部分介绍本研究中提出的模型的设计与开发。第五部分反思该领域的结论性意见及未来研究前景。