题目: Representation Learning on Graphs: Methods and Applications

摘要:

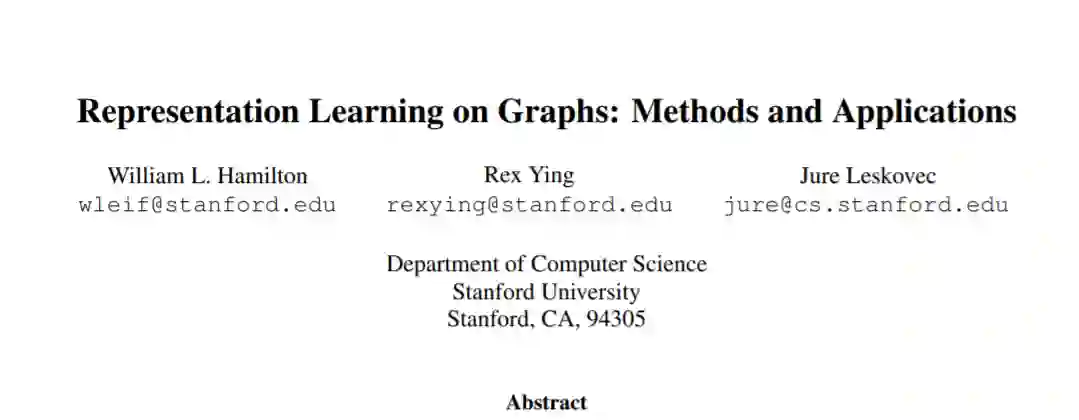

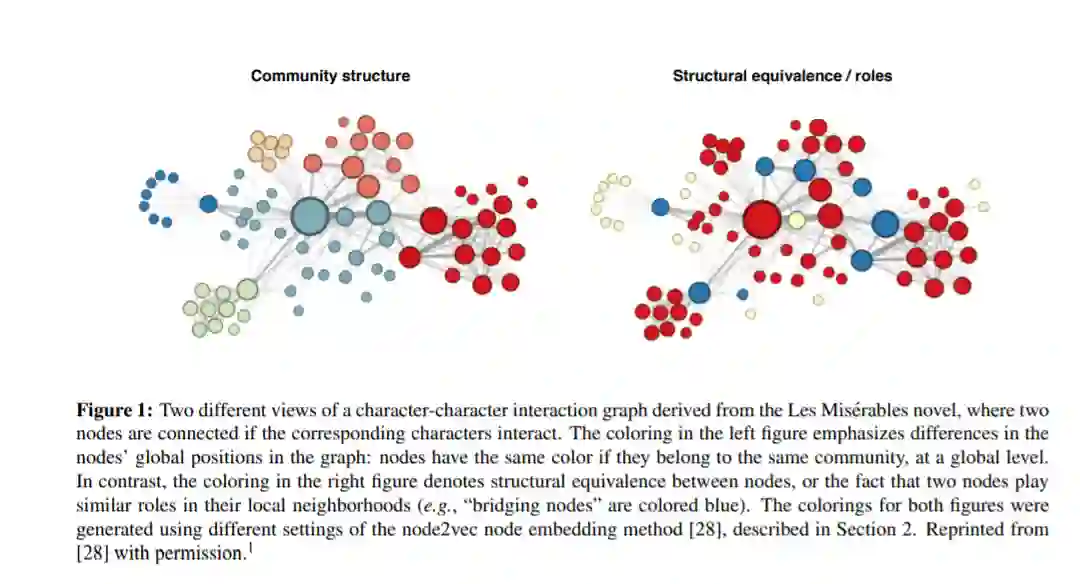

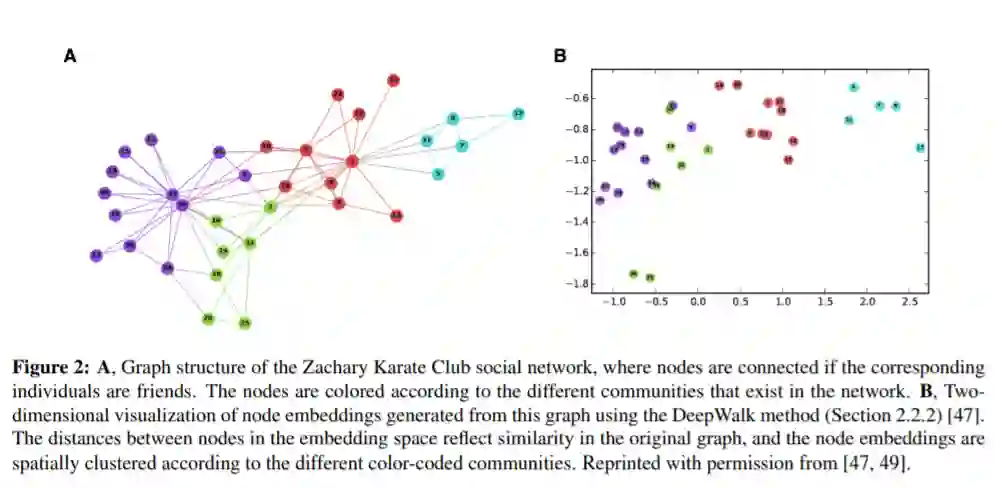

图机器学习是一项重要且普遍存在的任务,其应用范围从药物设计到社交网络中的友情推荐。这个领域的主要挑战是找到一种表示或编码图形结构的方法,以便机器学习模型能够轻松地利用它。传统上,机器学习方法依赖于用户定义的启发法来提取对图的结构信息进行编码的特征(例如,度统计或内核函数)。然而,近年来,使用基于深度学习和非线性降维的技术,自动学习将图结构编码为低维嵌入的方法激增。在这里,我们提供了一个概念上的回顾,在这一领域的关键进展,图表示学习,包括基于矩阵分解的方法,随机漫步的算法和图神经网络。我们回顾了嵌入单个节点的方法以及嵌入整个(子)图的方法。在此过程中,我们开发了一个统一的框架来描述这些最近的方法,并强调了一些重要的应用程序和未来工作的方向。

作者简介:

William L. Hamilton是麦吉尔大学计算机科学的助理教授,也是加拿大魁北克Mila AI研究所的CIFAR AI主席。William L. Hamilton开发的机器学习模型可以对这个复杂的、相互联系的世界进行推理。研究兴趣集中在机器学习、网络科学和自然语言处理的交叉领域,目前的重点是快速发展的图表示学习和图神经网络。

Rex Ying是斯坦福大学计算机科学二年级的博士生,研究主要集中在开发应用于图形结构数据的机器学习算法。曾致力于开发可扩展到网络规模数据集的广义图卷积网络,应用于推荐系统、异常检测和生物学。

成为VIP会员查看完整内容

相关内容

专知会员服务

115+阅读 · 2020年1月3日

专知会员服务

42+阅读 · 2019年12月16日

专知会员服务

140+阅读 · 2019年12月16日

专知会员服务

74+阅读 · 2019年11月20日