题目: A Survey on Network Embedding

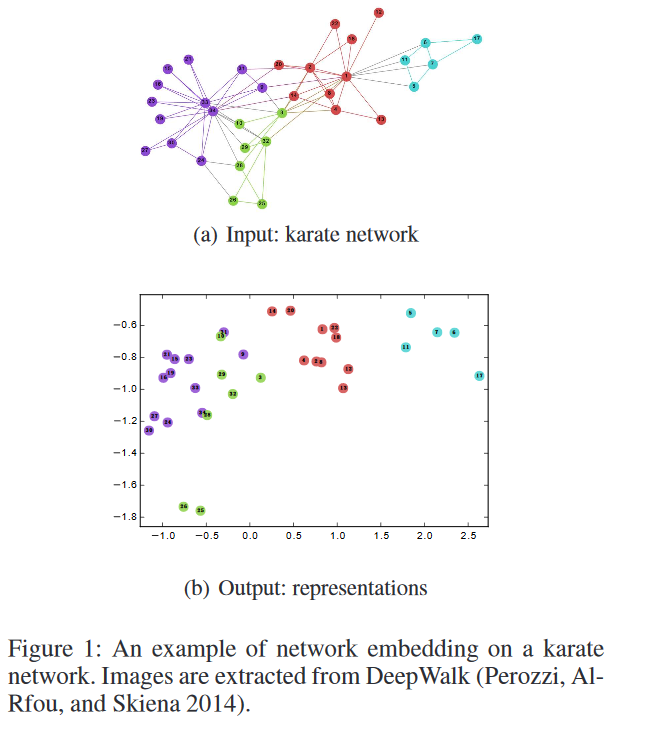

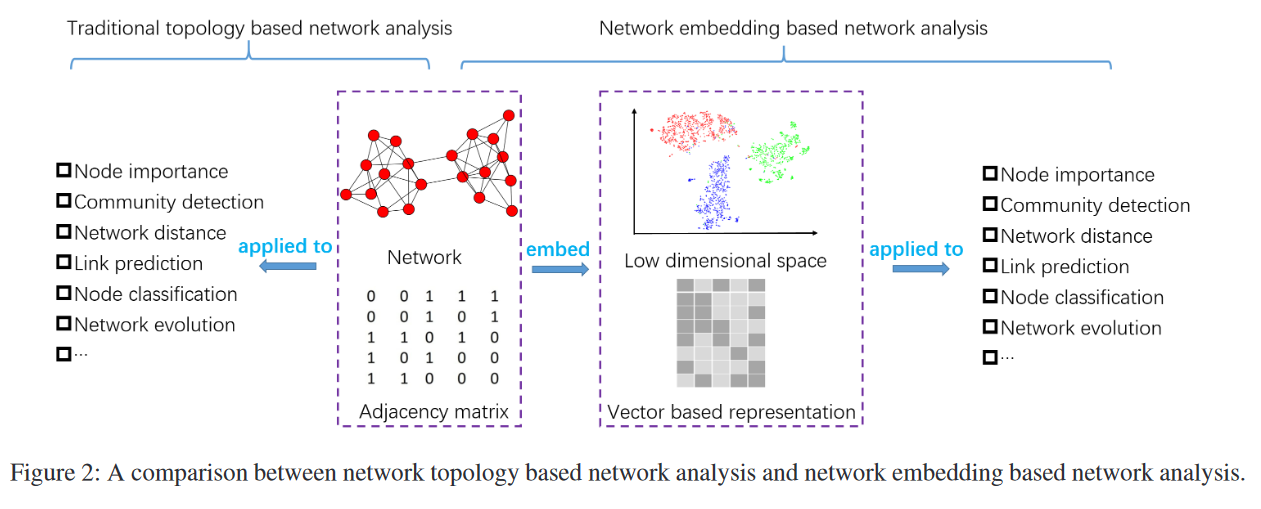

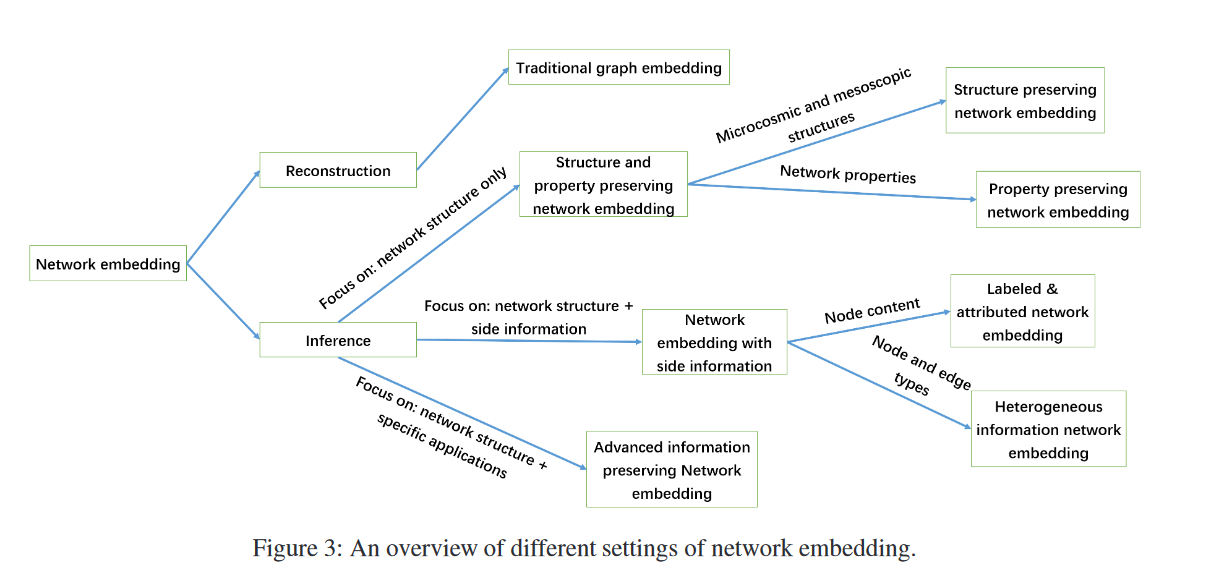

摘要: 网络嵌入将网络中的节点分配给低维表示,有效地保持了网络结构。近年来,这一新兴的网络分析范式取得了很大的进展。本文首先对网络嵌入方法进行了分类,然后回顾了网络嵌入方法的发展现状,并指出了其未来的研究方向。我们首先总结了网络嵌入的动机。讨论了经典的图嵌入算法及其与网络嵌入的关系。随后,我们对大量的网络嵌入方法进行了系统的综述,包括结构和属性保持的网络嵌入方法、带边信息的网络嵌入方法和先进的信息保持的网络嵌入方法。此外,还综述了几种网络嵌入的评价方法和一些有用的在线资源,包括网络数据集和软件。最后,我们讨论了利用这些网络嵌入方法构建有效系统的框架,并指出了一些潜在的未来方向。

作者简介: Peng Cui,清华大学计算机科学与技术系媒体与网络实验室副教授。

Jian Pei,现任加拿大大数据科学研究主席(Tier 1)和西蒙弗雷泽大学(Simon Fraser University)计算科学学院教授。他还是统计与精算科学系、科学院和健康科学院的副院士。他是数据科学、大数据、数据挖掘和数据库系统等领域的知名首席研究员。他的专长是为新的数据密集型应用开发高效的数据分析技术。他被公认为计算机械协会(ACM)的研究员,他为数据挖掘的基础、方法和应用做出贡献,并作为电气与电子工程师协会(IEEE)的研究员,为他的数据挖掘和知识发现做出贡献。

成为VIP会员查看完整内容

相关内容

人工智能(Artificial Intelligence, AI )是研究、开发用于模拟、延伸和扩展人的智能的理论、方法、技术及应用系统的一门新的技术科学。 人工智能是计算机科学的一个分支。

专知会员服务

147+阅读 · 2019年12月16日

专知会员服务

42+阅读 · 2019年12月16日

专知会员服务

73+阅读 · 2019年12月16日

专知会员服务

52+阅读 · 2019年12月16日

专知会员服务

140+阅读 · 2019年12月16日

Arxiv

4+阅读 · 2018年4月23日

Arxiv

17+阅读 · 2017年12月12日