面对电车难题,自动驾驶交了一张白卷

大数据文摘出品

编译:jin、钱天培

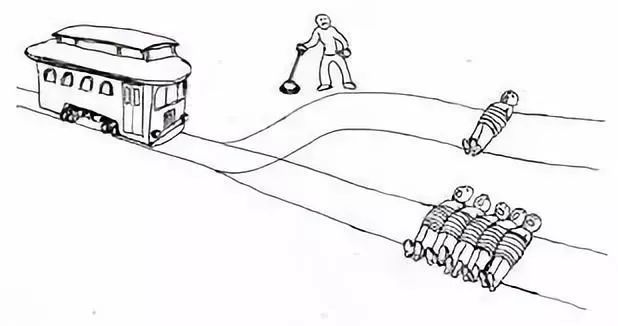

一辆刹车失灵的有轨电车正在急速行驶,前面的铁轨上绑着一群人, 如果任由电车行驶, 那群人必将罹难。

这时你站在铁轨正上方的天桥上, 你前面有一个胖子, 你可以将他推下天桥以阻挡住电车来营救那群人,不过这个胖子会遇难。

当然,你考虑过自己跳下去,但由于你自己的体积太小而无法阻挡电车,这个方案并不可行。

请问这时你是推还是不推?

这就是经典的电车困境了——1967年由哲学家Philippa Foot提出。50年之后,来自麻省理工学院媒体实验室(the MIT of Media Lab)可扩展合作小组(the Scalable Cooperation group)的数名研究人修改了这项道德难题,将有轨电车换成自动驾驶汽车,并征集了来自全球的回答。

游戏链接如下,大家可以先自行感受一把。

http://moralmachine.mit.edu/

文摘菌玩的时候救得最多的竟然是男运动员

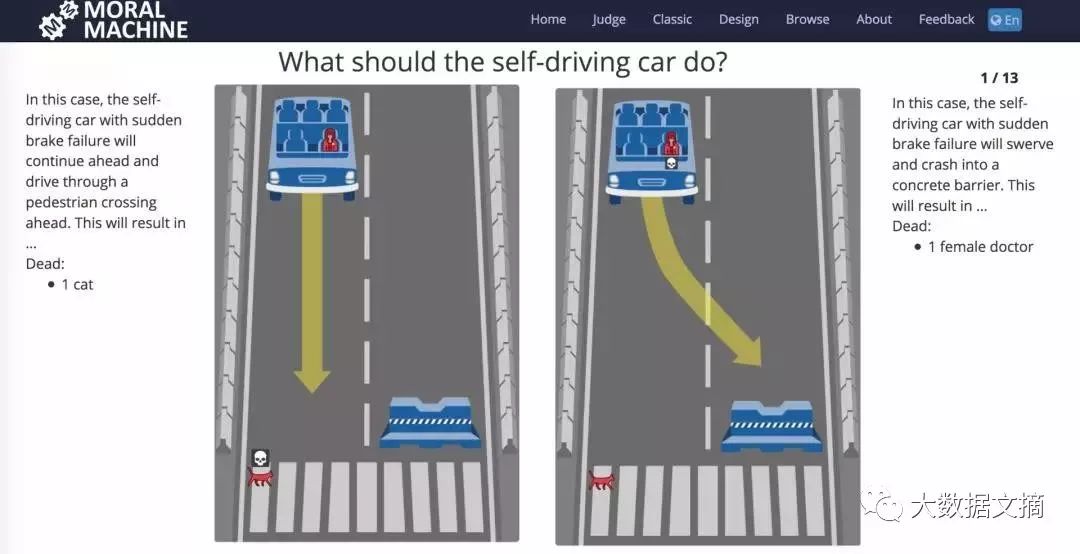

2016年,麻省理工学院创建了名为“道德机器”的游戏平台,通过此平台收集人类对未来人工智能可能会遇到的道德困境的不同意见。

游戏中,正在行驶的自动驾驶汽车直行会撞到一位年迈老奶奶,如果选择变道则会撞到一位年迈老爷爷(有时可能是五只狗或是五个轻微肥胖的男性)。

在这个游戏中,玩家所要做出的不再只是一瞬间的抉择,而是未来将会被编写进汽车程序中的预先判断。

据《Nature》杂志报道,经过两年时间,MIT已收集到3亿9千6百万份数据,该数据来源覆盖了10种语言,233个国家和地区,囊括了多个不同文化对该困境的道德态度。

对这些数据进行分析发现,东方国家例如日本、沙特阿拉伯和印度尼西亚,人们倾向于保护那些遵纪守法的人。西方国家例如美国、加拿大、挪威和德国更倾向于选择不变道,让汽车继续直行。而在一些拉丁美洲国家,例如尼加拉瓜和墨西哥,人们更倾向于为健康的、年轻的或是地位高的人选择变道。

从整体上看,人们普遍倾向保护人类而非动物,愿意牺牲少数保护多数,同时更倾向于保护年轻人。

无人车的伦理问题不是个简单的选择题。从学界到业界,都在孜孜不倦进行研究。

今年3月份,MIT、哈佛、加州大学尔湾分校、法国图卢兹大学的一个联合研究小组,致力于通过定量研究的手段,了解人们在面对无人车事故时的态度,并于最近发布了研究成果。

大数据文摘公众号后台对话框回复“背锅”下载这篇论文。

论文作者来自脑和认知科学、心理学、经济学等多个不同领域,MIT火爆的无人车课程讲师Sydney Levine也是作者之一。

针对自动驾驶的道德问题,多数自动驾驶从业者对该问题都没有明确回应,只能报以一声叹息。

行驶道路上,汽车难免会遇到冲撞情境,工程师们必须要考虑将如何权衡与抉择编写进自动驾驶汽车的程序当中。MIT媒体实验室博士后合作者Edmond Awad提到:“我们主要的目的在于,去了解一旦事故发生,人们会如何反应。我们将这个游戏作为大型平台,以供专家们观察和分析公众的反应。”

那么,搭建这项技术的工程师到底是如何看待道德困境的呢?

大多数人选择,不作答。

Karl Iagnemma(Aptiv Automated Mobility 总裁兼自动驾驶车辆公司nuTonomy的共同创办人)表示:“从工程师的角度看,解决这个困境需要基于两点考虑。首先,谁都无法确定正确的解决方法是什么,甚至都无法确定是否存在解决方法。其次,像这样的事故概率是极其微小的,并且自动驾驶技术会让这一概率继续减小。”

另外,自动驾驶汽车无法做到像游戏中的玩家一样进行复杂的利弊权衡然后做出抉择,它们的传感器甚至都无法辨别出汽车尾气与墙面,更不必说百万富翁与流浪汉了。

目前,开发者更多的是在关注一些基础问题,比如训练机器辨识骑自行车的人和停靠的车辆或是行驶的车辆。

不过,工程师同时也正在让技术进行基本的利弊权衡判断。

来自开发自动驾驶汽车感知系统的DeepScale公司的首席执行官Forrest Iandola告诉我们:“自动驾驶汽车会将检测到的目标分为从脆弱到不脆弱的几个等级。其中,最重要的脆弱对象是毫无防卫的人类,而停靠的汽车或是交通路标则被分类为不脆弱——也就是汽车在不得已的情况下会选择撞上的对象。”

除此之外,自动驾驶车辆同时必须要适应世界不同文化。例如,NuTonomy在波士顿和新加坡测试了自动驾驶技术,形成了适应不同文化和情境的“规则手册”。

不单单是nuTonomy这一家企业有着这样的考虑,其他企业也同样关注文化差异。Iagnemma表示:“我们所有都致力于构建安全且设计良好的系统。接下来我们将会关注驾驶偏好、文化和地理等问题,这些同样也会涉及道德伦理问题。”

自动驾驶产业对利弊权衡和文化差异都已进行了不同的考量,更深层的道德问题也终将会被提上日程。

自动驾驶对电车难题会交出怎样的答卷,我们屏息以待。

相关报道:

https://www.wired.com/story/trolley-problem-teach-self-driving-car-engineers/

【今日机器学习概念】

Have a Great Definition

志愿者介绍

后台回复“志愿者”加入我们