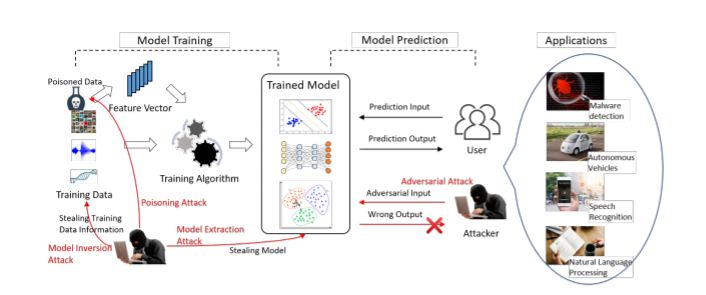

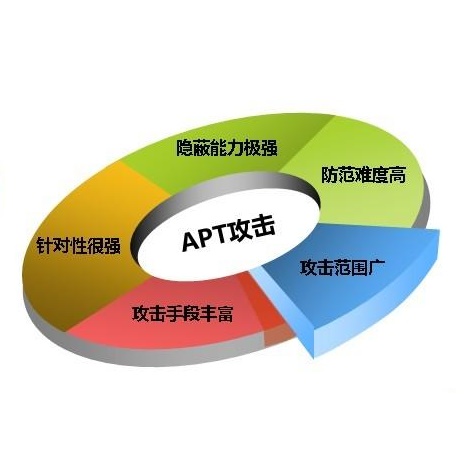

在过去的几年里,深度学习取得了巨大的成功,无论是从政策支持还是科研和工业应用,都是一片欣欣向荣。然而,近期的许多研究发现,深度学习拥有许多固有的弱点,这些弱点甚至可以危害深度学习系统的拥有者和使用者的安全和隐私。深度学习的广泛使用进一步放大了这一切所造成的后果。为了揭示深度学习的一些安全弱点,协助建立健全深度学习系统,来自中科院信息工程所和中国科学院大学网络安全学院的研究人员,全面的调查了针对深度学习的攻击方式,并对这些手段进行了多角度的研究。

成为VIP会员查看完整内容

相关内容

专知会员服务

46+阅读 · 2020年1月25日