【泡泡图灵智库】高信息量运动片段上的视觉惯导自校准(ICRA)

泡泡图灵智库,带你精读机器人顶级会议文章

标题:Visual-inertial Self-calibration on Informative Motion Segments

作者:Thomas Schneider, Mingyang Li, Michael Burri, Juan Nieto, Roland Siegwart and Igor Gilitschenski

来源:ICRA2017

编译:黄文超

审核:刘小亮

欢迎个人转发朋友圈;其他机构或自媒体如需转载,后台留言申请授权

摘要

大家好,今天为大家带来的文章是——高信息量运动片段上的视觉惯导自校准,该文章发表于ICRA2017 。

环境条件和外部影响(如震动),对视觉惯导系统的参数校准有极大的影响,因此在这些环境里长期工作的系统不能完全依靠传感器的出厂校准。由于某些参数的可观性取决于部件的运动,在设备初始化时使用短期的数据片段可能效果并不好。当这样的系统又额外受限于能量约束时,使用大批量数据初始化的方法也不可行,需要仔细选择数据。

在本文中,作者提出了新的方法来对视觉惯导系统进行高效的校准。通过将校准问题转化为基于片段的优化问题,就可以在小量的具有高信息量的运动片段(Informative Motion Segments)数据里运行,因此计算负担就仅限于预定义的用来计算的片段数。同时,作者也提出了高效的理论信息选择方法来识别出这样的运动片段。在具有挑战性的数据集中,作者展示了该方法由于当前最先进的算法的性能,在极大降低计算负担的同时还能保持准确率。

主要贡献

1、提出高效的基于信息理论的方法来识别一段运动轨迹中最具信息量的片段。

2、提出基于片段的视觉惯导系统内参和外参自校准方法。

3、在详尽的评估中展示了该算法的性能。

算法流程

1、视觉惯导模型

惯性模型:

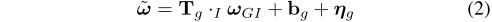

陀螺仪的测量值如式(2)所示,由真实值乘上一个误差校正参数矩阵,再加上高斯噪声项构成

加速度计的测量值如式(4)所示,与陀螺仪类似,真实加速度减去重力加速度后乘上变换矩阵和校正矩阵加上噪声项

相机模型:

令 I 表示从关键帧 k 观测到的3d地标,投影到相机图像平面的2d点 z 上,可得相机模型如式(6)所示。其中 fp(·) 表示投影函数,η 为高斯噪声过程。

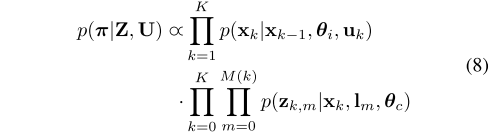

最大似然估计:

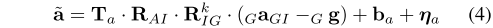

概率模型的因子图表示如图3,包含视觉惯导的关键帧状态 x,地标 I 和相机校准状态θc,IMU校准状态θi。似然函数如式(8)所示。

图3 校准问题的因子图表示

2、校准过程

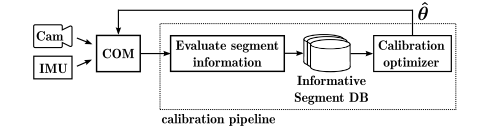

图4 系统总览

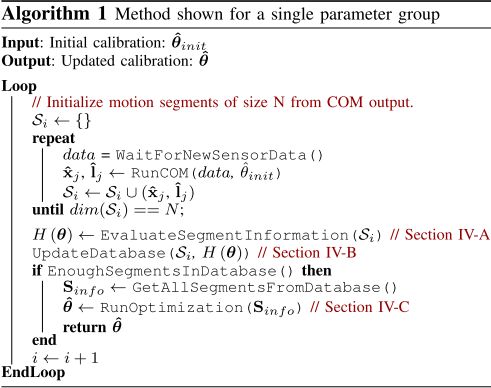

本文的算法设计用于与现有的视觉惯导SLAM平行运行,如图4所示,但是不局限于特定的SLAM实现。在作者的实现中 使用了COM(concurrent odometry and mapping)框架。使用基于信息理论的衡量方法来评估每个片段相对于校准参数的信息量,当收集到足够的片段时,会触发校准过程计算参数。算法的概览如下:

主要结果

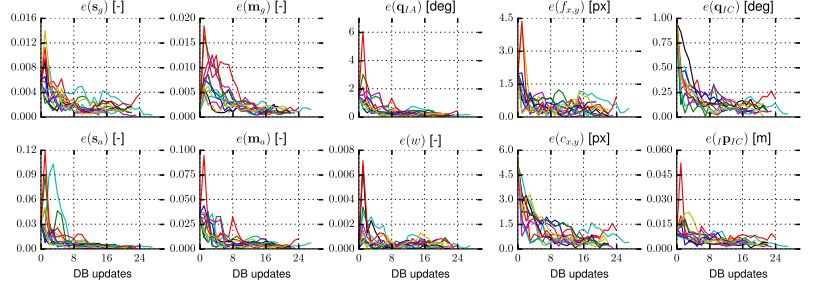

作者采集了15个数据集来评估该算法,数据集的采集使用了Google Tango开发套件,配备有 MEMS IMU和一个全局快门鱼眼相机。

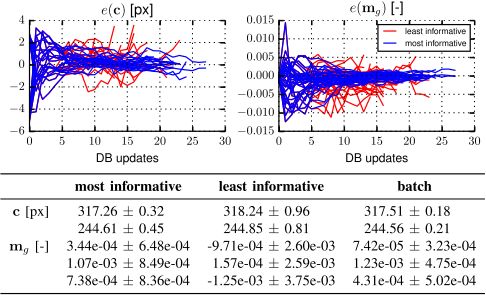

图8 校准参数的收敛性

图9 信息量对状态估计收敛性的影响

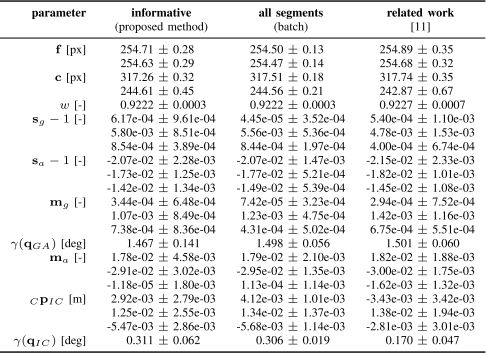

表1 三种算法在数据集上计算得到的校准参数对比

Abstract

Environmental conditions and external effects, such as shocks, have a significant impact on the calibration parameters of visual-inertial sensor systems. Thus longterm operation of these systems cannot fully rely on factory calibration. Since the observability of certain parameters is highly dependent on the motion of the device, using short data segments at device initialization may yield poor results. When such systems are additionally subject to energy constraints, it is also infeasible to use full-batch approaches on a big dataset and careful selection of the data is of high importance. In this paper, we present a novel approach for resource efficient self-calibration of visual-inertial sensor systems. This is achieved by casting the calibration as a segment-based optimization problem that can be run on a small subset of informative segments. Consequently, the computational burden is limited as only a predefined number of segments is used. We also propose an efficient information-theoretic selection to identify such informative motion segments. In evaluations on a challenging dataset, we show our approach to significantly outperform state-of-the-art in terms of computational burden while maintaining a comparable accuracy.

如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

点击阅读原文,即可获取本文下载链接。

欢迎来到泡泡论坛,这里有大牛为你解答关于SLAM的任何疑惑。

有想问的问题,或者想刷帖回答问题,泡泡论坛欢迎你!

泡泡网站:www.paopaorobot.org

泡泡论坛:http://paopaorobot.org/forums/

泡泡机器人SLAM的原创内容均由泡泡机器人的成员花费大量心血制作而成,希望大家珍惜我们的劳动成果,转载请务必注明出自【泡泡机器人SLAM】微信公众号,否则侵权必究!同时,我们也欢迎各位转载到自己的朋友圈,让更多的人能进入到SLAM这个领域中,让我们共同为推进中国的SLAM事业而努力!

商业合作及转载请联系liufuqiang_robot@hotmail.com