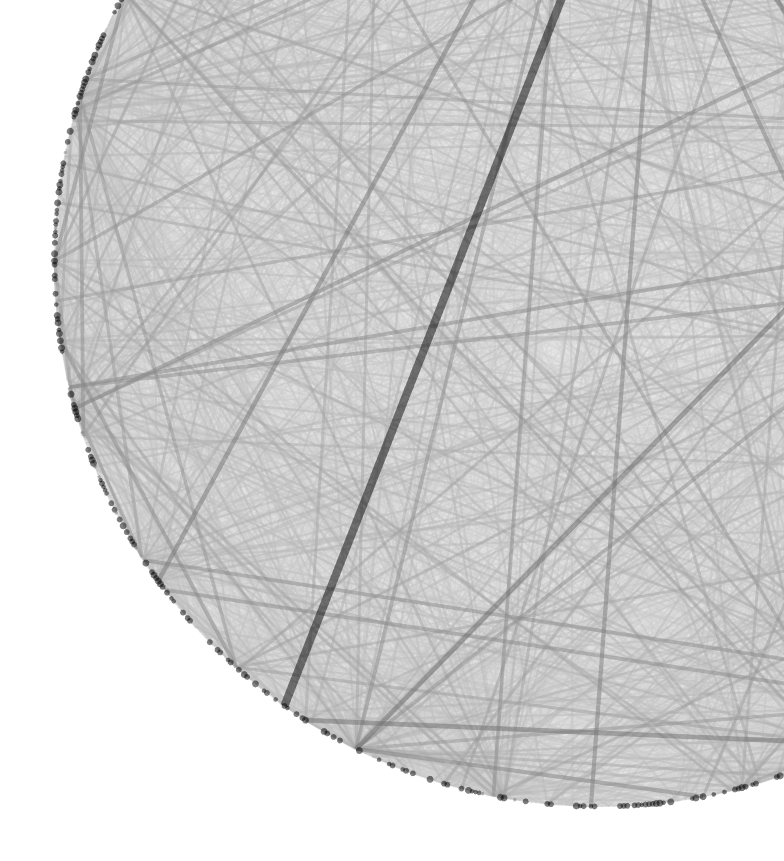

Graph signals are signals with an irregular structure that can be described by a graph. Graph neural networks (GNNs) are information processing architectures tailored to these graph signals and made of stacked layers that compose graph convolutional filters with nonlinear activation functions. Graph convolutions endow GNNs with invariance to permutations of the graph nodes' labels. In this paper, we consider the design of trainable nonlinear activation functions that take into consideration the structure of the graph. This is accomplished by using graph median filters and graph max filters, which mimic linear graph convolutions and are shown to retain the permutation invariance of GNNs. We also discuss modifications to the backpropagation algorithm necessary to train local activation functions. The advantages of localized activation function architectures are demonstrated in four numerical experiments: source localization on synthetic graphs, authorship attribution of 19th century novels, movie recommender systems and scientific article classification. In all cases, localized activation functions are shown to improve model capacity.

翻译:图形神经网络( GNNs) 是专为这些图形信号而定制的信息处理结构, 由堆叠层组成, 构成带有非线性激活功能的图形卷变过滤器。 图形结合了内嵌 GNNs, 与图形节点标签的变异不相容。 在本文中, 我们考虑了考虑到图表结构的可训练的非线性激活功能的设计。 这是通过使用图形中位过滤器和图形最大过滤器实现的。 这些过滤器模拟了线性图变形, 并显示保留了GNNS的变异性。 我们还讨论了对培训本地激活功能所需的反演算法的修改。 本地激活功能结构的优点在四个数字实验中表现出来: 合成图形的源本地化、 19世纪小说作者的作者归属、 电影推荐系统和科学文章分类。 在所有情况下, 本地化功能都显示为增强模型能力。