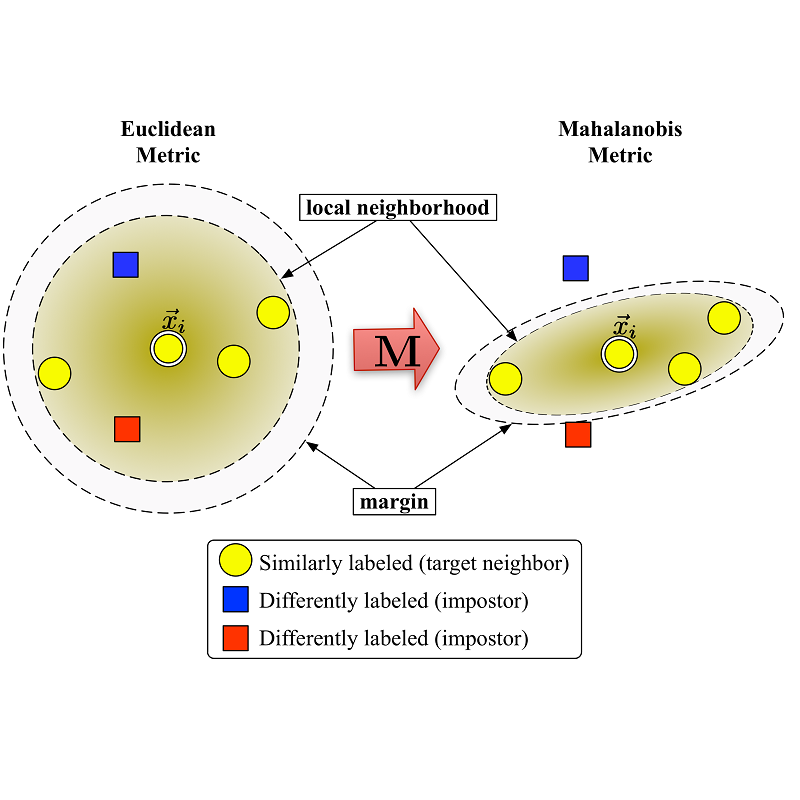

Deep metric learning aims to learn an embedding space, where semantically similar samples are close together and dissimilar ones are repelled against. To explore more hard and informative training signals for augmentation and generalization, recent methods focus on generating synthetic samples to boost metric learning losses. However, these methods just use the deterministic and class-independent generations (e.g., simple linear interpolation), which only can cover the limited part of distribution spaces around original samples. They have overlooked the wide characteristic changes of different classes and can not model abundant intra-class variations for generations. Therefore, generated samples not only lack rich semantics within the certain class, but also might be noisy signals to disturb training. In this paper, we propose a novel intra-class adaptive augmentation (IAA) framework for deep metric learning. We reasonably estimate intra-class variations for every class and generate adaptive synthetic samples to support hard samples mining and boost metric learning losses. Further, for most datasets that have a few samples within the class, we propose the neighbor correction to revise the inaccurate estimations, according to our correlation discovery where similar classes generally have similar variation distributions. Extensive experiments on five benchmarks show our method significantly improves and outperforms the state-of-the-art methods on retrieval performances by 3%-6%. Our code is available at https://github.com/darkpromise98/IAA

翻译:深度计量学习的目的是学习一个嵌入空间,在这个空间里,在语义上相似的样本彼此接近,不同样本被击退。为了探索更多硬性和信息化的强化和普及培训信号,最近的方法侧重于生成合成样本,以增加衡量学习损失的衡量尺度。然而,这些方法只是利用确定型和阶级独立的世代(例如简单的线性内插),这只能覆盖原始样本周围分配空间的有限部分。它们忽视了不同类别的广泛特征变化,不能为几代人模拟大量的类内变化。因此,所生成的样本不仅缺乏某些类内丰富的语义,而且可能成为干扰培训的噪音信号。在本文件中,我们提出了一个新的类内适应性增强(IAA)框架,用于深入的计量学习。我们合理估计了每个类内差异,并生成适应性合成样本,以支持硬性样本的开采和增强度性学习损失。此外,对于大多数在类内有少量样本的数据集,我们建议对邻居进行校正,以校正,根据我们的相关发现,在某些类内,通常具有类似的类变异性分布/排序的代码。我们现有的5个基准实验显示我们现有的方法。在状态上的系统上改进了5级内部分析方法。