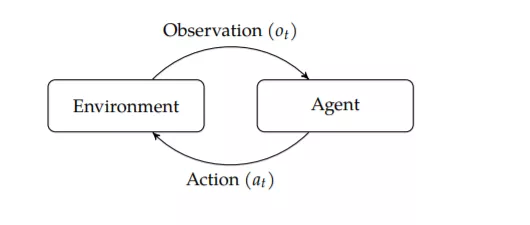

许多重要的问题都涉及不确定性下的决策,包括飞机碰撞避免、灾害管理和灾难反应。在设计自动化决策系统或决策支持系统时,在做出或推荐决策时考虑各种不确定性来源是很重要的。考虑到这些不确定性的来源并仔细平衡系统的多个目标是非常具有挑战性的。我们将从计算的角度讨论这些挑战,旨在提供决策模型和计算方法背后的理论。本章介绍了不确定性下的决策问题,提供了一些应用实例,并概述了可能的计算方法的空间。本章总结了各种学科对我们理解智能决策的贡献,并强调了潜在社会影响的领域。我们以本书其余部分的大纲结束。

https://github.com/sisl/algorithmsbook

成为VIP会员查看完整内容

相关内容

专知会员服务

121+阅读 · 2019年11月24日

Arxiv

0+阅读 · 2021年2月4日