人工智能正在缓慢地进入军事行动,该学科的进步推动了战斗空间中自主性的质和量的增加。这就意味着战斗人员将越来越多地与具有越来越先进自主能力的机器共存。随着机器从简单的工具跃升为合作的队友,人机编队将成为现代战争的中心。空军的忠诚僚机概念表明,人与机器之间的互动质量与机器的技术先进性一样,对成功的人机协作至关重要。了解如何确保人类和机器之间的信任将是至关重要的。人工智能和机器学习将使信任变得更加必要和难以实现,而与神经技术的融合可能会使这项任务进一步复杂化,带来新的挑战。

引言

人工智能(AI)正日益进入军事领域。虽然爱好者、否认者和实用主义者可能对人工智能将在多大程度上赋予战斗空间优势持不同意见,但它已经被用作分析工具、破坏者和力量倍增器(Rickli和Mantellassi,2023)。在乌克兰的冲突中,人工智能通过缩短传感器到射手的时间、分析截获的通信、传播情报以及在信息战中利用人工智能来优化目标定位周期,明显体现了这种趋势(Rickli, Mantellassi, and Juillard, 2022, p.22)。人工智能的进步不仅在数量上加速了战争的自主性和自动化,而且在质量上也加速了完全或部分由机器完成的一系列任务。随着人类和机器在战斗空间中的共存不断扩大,成功理解如何实现人类和机器之间的最佳合作是释放人工智能在军事行动中的全部潜力的关键。本文将重点讨论人工智能和人机协作对空军的新的重要性,在放大信任问题之前,特别关注 "忠诚的僚机 "概念。它还将讨论人机协作如何与其他新兴技术,特别是神经技术相融合,以重新定义未来的可能性。

人工智能与人机编队

人机编队(HMT)是将人类的判断与计算机的数据处理和响应能力相结合的行为(Motley,2022)。在军事领域,这意味着将人类、人工智能和机器人整合到合作、相互依赖和自主的系统中(Hein和Maquaire,2022)。人机互动在军事和民用领域已经很普遍,但这种传统的机器和人之间的互动模式并不一定构成一个 "团队"(Walliser等人,2019)。理解是什么让两者之间的互动成为一个团队,而不是机器只是一个工具,这一点至关重要。在人机团队中,机器在实现目标方面发挥着积极作用,它 "从信息中进行推断,从信息中获得新的见解,从过去的经验中学习,发现并提供相关信息以测试假设,帮助评估潜在解决方案的后果,辩论所提出的立场的有效性,提供证据和论据,提出解决方案并提供对非结构化问题的预测,另外还参与人类行为者的认知决策"(Bittner等人,2020,第3页)。在HMT中,机器不仅仅是一个在指示后完成指定功能的工具,而是一个能够与人类同行协调并支持实现目标的决策的队友(Motley, 2022)。

如果机器没有与人并肩合作,仅凭机器中存在的自主权不足以将人机互动定性为团队(Motely, 2022)。人机互动由三个要素组成:人、机器以及机器和人之间的互动和关系的性质(Chahal和Konaev,2021)。人工智能正在加速HMT的潜力和普遍性,特别是在军事行动中,人工智能驱动的自主性有了质的飞跃,正在投入使用的自主系统的数量也在增加。机器将不再是简单的工具,而是成为行动的组成部分,积极参与决策(Walliser等人,2019)。在这种新兴的背景下,需要成功地将人和机器配对,以提取两者的最大潜力,这为HMT奠定了基础。

人工智能的进步导致自主系统可以执行的各种功能有了质的提高,使这些系统以更关键和合作的方式与人类并肩作战。以人工智能为动力的自主性,越来越多地由机器学习(ML)驱动,正导致机器能够独立和更准确地完成的任务的复杂性增加。例如,Primer。AI正在使用不同的技术,最主要的是自然语言处理(NLP),融合多种情报输入(音频、视觉、文本),为乌克兰军队提供实时、自主生成的战斗空间情报图(Primer, 2022)。同样,游荡的弹药已经进入了战斗空间,依靠人工智能来识别和攻击目标。武器系统正越来越多地受益于私营部门开发的双重用途人工智能技术。例如,2022年5月,Deepmind发布了一种新的算法 "GATO",能够执行604项不同的任务(Deepmind, 2022)。

- 算法可以执行的功能越多,它在功能上与“人类”的等效性就越大,从而增加了 HMT 的潜力。

一个算法可以执行的功能越多,它在功能上就越等同于人类,增加了HMT的潜力。这些发展也推动了自主系统或具有某种程度自主性的系统数量的增加(Boulanin和Verbruggen,2017)。蜂群技术的出现--已经在实验中得到证明--将加速这一趋势(Xin等人,2022;Mehta,2017)。许多这些技术进步都是在私营部门开创的,是小国、非国家行为者和个人更容易获得的收益,与传统系统不同(Ashby等人,2020;Rickli,2020a)。随着机器人技术和自主权在数量和质量上的增加,战争的节奏将加快(Rickli,2019)。在算法战争中,人类在决策过程中保留有意义的作用的唯一途径将是通过整合和同步人类和机器的输入(Walsh, 2021)。空军必须在人和机器元素之间建立共生关系和互动。

虽然人工智能的成功和高潜力正在重塑HMT,但人工智能的固有局限性和相对脆性意味着机器必须继续与人类共存(Rickli,2020b)。假设战争的所有方面都将在不久的将来实现自动化,人工智能将取代所有--甚至大多数--作战人员的任务,这是不现实的。人工智能目前仍然是 "狭窄的",只能够在容易编纂或有更明确的规则和指标的活动中胜过人类(英国国防部,2018)。此外,这些狭窄的人工智能应用很容易受到对抗性攻击和数据偏差的影响,这可能导致惊人的失败(Scott-Hayward,2022)。虽然人工智能卓越的分析、数据处理和统计关联能力大大超过了人类,但后者将保持对战斗空间的认知优势,理解背景,依靠直觉,必要时打破规则,并以新颖的方式适应(Losey,2022)。HMT的优先级正是由于需要从机器算法与人类的结合中获得最佳结果,在这种情况下,每个人都可以发挥其优势(Jatho和Kroll,2022)。当正确的任务被分配给团队中正确的元素(人类或机器),并且两者之间的互动是高质量的,人机团队的表现就会大大超过人类和机器单独行动(Jatho和Kroll,2022)。

忠诚僚机的概念和信任

空军已经特别适应HMT的要求(Briant,2021)。采用人工智能和人与机器之间的互动越来越成为空中力量的核心(Briant, 2021)。世界上有几个备受瞩目的项目正在试验 "忠诚的僚机 "概念,该概念建议自主的无人驾驶飞机与有人驾驶的飞机一起协作。空军对HMT的需求来自于多个方面。首先,将人工智能、机器人和计算机整合到行动中,加速了数据的生产和收集,给作战人员带来了 "信息过载 "的风险(约翰逊等人,2014年)。操作复杂系统的飞行员需要高度集中和多任务处理,实时分析更多数据的范围有限。人工智能协助可以减轻一些这种负担。作为其 "先锋计划 "的一部分,美国空军正在开发 "Skyborg"--一个 "自主飞机组队架构",它将使诸如Kratos Valkyrie这样的无人机能够与有人驾驶的飞机组队飞行(美国空军,n.d)。这些无人机僚机将通过卸载一些数据分析任务、绘制目标和防空系统,以及为飞行员建议飞行走廊来提高飞行员的表现(Losey, 2022)。随着时间的推移,机载人工智能系统将能够向飞行员建议适当的行动方案。第二,美国的近邻对手,如中国,已经大量投资于发展反介入/区域拒止(A2/AD)能力,使作战环境变得非常有争议和致命(Grynkewich, 2017)。为了在这些高度竞争的环境中提高生存能力--考虑到蜂群技术的出现--忠诚的僚机可以被大量用于穿透和饱和对手的防御,充当诱饵,或提供动能效应(Perret,2021)。

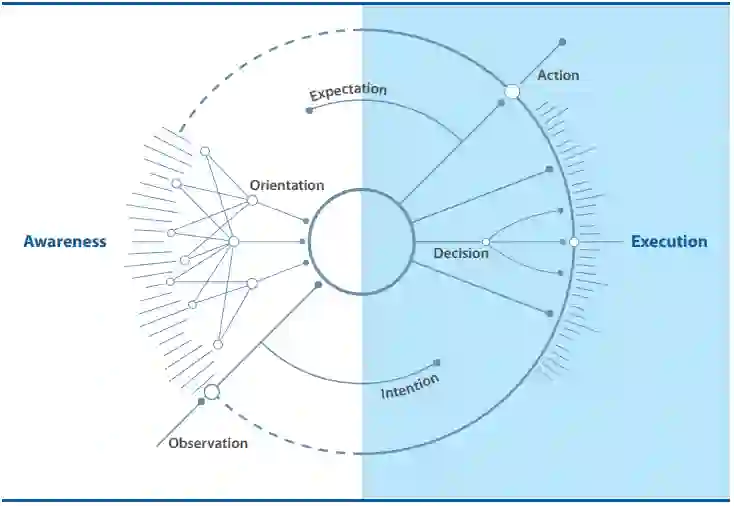

无数的挑战出现了,使为忠诚的僚机实现有效的HMT的目标变得复杂,而这些挑战并非都是技术性的。多种因素影响着HMT的互动质量,其中一些因素在图9.1中得到了说明。许多关于HMT的研究重点并不完全在技术能力和特性上,而是在人和机器之间的关系及其互动的性质和质量上。有效的HMT只是部分地依赖于人工智能的先进性,但在很大程度上取决于互动的质量。人们常常把它与人与人之间的团队相提并论。团队的有效性不是简单的单独成员能力和投入的总和,实际上取决于通过团队流程和团队工作成功地整合和协调个人努力(Funke等人,2022)。在HMT中,人类必须了解1)其角色,2)人工智能系统,3)如何与人工智能系统/队友互动,以及4)如何与其他人类队友互动(Puscas,2022)。

图 9.1:影响人机交互质量的因素

信任是HMT中的一个重要元素,但也是一个高度复杂的概念,有许多影响它的变量,如人口、地理位置、背景和其他多种因素(Chahal and Konaev, 2021)。Davis、Mayer和Schoorman将信任定义为 "一方愿意受到另一方行动的影响,因为他们期望另一方会采取对信任者很重要的特定行动,而不考虑监督或控制该另一方的能力"(1995)。关于支配人与人之间信任的变量和动力是否与影响人机信任的变量和动力相同,目前还没有定论(Celaya and Yeung, 2019)。本文将把信任视为 "个人对技术结论的可靠性及其完成既定目标的能力的信心"。(Chahal and Konaev, 2021)。正如英国国防部所指出的,人工智能系统不仅会受到可以做什么的限制,而且还会受到 "行为者信任他们的机器会做什么 "的限制(英国国防部,2018)。事实上,如果没有信任,人工智能将无法发挥其全部潜力,因为它的使用可能仅限于低风险的情况,而不是它可以提供真正的优势(Motley, 2022)。空军面临的挑战涉及到如何加强对人工智能的信任,从质量上增强人机关系。培训和用户界面的特点是提高对人工智能的信任和改善人机关系的核心考虑。

对人工智能系统的信任可以受到机械理解、系统可预测性、熟悉度和背景的影响(英国国防部,2018,第48页)。这些因素可以--至少是部分地--通过适当的培训来灌输对人工智能系统的信心和理解,以及通过用户友好的界面,通过提高熟悉度和可预测感来控制机器(Puscas, 2022)。然而,人工智能驱动的自主性的增加和ML作用的扩大意味着适当的培训和用户界面将同时变得更加复杂和具有挑战性,但也更加必要--但所有这些都会对信任产生不利影响(Puscas,2022)。人工智能的 "黑箱 "问题阻碍了可理解性、可解释性和可预测性,从而降低了信任度,而这种信任度只会随着下放给机器的自主权程度而增加(Michel,2020)。随着ML算法随着时间的推移而学习,飞行员/人类队友必须知道机器如何变化,它正在学习什么,以及这将如何影响其结果。因此,自动化的复杂性使得持续培训成为首要任务,但也更加复杂。同样地,界面的可用性变得更加重要,但同时也更加复杂。随着机器队友提供更多的自主权和它的算法过程的复杂化,它的输出在解释和沟通上也更具挑战性(Puscas 2022)。这种复杂性反过来可能会导致对系统的信任度降低。

- 随着ML算法随着时间的推移而学习,飞行员/人类队友必须知道机器如何变化,它在学习什么,以及这将如何影响其结果。因此,自动化的复杂性使得持续训练成为首要任务,但也更加复杂。

缺乏信任会影响HMT,降低人机团队的效率和潜力,从而降低其作战使用的概率。然而,对机器的过度信任也会对HMT产生负面影响。(Scharre, 2018; Puscas, 2022)。事实上,系统自主性的提高会导致 "自动化难题",即用户警觉性的丧失与系统增强的自动化和感知的可靠性成正比(Puscas,2022)。在这个意义上,机器的复杂性既可以减少信任,也可以将其增加到一个过度的水平。因此,军事操作人员需要对他们操作或监督的自主系统抱有健康的怀疑态度,这就需要有能力准确评估系统的局限性(Scharre, 2018, p.144)。这再次强调了适当培训的重要性,以获得对系统的理解,以免它 "因忽视而变得完全自主"(Puscas, 2022)。2003年,涉及美国 "爱国者系统 "的一系列事件,一个人在回路中的防空系统,导致自相残杀,归因于过度信任和不适当的培训,这使得该系统事实上完全自主(Scharre, 2018)。

神经科技的融合

任何单独的新兴技术的兴起都不会发生在真空中,独立于其他技术创新。因此,新兴技术组之间的融合需要仔细关注,以预测这些技术之间不可预测的互动所带来的未来挑战(Rickli和Mantellassi,2022)。目前,人类的互动总是通过界面(如屏幕)进行的,这意味着其效率有一些限制。采用忠诚的僚机的操作演示中,操作员用手持平板电脑指挥机器队友(Trevithick, 2021)。消除对界面的需求的一个方法是,使用一套允许大脑和机器之间双向互动的技术,直接将机器与人脑连接起来。人工智能和神经技术领域--寻求将技术部件连接到神经系统的科学领域--之间正在进行的融合可能会在未来实现最佳的人机互动(Rickli,2020c)。

人与机器之间的关系质量对人机交互至关重要,并且受到界面特征的影响。使用外部界面(屏幕、平板电脑、计算机)来监督或以其他方式与机器或半自主代理接触,可能对认知要求很高,导致丧失警觉性和自满情绪(Puscas,2022)。神经技术的进步可能会解决飞行员与外部链接(如屏幕或显示器)互动的需要,以查看、沟通并向机器传输信息。脑机接口(BCI)将把忠诚的僚机控制无缝整合到飞行员的认知过程中,以减少认知过载,加速观察、定向、决定和行动(OODA)循环,如下图9.2所示,并消除设计接口的复杂任务。BCI可以 "促进思维速度的多任务处理",并允许飞行员 "与智能决策辅助工具对接 "和多车辆合作(Bartels等人,2020)。DARPA正在努力实现BCI的使用,它模拟了狗斗,其中算法 "进入 "对手的OODA循环,通过更快的决策击败人类对手(Tegler,2020)。

图 9.2:OODA 循环的仪表板样式表示

技术的融合融合了每项技术的特质,加速了它们的发展,并导致了以前不可能的新颖创新。然而,融合也使与单个技术相关的风险转移到另一个技术,有时会带来全新的、不可预测的挑战。因此,虽然BCI等神经技术可以及时实现最佳的HMT,但它们也带来了新的和更复杂的风险。对于神经技术而言,这些风险包括数据隐私和认知及精神完整性的伦理困境、大脑操纵和发动认知战争的新途径,以及前所未有的监控能力等(Rickli和Ienca,2021)。

结论

人工智能的进步导致军事行动中具有自主能力的人工智能驱动的机器在质量和数量上的增加。然而,今天的人工智能相对脆弱,这意味着作战人员将在战斗空间与机器共存,越来越多地成为队友。空军必须投资于可消耗的、无人驾驶的能力,如忠诚的僚机,以克服信息负担、认知过载和高度竞争的空域中的低生存能力等挑战。HMT的挑战是未来空中力量能力的中心。优化人与机器之间的关系,而不仅仅是驾驶这些忠诚僚机的算法,是至关重要的。确保飞行员对人工智能驱动的自主系统的运作和性能有信任,并对其固有的局限性有一个强有力的理解是至关重要的。在解决这些问题时,培训和用户界面的重要性非常突出。了解自主性如何影响信任并影响飞行员和他们的机器队友之间的关系,将对推进HMT具有决定性意义。神经技术,特别是BCI,是一个新兴的领域,有可能与忠诚的僚机概念相融合,并使人与机器之间的联系更加优化。通过预见性地预测BCI、忠诚僚机和人工智能之间的融合所带来的新挑战,对于指导未来空中力量的发展至关重要。