深度神经网络在拥有大量数据集和足够的计算资源的情况下能够取得巨大的成功。然而,他们快速学习新概念的能力相当有限。元学习是解决这一问题的一种方法,通过使网络学会如何学习。令人兴奋的深度元学习领域正在高速发展,但缺乏对当前技术的统一、深刻的概述。这项工作就是这样。在为读者提供理论基础之后,我们研究和总结了主要的方法,这些方法被分为i)度量;ii)模型;和iii)基于优化的技术。此外,我们确定了主要的开放挑战,如在异构基准上的性能评估,以及元学习计算成本的降低。

摘要:

近年来,深度学习技术在各种任务上取得了显著的成功,包括游戏(Mnih et al., 2013; Silver et al., 2016),图像识别(Krizhevsky et al., 2012; He et al., 2015)和机器翻译(Wu et al., 2016)。尽管取得了这些进展,但仍有大量的挑战有待解决,例如实现良好性能所需的大量数据和训练。这些要求严重限制了深度神经网络快速学习新概念的能力,这是人类智能的定义方面之一(Jankowski等人,2011;(Lake等,2017)。

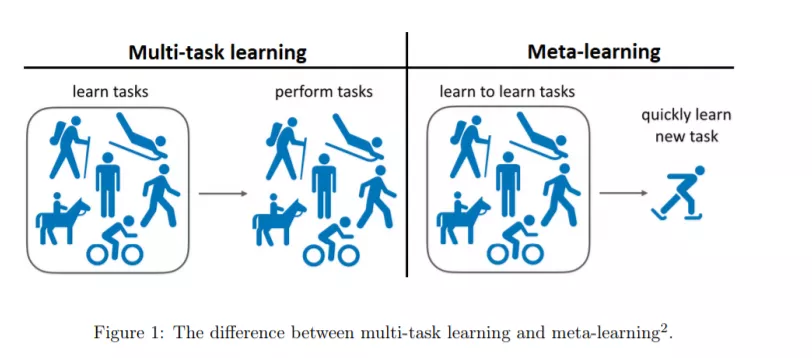

元学习被认为是克服这一挑战的一种策略(Naik and Mammone, 1992; Schmidhuber, 1987; Thrun, 1998)。其关键思想是元学习主体随着时间的推移提高自己的学习能力,或者等价地说,学会学习。学习过程主要与任务(一组观察)有关,并且发生在两个不同的层次上:内部和外部。在内部层,一个新的任务被提出,代理试图快速地从训练观察中学习相关的概念。这种快速的适应是通过在外部层次的早期任务中积累的知识来促进的。因此,内部层关注的是单个任务,而外部层关注的是多个任务。

从历史上看,元学习这个术语的使用范围很广。从最广泛的意义上说,它概括了所有利用之前的学习经验以更快地学习新任务的系统(Vanschoren, 2018)。这个广泛的概念包括更传统的机器学习算法选择和hyperparameter优化技术(Brazdil et al ., 2008)。然而,在这项工作中,我们专注于元学习领域的一个子集,该领域开发元学习程序来学习(深度)神经网络的良好诱导偏差。1从今以后,我们使用术语深元学习指元学习的领域。

深度元学习领域正在快速发展,但它缺乏一个连贯、统一的概述,无法提供对关键技术的详细洞察。Vanschoren(2018)对元学习技术进行了调查,其中元学习被广泛使用,限制了对深度元学习技术的描述。此外,在调查发表后,深度元学习领域也出现了许多令人兴奋的发展。Hospedales等人(2020)最近的一项调查采用了与我们相同的深度元学习概念,但目标是一个广泛的概述,而忽略了各种技术的技术细节。

我们试图通过提供当代深度元学习技术的详细解释来填补这一空白,使用统一的符号。此外,我们确定了当前的挑战和未来工作的方向。更具体地说,我们覆盖了监督和强化学习领域的现代技术,已经实现了最先进的性能,在该领域获得了普及,并提出了新的想法。由于MAML (Finn et al., 2017)和相关技术对该领域的影响,我们给予了格外的关注。本研究可作为深度元学习领域的系统性介绍,并可作为该领域资深研究人员的参考资料。在整个过程中,我们将采用Vinyals(2017)所使用的分类法,该分类法确定了三种深度元学习方法:i)度量、ii)模型和iii)基于优化的元学习技术。