元学习

·

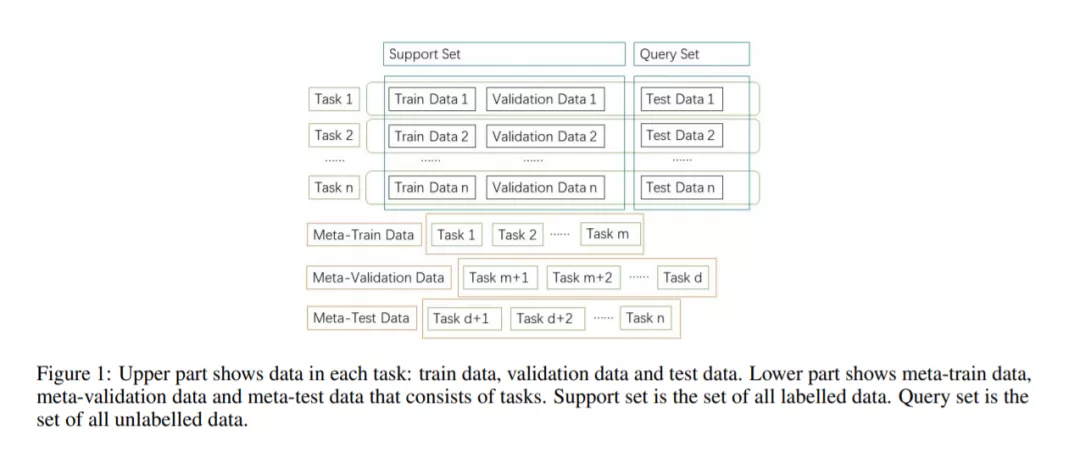

本文综述了元学习在图像分类、自然语言处理和机器人技术等领域的应用。与深度学习不同,元学习使用较少的样本数据集,并考虑进一步改进模型泛化以获得更高的预测精度。我们将元学习模型归纳为三类: 黑箱适应模型、基于相似度的方法模型和元学习过程模型。最近的应用集中在将元学习与贝叶斯深度学习和强化学习相结合,以提供可行的集成问题解决方案。介绍了元学习方法的性能比较,并讨论了今后的研究方向。

成为VIP会员查看完整内容

相关内容

专知会员服务

140+阅读 · 2020年7月10日

专知会员服务

80+阅读 · 2020年3月5日

专知会员服务

48+阅读 · 2019年12月24日

Arxiv

20+阅读 · 2020年3月10日