现代工程应用正在推动定制有多功能特性的异质材料的需求。通常,这些性质取决于微观结构。近年来,人们一直将注意力集中在对微结构敏感的设计上。这里所说的设计就是确定能产生所需性能的定制微结构。但如何利用机器学习建立这一设计的途径尚待深入研究。

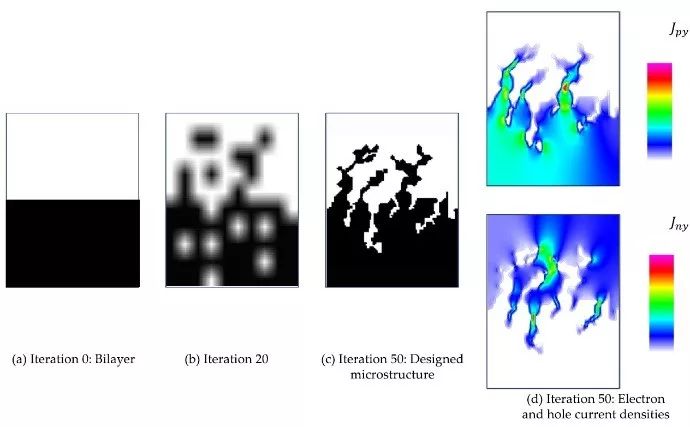

来自美国爱荷华州立大学机械工程系的Soumik Sarkar教授和Baskar Ganapathysubramanian教授等,训练了一种形态分类器,可将有机光伏形态和短路电流关联到一起。

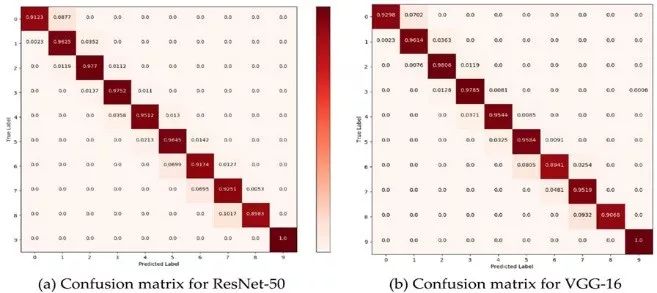

他们测试了几种深度和宽度不同的学习框架,这些学习框架可以从给定的一组形态及其标签中学习,最后的结果发现该学习框架具有很高的准确性和F1得分。

为了区分这些同样表现良好的模型并对它们进行排序,作者使用了两个额外的附加度量。

首先是揭示习得的结构-性质关系的概括性。

他们确定了网络架构,可以用可用的数据集概括地图,并根据“将未看到的形态投射到已学习过的分布上”的能力进行量化,并做出了良好的预测。

其次是可解释性。

这是理解工程系统行为的相当重要的指标。

他们引入了一种称为DLSP(结构属性查询深度学习)的方法,用于从数据中学习结构-性能之间的构效关系。

作者认为这种方法可广泛应用于各种对微结构敏感的设计问题。

该文近期发表于npj Computational Materials 5: 95 (2019),英文标题与摘要如下。

Interpretable deep learning for guided microstructure-property explorations in photovoltaics

Balaji Sesha Sarath Pokuri, Sambuddha Ghosal, Apurva Kokate, Soumik Sarkar & Baskar Ganapathysubramanian

The microstructure determines the photovoltaic performance of a thin film organic semiconductor film. The relationship between microstructure and performance is usually highly non-linear and expensive to evaluate, thus making microstructure optimization challenging. Here, we show a data-driven approach for mapping the microstructure to photovoltaic performance using deep convolutional neural networks. We characterize this approach in terms of two critical metrics, its generalizability (has it learnt a reasonable map?), and its intepretability (can it produce meaningful microstructure characteristics that influence its prediction?). A surrogate model that exhibits these two features of generalizability and intepretability is particularly useful for subsequent design exploration. We illustrate this by using the surrogate model for both manual exploration (that verifies known domain insight) as well as automated microstructure optimization. We envision such approaches to be widely applicable to a wide variety of microstructure-sensitive design problems.

![]()

《npj 计算材料学》是在线出版、完全开放获取的国际学术期刊。发表结合计算模拟与设计的材料学一流的研究成果。本刊由中国科学院上海硅酸盐研究所与英国自然出版集团(Nature Publishing Group,NPG)以伙伴关系合作出版。

本文经授权转载自“知社学术圈”,如需转载请联系原作者。