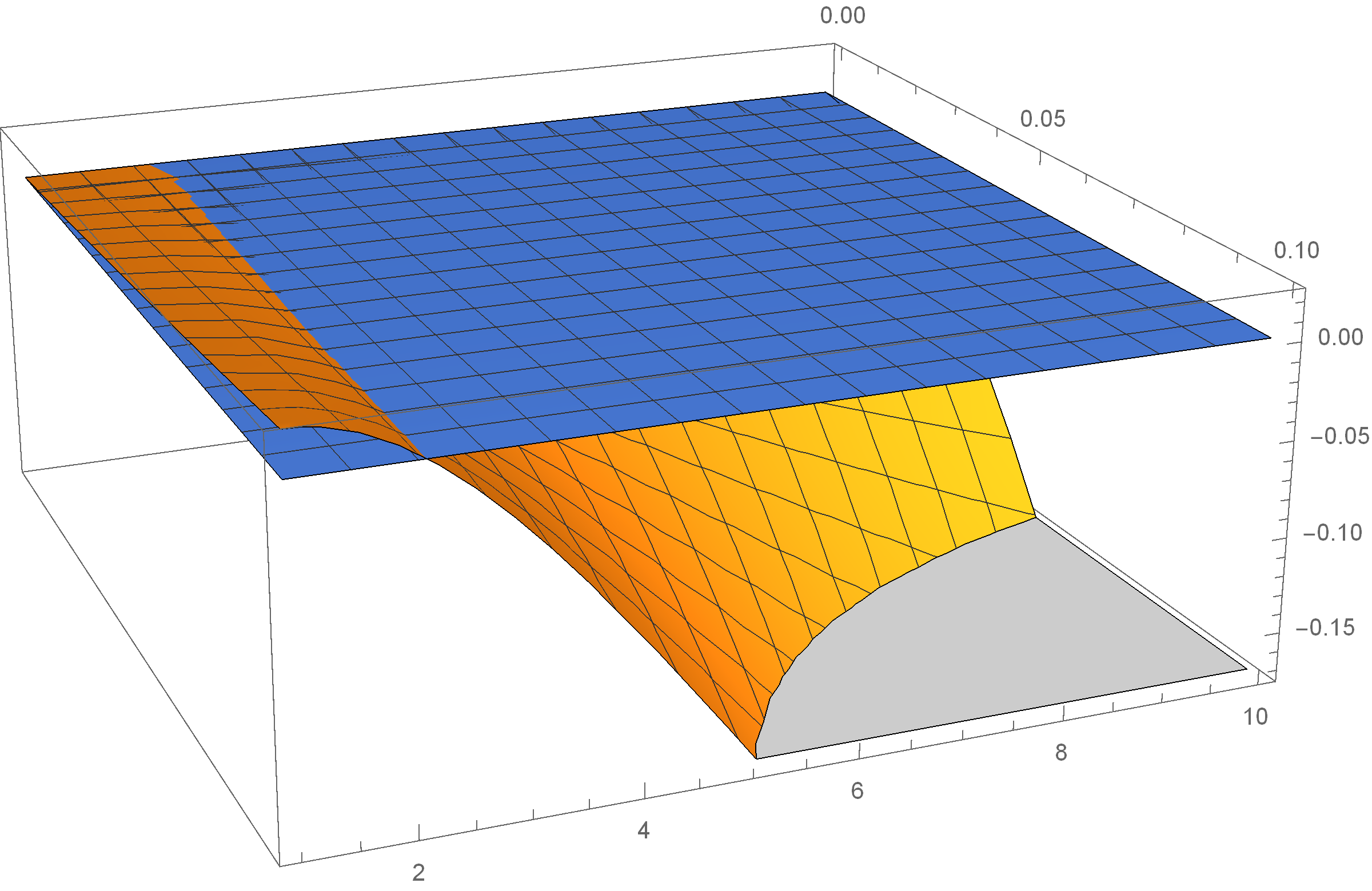

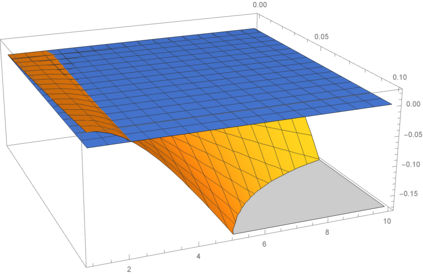

We study evolutionary algorithms in a dynamic setting, where for each generation a different fitness function is chosen, and selection is performed with respect to the current fitness function. Specifically, we consider Dynamic BinVal, in which the fitness functions for each generation is given by the linear function BinVal, but in each generation the order of bits is randomly permuted. For the (1+1)-EA it was known that there is an efficiency threshold $c_0$ for the mutation parameter, at which the runtime switches from quasilinear to exponential. A previous empirical evidence suggested that for larger population size $\mu$, the threshold may increase. We prove that this is at least the case in an $\varepsilon$-neighborhood around the optimum: the threshold of the (\mu+1)-EA becomes arbitrarily large if the $\mu$ is chosen large enough. However, the most surprising result is obtained by a second order analysis for $\mu=2$: the threshold INcreases with increasing proximity to the optimum. In particular, the hardest region for optimization is NOT around the optimum.

翻译:我们在一个动态环境中研究进化算法,对每一代人选择不同的健身功能,并且根据当前的健身功能进行选择。具体地说,我们考虑动态BinVal,其中每一代人的健身功能由线性函数BinVal给定,但每一代的位子顺序随机变换。对于(1+1)-EA,已知突变参数有一个效率阈值 $_0,即从准线性转换到指数化的运行时间开关。以前的实验证据表明,对于较大的人口规模,门槛值可能会增加。我们至少证明,在最理想的周围是$\varepsilon-neneborhood:如果选择 $\ +1-EA值足够大,其阈值(\ mu+1)-EA值会变得任意大。然而,通过对美元=2美元的第二次订单分析,得出了最令人惊讶的结果:最接近最佳的门槛值是日益接近最佳的门槛值。特别是最难的优化区域。