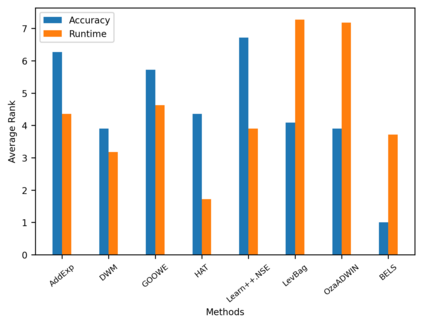

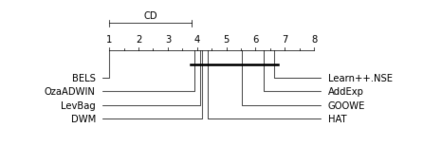

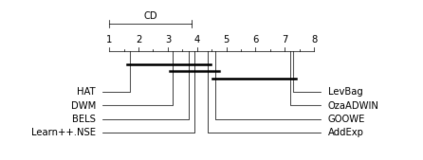

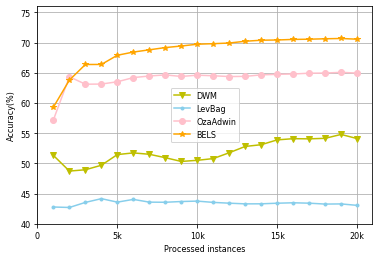

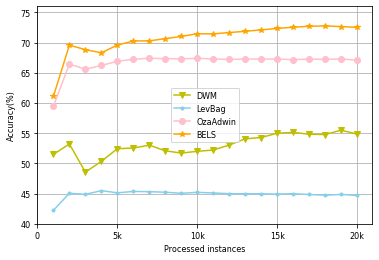

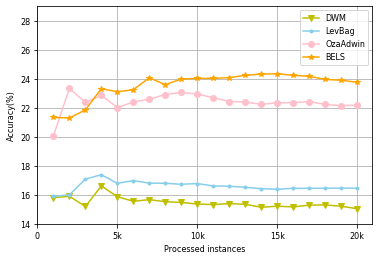

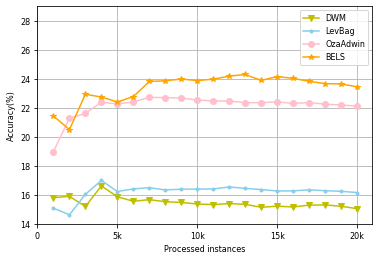

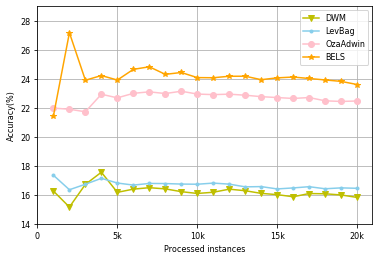

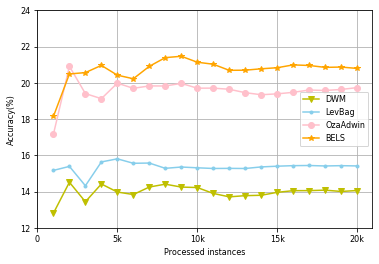

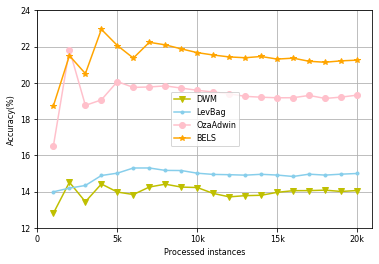

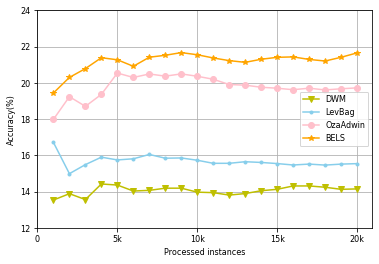

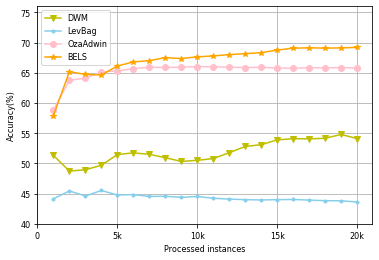

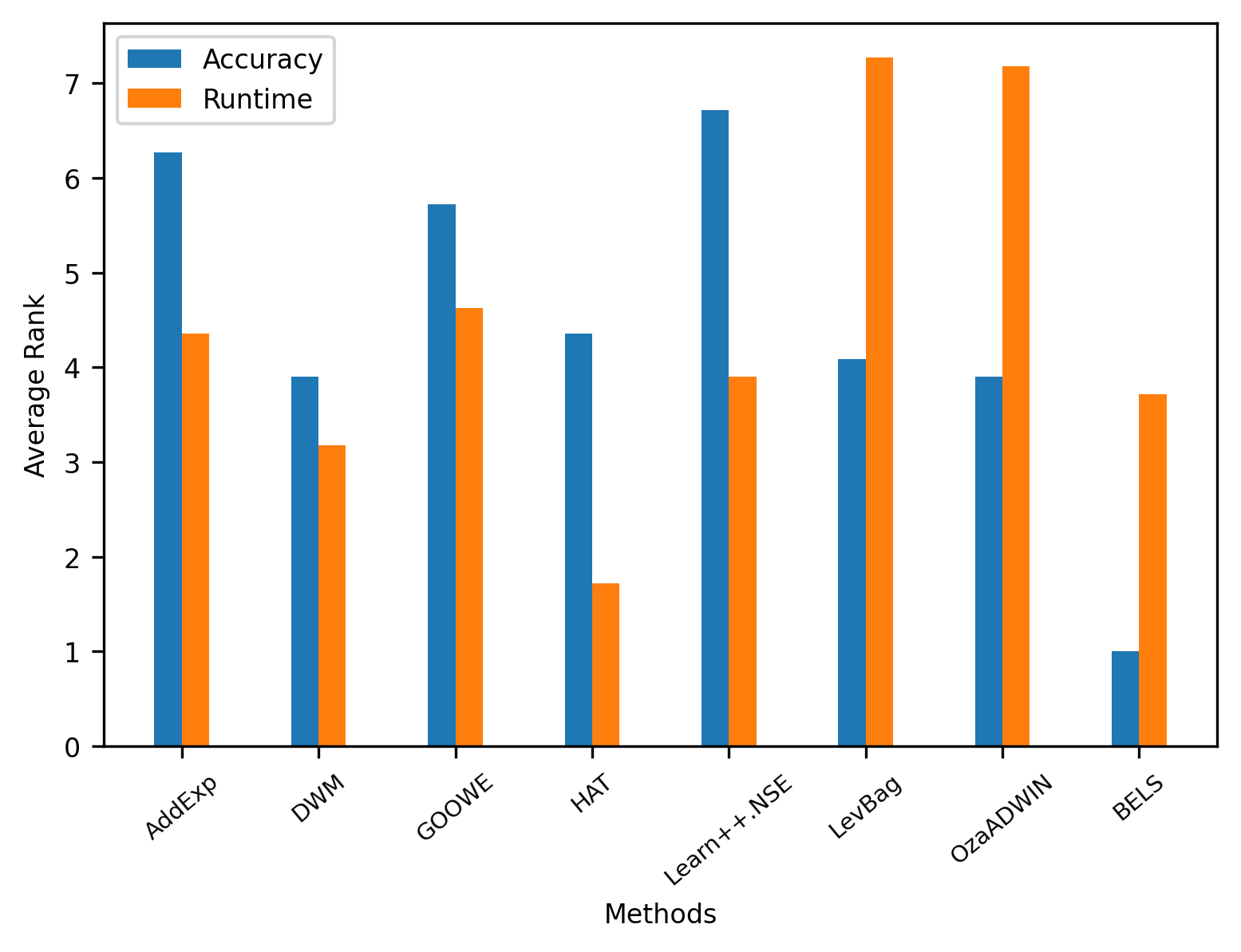

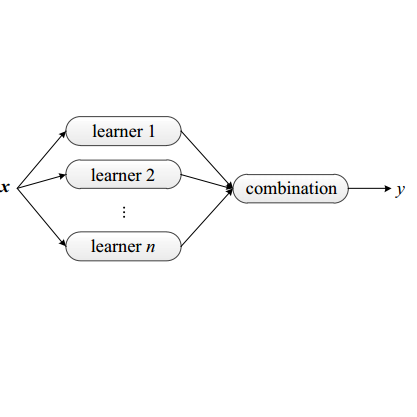

Data stream classification has become a major research topic due to the increase in temporal data. One of the biggest hurdles of data stream classification is the development of algorithms that deal with evolving data, also known as concept drifts. As data changes over time, static prediction models lose their validity. Adapting to concept drifts provides more robust and better performing models. The Broad Learning System (BLS) is an effective broad neural architecture recently developed for incremental learning. BLS cannot provide instant response since it requires huge data chunks and is unable to handle concept drifts. We propose a Broad Ensemble Learning System (BELS) for stream classification with concept drift. BELS uses a novel updating method that greatly improves best-in-class model accuracy. It employs a dynamic output ensemble layer to address the limitations of BLS. We present its mathematical derivation, provide comprehensive experiments with 11 datasets that demonstrate the adaptability of our model, including a comparison of our model with BLS, and provide parameter and robustness analysis on several drifting streams, showing that it statistically significantly outperforms seven state-of-the-art baselines. We show that our proposed method improves on average 44% compared to BLS, and 29% compared to other competitive baselines.

翻译:由于时间数据增加,数据流分类已成为一个重要的研究课题。数据流分类的最大障碍之一是发展处理不断演变的数据的算法,也称为概念漂移。随着数据随时间的变化而变化,静态预测模型失去效力。适应概念漂移提供了更有力和更好的功能模型。广学系统(BLS)是最近为渐进学习而开发的一个有效的广泛的神经结构。BLS无法提供即时反应,因为它需要巨大的数据块,并且无法处理概念漂移。我们建议了用于概念漂移的流分类的宽广组合学习系统(BELS) 。BELS使用了一种新颖的更新方法,大大改进了最高级模型的准确性。随着时间的变化,静态预测模型将失去效力。适应概念漂移模型的适应性提供了更强和更好的模型。我们介绍了其数学衍生的11个数据集,展示了我们模型的适应性,包括将模型与BLS作比较,并对若干漂流流流流提供了参数和坚固性分析,显示它在统计上大大超出7个状态的基线。BLS使用了新的更新方法,我们提议的44比其他基线的竞争性方法。我们改进了44比BLS。我们提议的平均值。