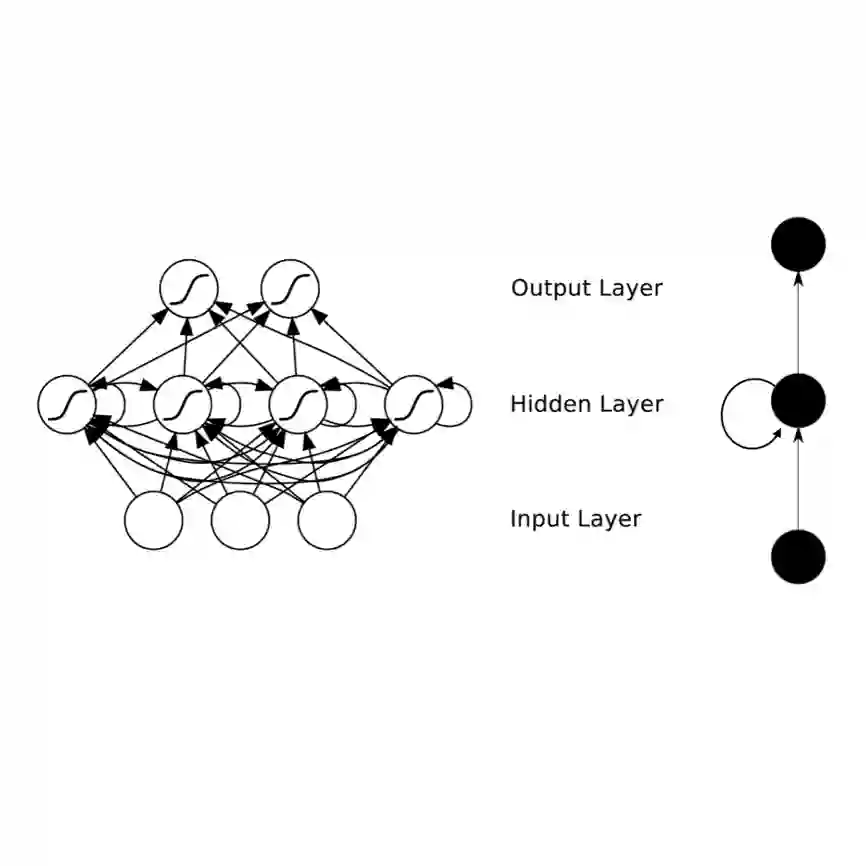

Reconstructing magnetic resonance (MR) images from undersampled data is a challenging problem due to various artifacts introduced by the under-sampling operation. Recent deep learning-based methods for MR image reconstruction usually leverage a generic auto-encoder architecture which captures low-level features at the initial layers and high?level features at the deeper layers. Such networks focus much on global features which may not be optimal to reconstruct the fully-sampled image. In this paper, we propose an Over-and-Under Complete Convolu?tional Recurrent Neural Network (OUCR), which consists of an overcomplete and an undercomplete Convolutional Recurrent Neural Network(CRNN). The overcomplete branch gives special attention in learning local structures by restraining the receptive field of the network. Combining it with the undercomplete branch leads to a network which focuses more on low-level features without losing out on the global structures. Extensive experiments on two datasets demonstrate that the proposed method achieves significant improvements over the compressed sensing and popular deep learning-based methods with less number of trainable parameters. Our code is available at https://github.com/guopengf/OUCR.

翻译:由于抽样不足的作业引进了各种文物,因此从未得到充分取样作业引入了各种手工艺品,重塑磁共振图像是一个具有挑战性的问题。最近为MR图像重建采用的深层学习方法通常会利用一种通用的自动编码结构,在初始层和深层层中捕捉低层次的特征?这种网络主要侧重于全球特征,而这些特征可能不是重建完整取样图像的最佳方法。在本文件中,我们提议建立一个超低全面挥发?经常神经网络(OUCR),它由过度和不完全的共振常态神经网络(CRNN)组成。过分的分支通过限制网络的可容纳场,在学习当地结构方面给予特别关注。将其与不完整分支结合起来,导致一个网络,在不失去全球结构的情况下,更多地侧重于低层次特征。对两个数据集进行广泛的实验表明,拟议的方法在压缩感测和广受欢迎的深层次学习方法方面,取得了显著的改进,培训参数较少。我们的代码可在 https://gimbubreb./comgg/trobex查阅。