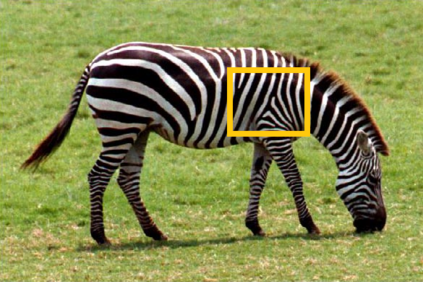

This paper studies the single image super-resolution problem using adder neural networks (AdderNet). Compared with convolutional neural networks, AdderNet utilizing additions to calculate the output features thus avoid massive energy consumptions of conventional multiplications. However, it is very hard to directly inherit the existing success of AdderNet on large-scale image classification to the image super-resolution task due to the different calculation paradigm. Specifically, the adder operation cannot easily learn the identity mapping, which is essential for image processing tasks. In addition, the functionality of high-pass filters cannot be ensured by AdderNet. To this end, we thoroughly analyze the relationship between an adder operation and the identity mapping and insert shortcuts to enhance the performance of SR models using adder networks. Then, we develop a learnable power activation for adjusting the feature distribution and refining details. Experiments conducted on several benchmark models and datasets demonstrate that, our image super-resolution models using AdderNet can achieve comparable performance and visual quality to that of their CNN baselines with an about 2$\times$ reduction on the energy consumption.

翻译:本文使用添加器神经网络( AdderNet) 来研究单一图像超分辨率问题。 与进化神经网络相比, AdderNet使用添加器来计算输出特性, 从而避免常规倍增的大规模能量消耗。 然而, 很难直接继承 AdderNet 现有的成功, 即由于不同的计算模式, 将大规模图像分类为图像超分辨率任务。 具体地说, 添加器操作无法轻易地学习身份映像, 这对图像处理任务至关重要。 此外, 高级传感过滤器的功能无法由 AdderNet 来保证。 为此, 我们彻底分析添加器操作和身份映像仪之间的关系, 并插入捷径, 以提高使用添加器网络的 SR 模型的性能。 然后, 我们开发一个可学习的动力激活器, 以调整特性分布和精细化细节。 在几个基准模型和数据集上进行的实验表明, 我们使用 AdderNet 的图像超分辨率模型可以达到与CNN 基线的可比较性能和视觉质量, 约2\ times 减少能源消耗 美元 。