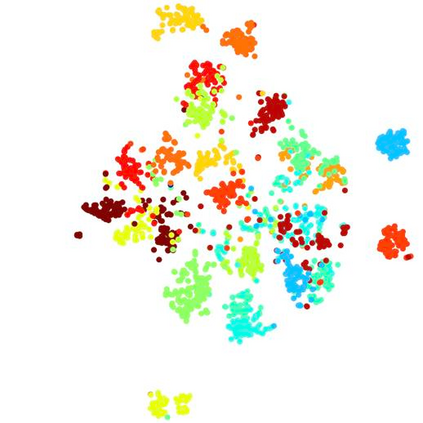

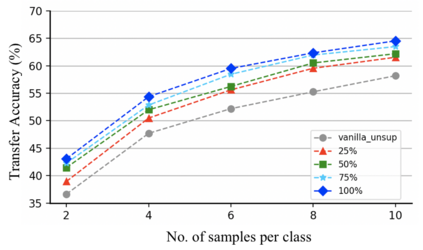

Unsupervised pretraining has achieved great success and many recent works have shown unsupervised pretraining can achieve comparable or even slightly better transfer performance than supervised pretraining on downstream target datasets. But in this paper, we find this conclusion may not hold when the target dataset has very few labeled samples for finetuning, \ie, few-label transfer. We analyze the possible reason from the clustering perspective: 1) The clustering quality of target samples is of great importance to few-label transfer; 2) Though contrastive learning is essential to learn how to cluster, its clustering quality is still inferior to supervised pretraining due to lack of label supervision. Based on the analysis, we interestingly discover that only involving some unlabeled target domain into the unsupervised pretraining can improve the clustering quality, subsequently reducing the transfer performance gap with supervised pretraining. This finding also motivates us to propose a new progressive few-label transfer algorithm for real applications, which aims to maximize the transfer performance under a limited annotation budget. To support our analysis and proposed method, we conduct extensive experiments on nine different target datasets. Experimental results show our proposed method can significantly boost the few-label transfer performance of unsupervised pretraining.

翻译:未经监督的预培训取得了巨大成功,许多近期工程显示,未经监督的预培训可以比下游目标数据集的监督前培训取得可比甚至稍好一些的转让性能。 但在本文件中,我们发现,当目标数据集的标签样本极少时,在微调、\ie、少数标签传输方面,这一结论可能无法维持。我们从组群角度分析可能的原因:(1) 目标样本的集群质量对少数标签的传输非常重要;(2) 尽管对比式学习对于学习如何分组至关重要,但由于缺乏标签监督,其集群质量仍然低于受监督的预培训。根据分析,我们饶有兴趣地发现,只有将某些未加标签的目标域纳入未经监督的预培训,才能提高集群质量,随后通过受监督的预培训缩小传输性能差距。这一发现还激励我们提出一个新的渐进式、少数标签的真应用程序转移性算法,目的是在有限的注解预算下最大限度地实现传输性能。为了支持我们的分析和拟议方法,我们只能在九个不同目标数据集上进行广泛的实验。实验结果显示,我们提议的方法可以大大提升前的少数标签性转移性。