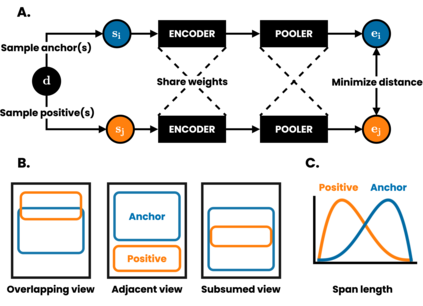

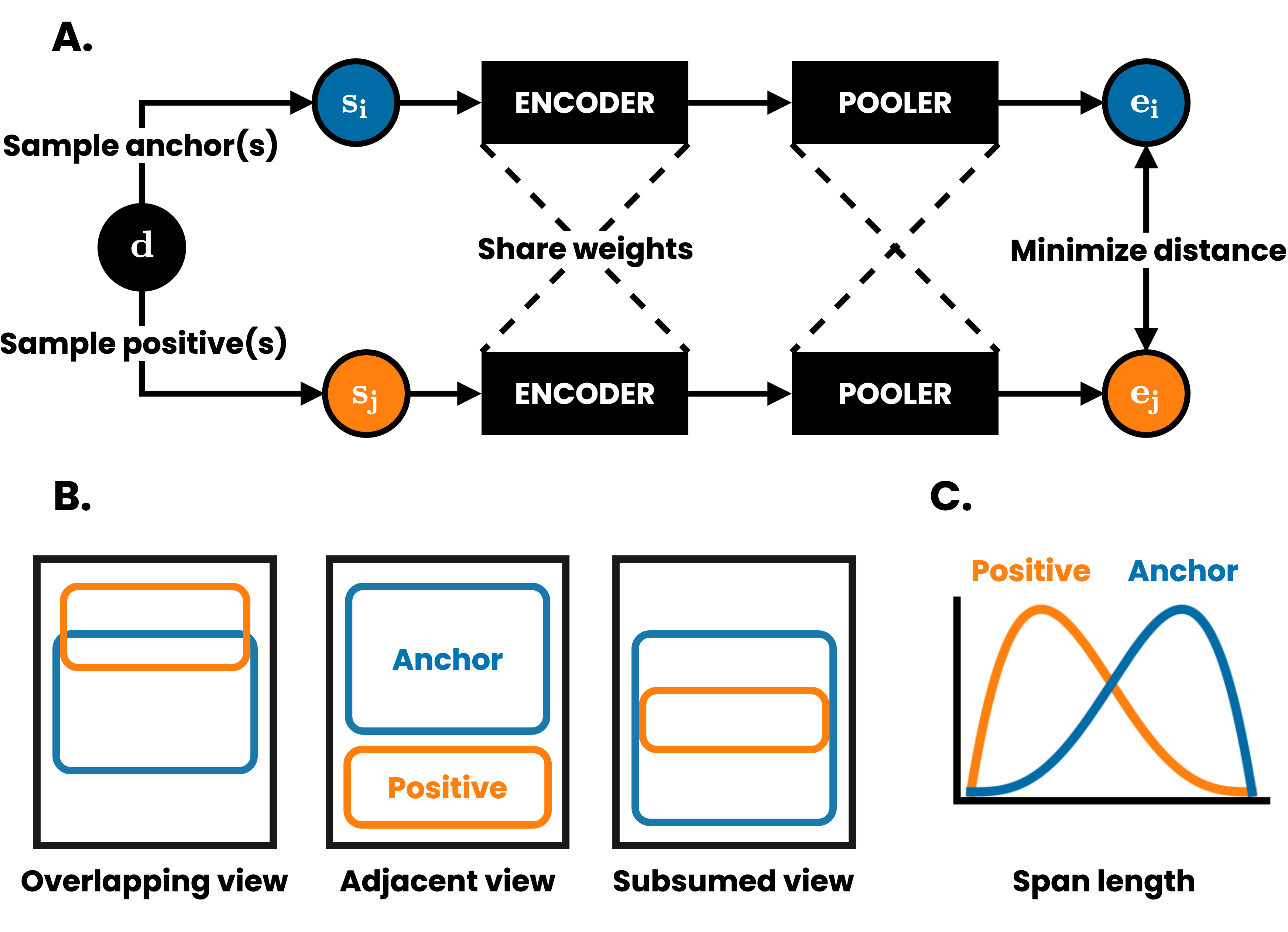

Sentence embeddings are an important component of many natural language processing (NLP) systems. Like word embeddings, sentence embeddings are typically learned on large text corpora and then transferred to various downstream tasks, such as clustering and retrieval. Unlike word embeddings, the highest performing solutions for learning sentence embeddings require labelled data, limiting their usefulness to languages and domains where labelled data is abundant. In this paper, we present DeCLUTR: Deep Contrastive Learning for Unsupervised Textual Representations. Inspired by recent advances in deep metric learning (DML), we carefully design a self-supervised objective for learning universal sentence embeddings that does not require labelled training data. When used to extend the pretraining of transformer-based language models, our approach closes the performance gap between unsupervised and supervised pretraining for universal sentence encoders. Importantly, our experiments suggest that the quality of the learned embeddings scale with both the number of trainable parameters and the amount of unlabelled training data. Our code and pretrained models are publicly available and can be easily adapted to new domains or used to embed unseen text.

翻译:句子嵌入是许多自然语言处理( NLP) 系统的重要组成部分。 和字嵌入一样, 句嵌入通常是在大型文本组合中学习, 然后被转移到各种下游任务, 如组合和检索。 与字嵌入不同, 学习句嵌入的最有效解决方案需要贴标签数据, 将其效用限制在标签数据丰富的语言和领域。 本文介绍了 DCLUTR: 用于不受监管的文本表达的深度差异学习 。 在深层次指标学习( DML) 的最新进展的启发下, 我们仔细设计了一个学习通用句嵌入的自监督目标, 不需要贴标签的培训数据。 当用于扩展基于变压器语言模型的预培训时, 我们的方法缩小了未监督和监管的通用句子编码师前培训之间的性差。 重要的是, 我们的实验表明, 学习的嵌入规模的质量与可训练参数的数量和未贴标签培训数据的数量一样。 我们的代码和预设的模型可以公开使用, 可以很容易地适应新的域, 或用于嵌入秘密文本 。