题目: Integrating Deep Learning with Logic Fusion for Information Extraction

摘要:

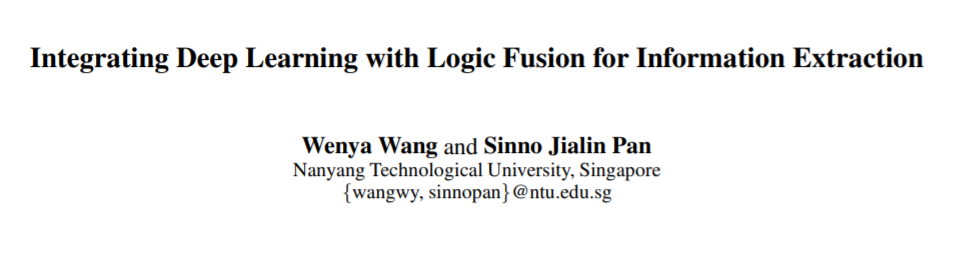

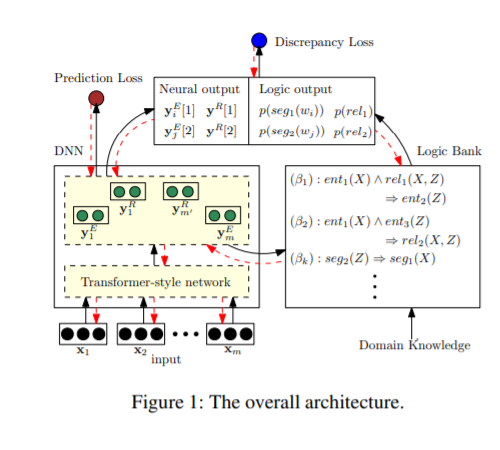

信息抽取(Information extraction, IE)旨在从输入文本中产生结构化的信息,例如命名实体识别和关系抽取。通过特征工程或深度学习为IE提出了各种尝试。然而,他们中的大多数人并没有将任务本身所固有的复杂关系联系起来,而这一点已被证明是特别重要的。例如,两个实体之间的关系高度依赖于它们的实体类型。这些依赖关系可以看作是复杂的约束,可以有效地表示为逻辑规则。为了将这种逻辑推理能力与深度神经网络的学习能力相结合,我们提出将一阶逻辑形式的逻辑知识集成到深度学习系统中,以端到端方式联合训练。该集成框架通过逻辑规则对神经输出进行知识正则化增强,同时根据训练数据的特点更新逻辑规则的权值。我们证明了该模型在多个IE任务上的有效性和泛化性。

作者:

Sinno Jialin Pan是南洋理工大学计算机科学与工程学院院长兼副教授,研究方向是迁移学习、数据挖掘、人工智能、机器学习。

成为VIP会员查看完整内容

相关内容

专知会员服务

60+阅读 · 2020年5月2日

专知会员服务

65+阅读 · 2019年12月14日

Arxiv

7+阅读 · 2018年4月20日

Arxiv

5+阅读 · 2018年2月22日