题目:* Certified Adversarial Robustness with Additive Noise

摘要:

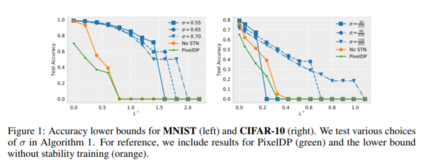

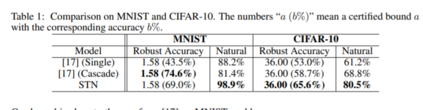

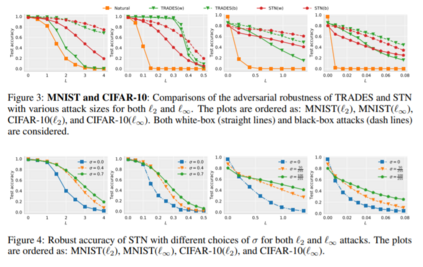

对抗性数据实例的存在引起了深度学习社区的高度重视;相对于原始数据,这些数据似乎受到了最小程度的干扰,但从深度学习算法得到的结果却非常不同。尽管已经考虑了开发防御模型的大量工作,但大多数此类模型都是启发式的,并且常常容易受到自适应攻击。人们对提供理论鲁棒性保证的防御方法进行了深入的研究,但是当存在大规模模型和数据时,大多数方法都无法获得非平凡的鲁棒性。为了解决这些限制,我们引入了一个可伸缩的框架,并为构造对抗性示例提供了输入操作规范的认证边界。我们建立了对抗扰动的鲁棒性与加性随机噪声之间的联系,并提出了一种能显著提高验证界的训练策略。我们对MNIST、CIFAR-10和ImageNet的评估表明,该方法可扩展到复杂的模型和大型数据集,同时对最先进的可证明防御方法具有竞争力的鲁棒性。

作者简介:

Changyou Chen是纽约州立大学布法罗分校计算机科学与工程系的助理教授,研究兴趣包括贝叶斯机器学习、深度学习和深度强化学习。目前感兴趣的是:大规模贝叶斯抽样和推理、深度生成模型,如VAE和GAN、用贝叶斯方法进行深度强化学习。

成为VIP会员查看完整内容

相关内容

专知会员服务

28+阅读 · 2020年2月18日

专知会员服务

29+阅读 · 2019年11月18日

Arxiv

4+阅读 · 2018年2月22日